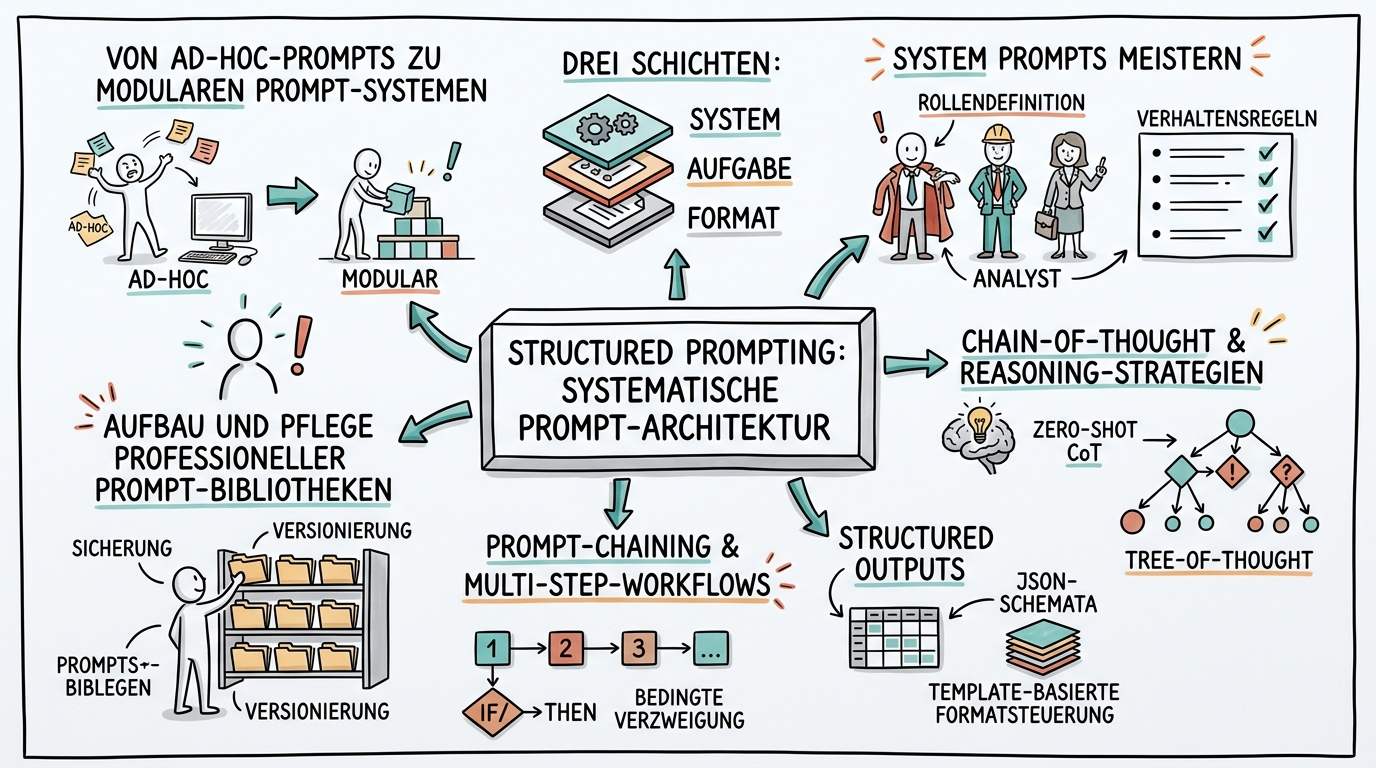

Structured Prompting: Systematische Prompt-Architektur

Fortgeschrittene Prompting-Techniken für Profis: System Prompts, Chain-of-Thought, Structured Outputs, Prompt-Chaining und der Aufbau professioneller Prompt-Bibliotheken.

Fortgeschrittene Prompting-Techniken für Profis: System Prompts, Chain-of-Thought, Structured Outputs, Prompt-Chaining und der Aufbau professioneller Prompt-Bibliotheken.

Klicken zum Vergrößern

Nach diesem Kurs beherrschen Sie fortgeschrittene Prompting-Techniken und können systematische Prompt-Architekturen für komplexe Aufgaben entwickeln. Sie verstehen die Prinzipien hinter Chain-of-Thought, Structured Outputs und System Prompts und können diese gezielt kombinieren.

Lernziel: Sie verstehen den Unterschied zwischen Ad-hoc-Prompting und systematischer Prompt-Architektur und erkennen, warum strukturierte Ansätze bessere Ergebnisse liefern.

Die meisten Menschen nutzen KI-Modelle wie eine Suchmaschine: Sie tippen eine Frage ein und hoffen auf eine gute Antwort. Das funktioniert für einfache Aufgaben, stößt aber schnell an Grenzen. Wer komplexe Analysen, konsistente Outputs oder reproduzierbare Ergebnisse braucht, muss seine Prompts wie Software-Architektur denken: modular, wiederverwendbar und systematisch aufgebaut.

Eine Prompt-Architektur besteht aus mehreren Schichten. Die unterste Schicht ist der System Prompt, der die Rolle, den Kontext und die Grundregeln definiert. Darüber liegt die Aufgabenschicht, die beschreibt, was genau getan werden soll. Die oberste Schicht ist die Formatierungsschicht, die festlegt, wie das Ergebnis strukturiert sein soll. Wer diese drei Schichten bewusst gestaltet, erhält dramatisch bessere Ergebnisse als mit einem einzigen, unstrukturierten Prompt.

Der entscheidende Perspektivwechsel: Denken Sie nicht mehr in einzelnen Prompts, sondern in Prompt-Systemen. Ein Prompt-System besteht aus mehreren aufeinander abgestimmten Prompts, die gemeinsam eine komplexe Aufgabe lösen. Beispielsweise könnte ein System zur Marktanalyse aus vier Prompts bestehen: einem für die Datensammlung, einem für die Analyse, einem für die Bewertung und einem für die Zusammenfassung.

Praxisbeispiel: Ein Unternehmensberater nutzte zunächst einen einzigen langen Prompt für Wettbewerbsanalysen. Die Ergebnisse waren inkonsistent: Mal fehlten Finanzdaten, mal war die SWOT-Analyse oberflächlich. Nach der Umstellung auf ein vierteiliges Prompt-System mit definierten Rollen und Outputformaten stiegen Qualität und Konsistenz erheblich. Der zeitliche Mehraufwand für die Prompt-Erstellung betrug einmalig zwei Stunden, spart aber seitdem bei jeder Analyse mindestens eine Stunde Nacharbeit.

| Aspekt | Ad-hoc-Prompting | Systematische Prompt-Architektur |

|---|---|---|

| Konsistenz | Variiert stark | Reproduzierbar |

| Qualität | Abhängig vom Zufall | Kontrolliert hoch |

| Wiederverwendbarkeit | Keine | Modular einsetzbar |

| Lernkurve | Flach | Steil, aber lohnend |

| Geeignet für | Einfache Fragen | Komplexe Aufgaben |

Zusammenfassung:

> Praxistipp: Erstellen Sie für Ihre drei häufigsten KI-Aufgaben jeweils einen dokumentierten Prompt mit allen drei Schichten. Testen Sie ihn fünfmal und optimieren Sie, bis die Ergebnisse konsistent sind.

Lernziel: Sie können wirkungsvolle System Prompts erstellen, die KI-Modelle präzise auf eine Aufgabe ausrichten.

Der System Prompt ist das Fundament jeder Prompt-Architektur. Er definiert, wer das Modell ist, wie es sich verhalten soll und welche Regeln es befolgen muss. Ein gut geschriebener System Prompt ist wie ein umfassendes Briefing für einen neuen Mitarbeitenden: Er enthält alles, was das Modell wissen muss, um die Aufgabe richtig zu verstehen.

Die wichtigsten Elemente eines System Prompts sind die Rollendefinition, der Kontext, die Verhaltensregeln und die Einschränkungen. Die Rollendefinition legt fest, als was sich das Modell verhalten soll: "Du bist ein erfahrener Finanzanalyst mit 15 Jahren Berufserfahrung." Der Kontext beschreibt die Situation: "Du arbeitest für ein mittelständisches Unternehmen in der Automobilzulieferindustrie." Die Verhaltensregeln definieren den Stil: "Antworte immer auf Deutsch, verwende Fachbegriffe nur mit Erklärung, strukturiere deine Antworten mit Überschriften." Die Einschränkungen setzen Grenzen: "Gib keine Rechtsberatung, verweise bei Unsicherheit auf Fachexperten."

Ein häufiger Fehler ist der überladene System Prompt. Wenn Sie versuchen, jede Eventualität abzudecken, wird der Prompt so lang, dass das Modell die wichtigsten Anweisungen aus den Augen verliert. Die Kunst liegt in der Priorisierung: Was sind die drei bis fünf wichtigsten Verhaltensweisen, die das Modell zeigen soll? Formulieren Sie diese klar und setzen Sie sie an den Anfang des System Prompts.

Ein weiterer fortgeschrittener Aspekt ist die Negativanweisung. Manchmal ist es wirksamer zu beschreiben, was das Modell nicht tun soll, als was es tun soll. "Verwende keine Aufzählungen als Hauptinhalt" ist präziser als "Schreibe in Fließtext." Kombinieren Sie positive und negative Anweisungen für maximale Klarheit.

Praxisbeispiel: Ein Beratungsunternehmen erstellt regelmäßig Executive Summaries für Vorstandspräsentationen. Der System Prompt definiert: Rolle (Senior Strategy Consultant), Zielgruppe (C-Level, wenig Zeit), Format (maximal eine Seite, drei Kernaussagen mit Handlungsempfehlungen), Stil (direkt, zahlenbasiert, keine Floskeln) und Einschränkungen (keine Spekulationen, nur belegbare Aussagen). Das Ergebnis: konsistente, hochwertige Zusammenfassungen, die ohne Nachbearbeitung an den Vorstand gehen können.

| System Prompt Element | Beispiel | Wirkung |

|---|---|---|

| Rollendefinition | "Du bist Senior Data Analyst" | Fachliche Tiefe und Tonalität |

| Kontext | "Für ein Pharmaunternehmen" | Branchenspezifische Antworten |

| Verhaltensregeln | "Nutze immer Quellenangaben" | Konsistente Qualität |

| Einschränkungen | "Keine medizinischen Empfehlungen" | Risikominimierung |

| Outputformat | "JSON mit definierten Feldern" | Maschinenlesbare Ergebnisse |

Zusammenfassung:

> Reflexionsfrage: Schreiben Sie einen System Prompt für Ihre häufigste KI-Aufgabe. Welche drei Verhaltensregeln sind absolut unverzichtbar?

Lernziel: Sie verstehen verschiedene Reasoning-Strategien und können sie gezielt einsetzen, um die Denkqualität von KI-Modellen zu verbessern.

Chain-of-Thought (CoT) Prompting ist eine der wirkungsvollsten Techniken im Prompting. Die Grundidee ist einfach: Statt das Modell direkt nach der Antwort zu fragen, fordern Sie es auf, seinen Denkprozess Schritt für Schritt zu dokumentieren. Das klingt trivial, hat aber einen tiefgreifenden Effekt auf die Qualität der Ergebnisse, besonders bei logischen, mathematischen und analytischen Aufgaben.

Die einfachste Form ist das Zero-Shot CoT: Sie fügen am Ende Ihres Prompts die Anweisung "Denke Schritt für Schritt" hinzu. Bereits diese kleine Ergänzung kann die Genauigkeit bei Rechenaufgaben um 20 bis 40 Prozent verbessern. Der Grund: Das Modell "zwingt" sich selbst, Zwischenschritte zu formulieren, statt direkt zur Antwort zu springen.

Fortgeschrittener ist das Few-Shot CoT: Sie geben dem Modell ein oder zwei Beispiele, wie der Denkprozess aussehen soll. Das ist besonders wirksam bei fachspezifischen Aufgaben, bei denen der Denkprozess einer bestimmten Methodik folgen soll. Ein Beispiel: Für eine Risikoanalyse zeigen Sie dem Modell, wie es erst die Risikofaktoren identifiziert, dann die Eintrittswahrscheinlichkeit bewertet, dann die Auswirkung einschätzt und schließlich zu einer Gesamtbewertung kommt.

Neuere Modelle wie Claude und GPT-4 unterstützen "Extended Thinking", bei dem das Modell intern einen umfangreichen Denkprozess durchläuft, bevor es antwortet. Bei Claude können Sie diesen Modus explizit aktivieren. Das Modell denkt dann in einem separaten Bereich nach und präsentiert Ihnen nur das Ergebnis. Dies ist besonders wirksam bei komplexen Aufgaben, die mehrere Perspektiven erfordern.

Eine weitere fortgeschrittene Technik ist Tree-of-Thought (ToT): Statt linear zu denken, exploriert das Modell mehrere Lösungspfade parallel und wählt den vielversprechendsten aus. Sie können dies simulieren, indem Sie das Modell auffordern, drei alternative Ansätze zu skizzieren, jeden kurz zu bewerten und dann den besten weiterzuverfolgen.

Praxisbeispiel: Ein Wirtschaftsprüfer nutzt CoT-Prompting für die Analyse komplexer Bilanzen. Sein Prompt enthält die Anweisung: "Analysiere diese Bilanz in fünf Schritten: 1) Identifiziere ungewöhnliche Posten, 2) Vergleiche mit Branchendurchschnitt, 3) Prüfe zeitliche Entwicklung, 4) Bewerte Risiken, 5) Formuliere eine Gesamteinschätzung." Die strukturierte Denkweise führt zu Analysen, die kaum Nachbearbeitung benötigen.

| Reasoning-Strategie | Komplexität | Beste Anwendung |

|---|---|---|

| Zero-Shot CoT | Niedrig | Mathematik, Logik |

| Few-Shot CoT | Mittel | Fachspezifische Analysen |

| Extended Thinking | Mittel | Komplexe Entscheidungen |

| Tree-of-Thought | Hoch | Kreative Problemlösung |

| Self-Consistency | Hoch | Kritische Entscheidungen |

Zusammenfassung:

> Praxistipp: Testen Sie den Unterschied: Stellen Sie die gleiche analytische Frage einmal direkt und einmal mit "Denke Schritt für Schritt" am Ende. Vergleichen Sie Qualität und Tiefe der Antworten.

Lernziel: Sie können KI-Modelle dazu bringen, Ergebnisse in exakt definierten Formaten zu liefern, von JSON über Tabellen bis zu strukturierten Berichten.

Die Fähigkeit, das Ausgabeformat einer KI präzise zu steuern, trennt Anfänger von Fortgeschrittenen. Wenn Sie KI-Outputs in Ihre Arbeitsprozesse integrieren möchten, brauchen Sie konsistente, strukturierte Ergebnisse, die sich direkt weiterverarbeiten lassen. Ein Freitext-Output mag schön zu lesen sein, aber er lässt sich nicht automatisiert in eine Datenbank schreiben oder in ein Dashboard einspeisen.

JSON ist das universelle Format für maschinenlesbare Outputs. Moderne Modelle wie Claude und GPT-4 können zuverlässig valides JSON erzeugen, wenn Sie das gewünschte Schema im Prompt definieren. Der Schlüssel ist ein konkretes Beispiel: Zeigen Sie dem Modell exakt, wie das JSON-Objekt aussehen soll, mit allen Feldern, Datentypen und möglichen Werten. Vage Beschreibungen wie "gib mir die Daten als JSON" führen zu inkonsistenten Strukturen.

Für tabellarische Daten ist Markdown das Format der Wahl. Definieren Sie die Spaltenüberschriften und geben Sie ein Beispiel mit zwei bis drei Zeilen. Das Modell wird das Format konsistent fortführen. Besonders nützlich ist dies für Vergleichsanalysen, Bewertungsmatrizen und strukturierte Übersichten.

Ein fortgeschrittenes Konzept ist die Template-basierte Ausgabe. Sie definieren ein Texttemplate mit Platzhaltern und das Modell füllt nur die Platzhalter aus. Das ist ideal für wiederkehrende Berichte: Der Aufbau bleibt immer gleich, nur die Inhalte ändern sich. Diese Technik reduziert Halluzinationen erheblich, weil das Modell weniger Freiheiten hat, eigene Strukturen zu erfinden.

Auch die Steuerung der Ausgabelänge ist ein wichtiger Aspekt der Formatierung. "Fasse in 3 Sätzen zusammen" ist wirksamer als "Fasse kurz zusammen." Konkrete Zahlenangaben (Wortanzahl, Seitenanzahl, Anzahl der Bullet Points) führen zu präziseren Ergebnissen als vage Längenangaben.

Praxisbeispiel: Ein Personalberater nutzt strukturierte Outputs, um Bewerbungsunterlagen standardisiert auszuwerten. Sein Prompt definiert ein JSON-Schema mit den Feldern "name", "erfahrungJahre", "kernkompetenzen" (Array), "gesamtbewertung" (1 bis 5) und "empfehlung" (Text, max. 50 Wörter). So kann er 50 Bewerbungen in einer Stunde auswerten und die Ergebnisse direkt in sein ATS-System importieren.

| Ausgabeformat | Anwendungsfall | Prompt-Technik |

|---|---|---|

| JSON | API-Integration, Datenbanken | Schema mit Beispiel definieren |

| Markdown-Tabelle | Vergleiche, Übersichten | Spalten und Beispielzeile vorgeben |

| Template | Wiederkehrende Berichte | Platzhalter mit {} markieren |

| XML | Dokumentenverarbeitung | Tags und Struktur vorgeben |

| CSV | Tabellenkalkulation | Header und Trennzeichen definieren |

Zusammenfassung:

> Reflexionsfrage: Welche Ihrer KI-Aufgaben könnten von einem strukturierten Outputformat profitieren? Entwerfen Sie ein JSON-Schema für eine davon.

Lernziel: Sie können komplexe Aufgaben in verkettete Prompt-Sequenzen zerlegen und mehrstufige KI-Workflows gestalten.

Manche Aufgaben sind zu komplex für einen einzelnen Prompt. So wie ein erfahrener Analyst eine komplexe Fragestellung in Teilschritte zerlegt, können Sie KI-Aufgaben in eine Kette aufeinander aufbauender Prompts aufteilen. Dieses Prompt-Chaining verbessert nicht nur die Ergebnisqualität, sondern macht den gesamten Prozess nachvollziehbar und debuggbar.

Das Grundprinzip ist einfach: Der Output von Prompt A wird zum Input von Prompt B. Ein Beispiel: Prompt A extrahiert die Kernaussagen aus einem langen Dokument. Prompt B bewertet diese Aussagen nach Relevanz. Prompt C formuliert daraus eine Handlungsempfehlung. Jeder einzelne Prompt ist einfach und fokussiert, aber zusammen lösen sie eine komplexe Aufgabe.

Die Kunst liegt in der Schnittstellengestaltung zwischen den Prompts. Definieren Sie klar, welches Format der Output von Prompt A haben muss, damit Prompt B ihn verarbeiten kann. JSON eignet sich hier besonders gut, weil es strukturiert und eindeutig ist. Vermeiden Sie Freitext-Schnittstellen: Sie führen zu Informationsverlust und Inkonsistenzen.

Ein fortgeschrittenes Muster ist die bedingte Verzweigung: Basierend auf dem Ergebnis eines Prompts wird entschieden, welcher nächste Prompt ausgeführt wird. Wenn die Sentiment-Analyse eines Kundenfeedbacks "negativ" ergibt, wird ein anderer Follow-up-Prompt aktiviert als bei "positiv." Dieses Muster bildet die Grundlage für KI-Agenten-Systeme.

Praxisbeispiel: Ein Content-Team nutzt eine vierstufige Prompt-Chain für die Erstellung von Blogartikeln. Schritt 1: Themenrecherche (KI sammelt aktülle Quellen und Trends). Schritt 2: Gliederung (KI erstellt eine Struktur basierend auf den Rechercheergebnissen). Schritt 3: Texterstellung (KI schreibt die einzelnen Abschnitte anhand der Gliederung). Schritt 4: Qualitätskontrolle (KI prüft den Text auf Konsistenz, Fakten und Tonalität). Der gesamte Prozess dauert 15 Minuten statt vorher drei Stunden, und die Qualität ist höher, weil jeder Schritt fokussiert ist.

| Chain-Muster | Beschreibung | Einsatz |

|---|---|---|

| Linear | A → B → C → D | Sequentielle Verarbeitung |

| Fan-out | A → B1, B2, B3 → C | Parallele Analyse |

| Bedingt | A → wenn X: B, wenn Y: C | Entscheidungslogik |

| Iterativ | A → B → prüfe → (zurück zu B oder weiter) | Qualitätsschleifen |

| Map-Reduce | A → B(n mal) → C (zusammenführen) | Große Datenmengen |

Zusammenfassung:

> Praxistipp: Nehmen Sie Ihre komplexeste KI-Aufgabe und zerlegen Sie sie in mindestens drei Schritte. Definieren Sie für jeden Schritt einen eigenen Prompt mit klarem Input und Output.

Lernziel: Sie können eine systematische Prompt-Bibliothek für Ihr Team oder Ihre Organisation aufbauen und pflegen.

Prompt Engineering wird in vielen Organisationen noch als individülle Fertigkeit behandelt: Jeder schreibt seine eigenen Prompts, niemand teilt, niemand dokumentiert. Das ist so, als würde jeder Entwickler seine eigenen Bibliotheken schreiben, ohne auf bestehenden Code zurückzugreifen. Eine systematische Prompt-Bibliothek ist der Schlüssel zur Skalierung von KI-Kompetenz im Unternehmen.

Eine Prompt-Bibliothek sollte wie eine Software-Bibliothek aufgebaut sein: mit Versionierung, Dokumentation und Qualitätssicherung. Jeder Prompt bekommt einen eindeutigen Namen, eine Beschreibung des Einsatzzwecks, Hinweise zur Nutzung und Beispiele für erwartete Ergebnisse. Änderungen werden versioniert, damit nachvollziehbar ist, warum ein Prompt geändert wurde und welche Version die aktüllste ist.

Die Organisation der Bibliothek folgt idealerweise den Geschäftsprozessen. Statt Prompts nach KI-Modell oder Technik zu sortieren, ordnen Sie sie nach Anwendungsfall: Marketing-Prompts, Analyse-Prompts, Kundenkommunikations-Prompts. So finden Kolleginnen und Kollegen schnell den richtigen Prompt, auch wenn sie keine KI-Experten sind.

Ein oft unterschätzter Aspekt ist die Pflege. Prompts veralten, weil sich KI-Modelle weiterentwickeln. Ein Prompt, der mit GPT-3.5 perfekt funktionierte, liefert mit GPT-4 möglicherweise andere Ergebnisse. Planen Sie regelmäßige Reviews ein: mindestens quartalsweise sollte die gesamte Bibliothek auf Aktualität geprüft werden.

Praxisbeispiel: Ein Beratungsunternehmen mit 200 Mitarbeitenden hat eine zentrale Prompt-Bibliothek in Notion aufgebaut. Jeder Prompt durchläuft einen Review-Prozess: Ein KI-Champion prüft Qualität und Konsistenz, bevor der Prompt in die Bibliothek aufgenommen wird. Die Bibliothek enthält inzwischen über 150 Prompts, sortiert nach Beratungsphasen (Discovery, Analyse, Empfehlung, Präsentation). Die durchschnittliche Qualität der KI-gestützten Arbeitsergebnisse ist messbar gestiegen, und neue Mitarbeitende sind deutlich schneller produktiv.

| Bibliotheks-Element | Beschreibung | Beispiel |

|---|---|---|

| Prompt-Name | Eindeutiger Bezeichner | "market-analysis-v3" |

| Beschreibung | Einsatzzweck und Kontext | "Erstellt Marktanalyse für Pitch-Decks" |

| System Prompt | Basis-Konfiguration | Rolle, Regeln, Format |

| User Prompt Template | Anpassbarer Teil | "Analysiere den Markt für {Branche} in {Region}" |

| Beispiel-Output | Erwartetes Ergebnis | Vollständiges Beispiel |

| Version/Changelog | Änderungshistorie | "v3: Angepasst für Claude 4" |

Zusammenfassung:

> Praxistipp: Starten Sie klein: Sammeln Sie die zehn besten Prompts Ihres Teams in einem gemeinsamen Dokument. Ergänzen Sie Beschreibung und Beispiel-Output. Das ist Ihre erste Prompt-Bibliothek.