Quantum Computing und KI: Die nächste Revolution

Wie die Konvergenz von Quantencomputing und Künstlicher Intelligenz die Grenzen klassischer Hardware sprengt -- mit konkreten Beispielen aus Finanzen, Pharma und Logistik

Wie die Konvergenz von Quantencomputing und Künstlicher Intelligenz die Grenzen klassischer Hardware sprengt -- mit konkreten Beispielen aus Finanzen, Pharma und Logistik

Klicken zum Vergrößern

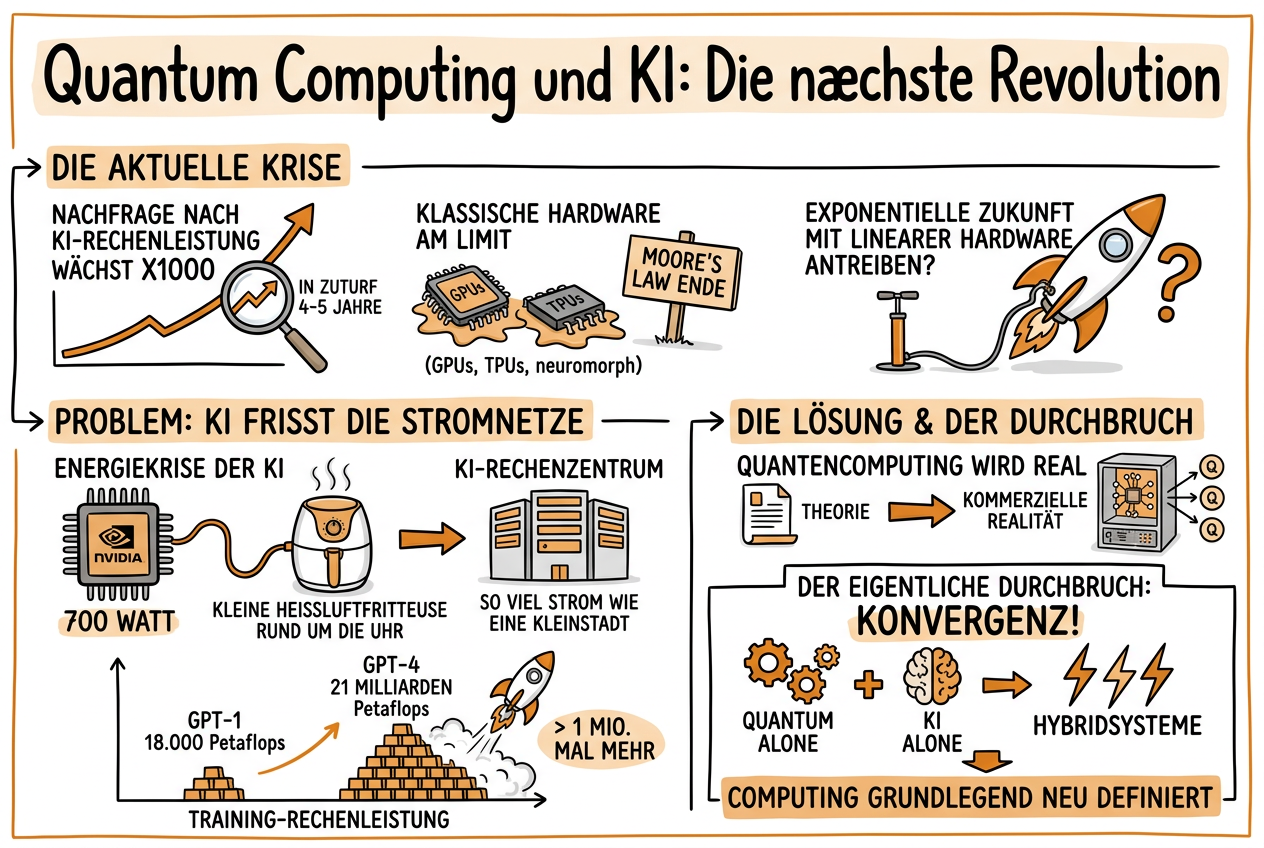

Die Nachfrage nach KI-Rechenleistung wächst in den nächsten vier bis fünf Jahren um das Tausendfache. Das ist kein Tippfehler -- tausendfach. Gleichzeitig stösst klassische Hardware an physikalische Grenzen. Moore's Law ist am Ende, GPUs, TPUs und neuromorphe Chips kämpfen alle mit denselben thermischen, energetischen und skalierungsbedingten Limits.

Wir versuchen, eine exponentielle Zukunft mit linearer Hardware anzutreiben. Das ist, als würde man eine Rakete mit einer Fahrradpumpe betanken.

Aber während alle über diese Krise reden, passiert etwas anderes: Quantencomputing hat den Sprung von der Theorie zur kommerziellen Realität vollzogen. Und der eigentliche Durchbruch ist nicht Quantum allein, nicht KI allein -- sondern die Konvergenz beider zu Hybridsystemen, die Computing grundlegend neu definieren.

Ein einzelner Nvidia H100-Chip -- das Herzstuck heutiger KI-Systeme -- verbraucht 700 Watt bei Spitzenlast. Das entspricht einer kleinen Heissluftfritteuse, die rund um die Uhr läuft. Aber für ein KI-Modell braucht man Zehntausende dieser Chips. Ein einzelnes KI-Rechenzentrum verbraucht so viel Strom wie eine Kleinstadt.

Die Zahlen zur Entwicklung sprechen für sich: GPT-1 benötigte 18.000 Petaflops zum Training. GPT-4 benötigte 21 Milliarden Petaflops -- das ist über eine Million Mal mehr Rechenleistung. Bis 2030 werden Rechenzentren voraussichtlich mehr als doppelt so viel vom US-Stromverbrauch beanspruchen wie heute.

Es geht nicht nur um die Menge. KI verändert auch die Qualität der Stromversorgung. In der Nähe von KI-Rechenzentren entstehen harmonische Verzerrungen im Stromnetz. Wenn diese 8 Prozent übersteigen -- was zunehmend vorkommt -- beginnen Kühlschränke Geräusche zu machen, Elektronik verschleisst schneller, Haushaltsgeräte gehen früher kaputt.

Am 10. Juli 2024 zeigte sich das Risiko konkret. In Northern Virginia, dem weltweit grössten Rechenzentrum-Cluster, fiel ein Blitzableiter an einem Übertragungsmast aus. Normalerweise ein triviales Problem. Aber als die Netzstorung auftrat, sprangen alle Sicherheitssysteme der Rechenzentren gleichzeitig an. 1.500 Megawatt Nachfrage verschwanden in Millisekunden aus dem Netz -- die gesamte Stromversorgung Islands, weg in einem Augenblick. Die Netzfrequenz sprang von 60 Hertz auf 60,047 Hertz. Klingt nach wenig -- aber grössere Abweichungen lösen regionalweite Blackouts aus.

Klassisches Computing basiert auf binärer Logik: Einsen und Nullen, An oder Aus. Quantencomputing arbeitet mit Superposition -- ein Quantenbit kann gleichzeitig Eins und Null sein, bis es gemessen wird.

Stell dir das so vor: Klassisches Computing ist die linke Gehirnhälfte -- logisch, sequentiell, vorhersagbar. Quantencomputing ist die rechte Gehirnhälfte -- Mustererkennung, parallele Verarbeitung, wahrscheinlichkeitsbasiertes Denken. Wenn man beide zusammenführt, entsteht etwas, das beide einzeln übertrifft.

Die Zukunft ist nicht "Quantum ersetzt Klassisch". Die Zukunft sind Hybridsysteme, in denen klassische Computer die Aufgaben erledigen, für die sie optimiert sind, während Quanten-Coprozessoren die Aufgaben übernehmen, bei denen sie um Grössenordnungen effizienter arbeiten:

HSBC demonstrierte das weltweit erste quantengestützte algorithmische Handelssystem mit IBMs Heron-Quantenprozessor. Das Ergebnis: 34 Prozent bessere Vorhersage abgeschlossener Trades. Das ist kein marginaler Fortschritt -- das ist ein Paradigmenwechsel.

Klassisches Machine Learning übernimmt die Kern-Handelslogik, während Quantenprozessoren sogenannte Quantum Feature Maps erstellen, die verborgene Korrelationen in Marktdaten aufdecken. Portfolio-Optimierung, Risiko-Modellierung und Betrugserkennung stehen als nächstes an.

Klassische computergestützte Chemie hat ihre Grenzen bei der Simulation komplexer molekularer Wechselwirkungen erreicht. Das St. Jude Research Hospital nutzte quantenverstärktes Machine Learning, um bisher als "undruggable" geltende Proteine wie KRAS anzugreifen.

Pascal und Qubit Pharmaceuticals setzten Quanten-Algorithmen für die Analyse der Proteinhydratation ein -- die erste Quantenlösung für ein pharmazeutisch bedeutsames Problem in der molekularen Biologie.

Das Potenzial: Die typische Entwicklungszeit von 10 bis 15 Jahren für neue Medikamente könnte um Jahre verkürzt werden, bei gleichzeitiger Einsparung von Milliarden an Forschungskosten.

Volkswagen nutzte Quantencomputing, um Verkehrsrouten durch Lissabon in Echtzeit zu optimieren. Coca-Cola setzte es für 700.000 Verkaufsautomaten in Japan ein. BMW wendete es auf Supply-Chain-Partitionierungsprobleme an. IBM demonstrierte quanten-klassische Optimierung für Lieferungen an 200 Standorte in New York City unter Berücksichtigung von Zeitfenstern und Kapazitätsbeschränkungen.

Die Logistikbranche schätzt, dass diese Technologie die globalen Frachtkosten signifikant senken und gleichzeitig CO2-Emissionen reduzieren könnte.

Hier liegt der vielleicht wichtigste Aspekt für die KI-Zukunft: Quantensysteme sind für bestimmte Berechnungstypen um Grössenordnungen energieeffizienter als klassische Systeme. Ein Problem, das einen klassischen Supercomputer Megawatt an Leistung kostet, kann von einem Quantencomputer mit einem Bruchteil dieser Energie gelöst werden.

KI-Modelle trainieren, neuronale Netze optimieren, molekulare Strukturen für neue Materialien simulieren -- das sind genau die Problemtypen, bei denen Quantencomputing seine Stärken ausspielt.

KI-Training, das heute Wochen dauert und den Stromverbrauch einer Stadt beansprucht, könnte auf Quantensystemen in Stunden erledigt werden -- bei einem Bruchteil des Energieverbrauchs.

Jage Quantencomputing nicht, weil es faszinierend klingt. Inventarisiere deine rechenintensivsten Herausforderungen: Optimierungsprobleme mit Tausenden von Variablen, molekulare Simulationen, Mustererkennung in hochdimensionalen Daten, Echtzeit-Entscheidungen unter Unsicherheit. Das sind deine quantenfreundlichen Probleme.

Du musst kein Quantenphysiker werden. Aber du solltest verstehen:

Das ist vergleichbar mit dem Erlernen von Cloud Computing im Jahr 2006. Wer damals früh Kompetenz aufbaute, dominierte das nächste Jahrzehnt.

Warte nicht auf reine Quantensysteme. Der Weg zum Quantenvorteil führt über hybrides Computing. Gestalte deine Dateninfrastruktur und ML-Pipelines mit Hybrid im Hinterkopf. Cloudbasierte Quantenplattformen von IBM, Microsoft und AWS machen Experimente auch ohne massive Kapitalinvestitionen möglich.

Die nächste Generation von KI-Modellen wird Quanten-Subroutinen integrieren:

Wenn du in KI-Infrastruktur investierst, evaluiere, wie Quantenbeschleunigung deine bestehenden ML-Pipelines erweitern könnte.

Technologie-Giganten reagieren bereits auf die Energiekrise:

Sie umgehen das Stromnetz, weil sie wissen: Das Netz kann nicht liefern, was kommt.

Die Konvergenz von Quantencomputing und Künstlicher Intelligenz ist kein Hype-Zyklus. Es ist Mathematik: Die Rechenanforderungen wachsen exponentiell, klassische Hardware stösst an physikalische Grenzen, und Quantensysteme liefern bereits messbare Ergebnisse in Finanzen, Pharma und Logistik.

Die Organisationen, die im nächsten Jahrzehnt führen werden, wählen nicht zwischen klassischer KI oder Quantencomputing. Sie orchestrieren beide in integrierten Systemen, die menschliche Entscheidungsfindung mit beispielloser Rechenleistung unterstützen.

Dies ist der grösste Umbruch in der Informationsverarbeitung seit der Erfindung des Transistors. Und anders als frühere Revolutionen, die Jahrzehnte brauchten, passiert diese in Monaten. Die Frage ist nicht, ob die Quanten-KI-Konvergenz deine Branche transformieren wird. Die Frage ist: Wirst du die Transformation anführen -- oder ihr hinterherlaufen?