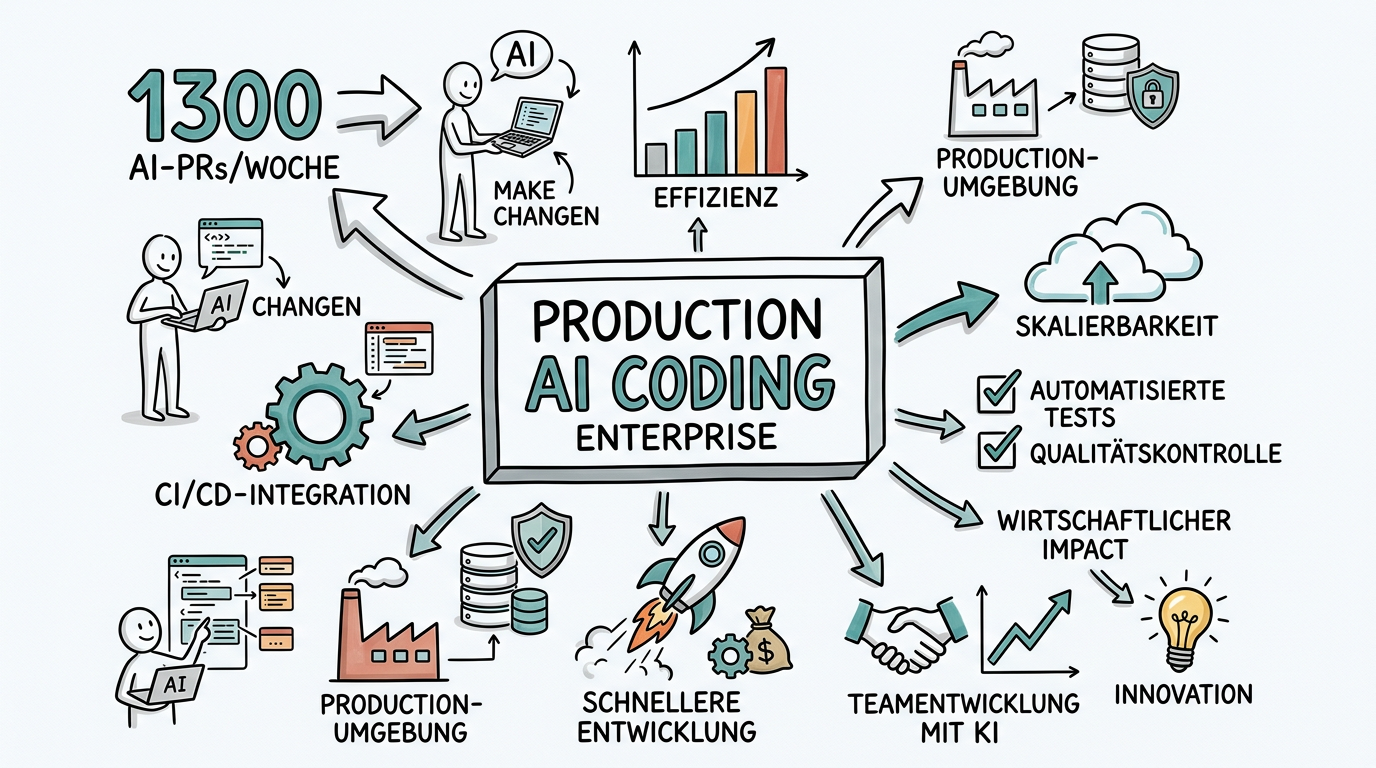

Production AI Coding: Enterprise-Scale Agent-Systeme

KI kann Code schreiben -- das wissen mittlerweile alle. Aber wie setzen Unternehmen wie Stripe, Google und Shopify KI-Coding-Agents im grossen Massstab ein? In diesem Kurs lernst du die Architektur, Prozesse und Sicherheitsmechanismen, die Enterprise-AI-Coding von Hobby-Projekten unterscheiden.

Lektion 1: Von Vibe Coding zu Production AI

Das Spektrum der KI-Coding-Reife

Die meisten KI-Nutzer befinden sich auf Stufe 1 oder 2:

Stufe 1: Copy-Paste-Coding Du fragst ChatGPT nach einem Code-Snippet und fügst es in dein Projekt ein. Funktioniert für kleine Aufgaben, skaliert nicht.

Stufe 2: Vibe Coding Du beschreibst, was du willst, und die KI generiert eine komplette Anwendung. Schnell, aber fragil -- der Code funktioniert, aber niemand versteht ihn wirklich.

Stufe 3: Assisted Development KI-Tools wie Claude Code oder Cursor sind in deinen Entwicklungsworkflow integriert. Du reviewst jeden Vorschlag, die KI beschleunigt dich um den Faktor 3-5x.

Stufe 4: Agent-Driven Development KI-Agents arbeiten autonom an Aufgaben: Sie lesen Issüs, schreiben Code, erstellen Tests, öffnen Pull Requests. Ein Mensch reviewed und approved.

Stufe 5: Production AI (Enterprise) Hunderte KI-Agents arbeiten parallel. Automatisierte Qualitätssicherung, CI/CD-Integration, menschliche Aufsicht nur noch bei kritischen Änderungen.

Dieser Kurs bringt dich von Stufe 3 auf Stufe 4-5.

Lektion 2: Die Stripe Case Study -- 1.300 PRs pro Woche

Was Stripe macht

Stripe, der Zahlungsdienstleister mit 8.000+ Mitarbeitern, hat 2025-2026 eine der ambitioniertesten AI-Coding-Initiativen der Welt gestartet:

- 1.300 AI-generierte Pull Requests pro Woche

- Agent Harness Architecture: Ein Framework, das KI-Agents steuert und überwacht

- Zero-human-written Code in bestimmten Modulen -- die KI schreibt alles, Menschen reviewen

Der Agent Harness

Stripes Kernkonzept ist der "Agent Harness" -- ein Rahmenwerk, das KI-Agents kontrolliert:

- Issü-Analyse: Der Agent liest ein GitHub Issü und versteht den Kontext

- Codebase-Navigation: Er durchsucht die relevanten Dateien und versteht die Architektur

- Code-Generierung: Er schreibt den Code und die zugehörigen Tests

- Self-Review: Er prüft seinen eigenen Code gegen Linting-Regeln und Best Practices

- PR-Erstellung: Er öffnet einen Pull Request mit ausführlicher Beschreibung

- Feedback-Loop: Wenn der Review Änderungen verlangt, arbeitet der Agent diese ein

Warum das funktioniert

- Kleine, klar definierte Aufgaben: Jeder PR löst genau ein Issü

- Umfangreiche Testabdeckung: Die bestehende Test-Suite fängt Fehler ab

- Menschliches Review: Kein Code geht ohne menschliche Prüfung in Production

- Iterative Verbesserung: Das System lernt aus abgelehnten PRs

Lektion 3: Architektur eines Enterprise AI Coding Systems

Die drei Schichten

Schicht 1: Agent Orchestration

- Aufgabenverteilung: Welcher Agent bekommt welches Issü?

- Priorisierung: Kritische Bugs zürst, Features danach

- Parallelisierung: Wie viele Agents laufen gleichzeitig?

- Ressourcen-Management: Token-Budgets, API-Limits

Schicht 2: Code Generation Pipeline

- Context Loading: Relevante Dateien identifizieren und laden

- Code Writing: Den eigentlichen Code generieren

- Test Generation: Automatische Tests schreiben

- Documentation: Inline-Kommentare und PR-Beschreibungen erstellen

Schicht 3: Quality Assurance

- Linting und Formatting: Automatische Code-Style-Prüfung

- Unit Tests: Funktionieren die neuen Tests?

- Integration Tests: Bricht der neue Code bestehende Funktionalität?

- Security Scan: Keine Schwachstellen eingeführt?

- Human Review: Finale Prüfung durch einen Entwickler

Das Zusammenspiel

``` Issü → Agent Harness → Code + Tests → CI/CD → Review → Merge → Deploy ↑ | └──────────── Feedback Loop ───────────────┘ ```

Lektion 4: CI/CD mit AI -- Die neue Pipeline

Klassische CI/CD vs. AI-erweiterte CI/CD

Klassisch: Developer → Code → Push → Build → Test → Review → Merge → Deploy

AI-erweitert: Issü → AI Agent → Code + Tests → Push → Build → Test → AI Self-Review → Human Review → Merge → Auto-Deploy

Die wichtigsten Erweiterungen

Pre-Commit AI Checks:

- Bevor Code committed wird, prüft ein AI Agent: "Ist dieser Code konsistent mit dem Rest der Codebase?"

- Erkennt Copy-Paste-Fehler, vergessene Error-Handling, fehlende Logging

AI Code Review:

- Ein separater AI Agent reviewed den Code aus einer anderen Perspektive

- Prüft auf Security-Probleme, Performance-Issüs, Architektur-Konformität

- Schlägt konkrete Verbesserungen vor (nicht nur "das ist schlecht")

Automated Test Generation:

- Für jeden neuen Code-Pfad werden automatisch Tests generiert

- Edge Cases, die Menschen übersehen, werden abgedeckt

- Test-Coverage steigt automatisch mit jeder Änderung

Regression Detection:

- AI analysiert, ob eine Änderung unbeabsichtigte Seiteneffekte hat

- Vergleicht das Verhalten vor und nach der Änderung

- Alarmiert bei statistisch signifikanten Abweichungen

Lektion 5: Qualitätssicherung und Sicherheit

Das Vertrauensproblem

AI-generierter Code hat ein fundamentales Vertrauensproblem: Woher weisst du, dass er korrekt und sicher ist?

Die Lösung: Multi-Layer-Verification

Layer 1: Automatisierte Tests

- Unit Tests (vom Agent selbst geschrieben)

- Integration Tests (aus der bestehenden Suite)

- End-to-End Tests (simulierte Nutzerflows)

Layer 2: Statische Analyse

- Linting (Code-Style)

- Type Checking (TypeScript/MyPy)

- Security Scanner (SAST/DAST)

- Dependency Check (bekannte Schwachstellen in Libraries)

Layer 3: AI Review

- Ein zweiter AI Agent reviewed den Code des ersten

- Perspektive: "Würde ich diesen Code in Production deployen?"

- Fokus auf Edge Cases, Error Handling, Performance

Layer 4: Human Review

- Finale Prüfung durch einen erfahrenen Entwickler

- Fokus auf Architektur, Business-Logik, strategische Entscheidungen

- Veto-Recht: Ein Mensch kann jeden PR ablehnen

Security Best Practices

- Keine Secrets im Code: AI Agents dürfen nie Zugang zu Produktions-Credentials haben

- Sandboxed Execution: Code wird in isolierten Umgebungen getestet

- Audit Trail: Jede AI-generierte Änderung ist nachvollziehbar

- Rollback-Fähigkeit: Jeder Deploy kann in Sekunden zurückgenommen werden

- Blast Radius begrenzen: AI-Changes werden zunächst nur für 1% der Nutzer deployed

Lektion 6: Von 1 auf 100 -- Skalierung von AI Coding

Phase 1: Pilot (1-3 Agents)

- Ein einzelner Agent für einfache Aufgaben (Typo-Fixes, Test-Erweiterungen)

- Manülles Monitoring durch das Team

- Ziel: Vertrauen aufbauen, Prozesse etablieren

Phase 2: Team-Integration (5-20 Agents)

- Agents übernehmen Standard-Issüs (Bug Fixes, kleine Features)

- Automatisiertes Monitoring und Alerting

- Team-Richtlinien für AI-generierte PRs

Phase 3: Organisation (50-200 Agents)

- Agents arbeiten an mehreren Repositories parallel

- Zentrale Agent-Orchestration

- KPI-Tracking: Throughput, Qualität, Review-Zeiten

Phase 4: Enterprise Scale (200+ Agents)

- Agents generieren die Mehrheit aller PRs

- Dediziertes AI-Ops-Team für Wartung und Optimierung

- Kontinuierliche Verbesserung durch Feedback-Loops

Typische Herausforderungen

- Context Window Limits: Grosse Codebases passen nicht in ein Kontext-Fenster

- Abhängigkeiten: Agent A ändert Code, den Agent B benötigt

- Merge Conflicts: Wenn mehrere Agents dieselbe Datei ändern

- Kosten: Tausende Agent-Runs pro Tag kosten Geld (Token-Management!)

Lektion 7: Dein Einstieg in Production AI Coding

Für Einzelentwickler und kleine Teams

Du musst nicht Stripe sein, um AI Coding in Production einzusetzen:

Setup 1: Claude Code + GitHub Actions

- Nutze Claude Code für die Code-Generierung

- Konfiguriere GitHub Actions für automatische Tests

- Erstelle ein Review-Checklist-Template für AI-generierten Code

- Starte mit nicht-kritischen Teilen der Codebase

Setup 2: Agent Teams für Projekte

- Definiere Agent-Rollen: Coder, Tester, Reviewer

- Nutze Claude Code Agent Teams oder ähnliche Frameworks

- Jeder Agent hat klare Aufgaben und Grenzen

- Ein menschlicher "Tech Lead" überwacht und approved

Checkliste: Ist dein Team bereit?

- [ ] Automatisierte Test-Suite vorhanden (mindestens 60% Coverage)

- [ ] CI/CD-Pipeline eingerichtet

- [ ] Code-Review-Prozess etabliert

- [ ] Monitoring und Alerting aktiv

- [ ] Rollback-Strategie dokumentiert

- [ ] Team hat Erfahrung mit AI-Coding-Tools

Die wichtigsten Metriken

| Metrik | Ziel | Warum wichtig |

|---|

| PR Acceptance Rate | >80% | Qualität der AI-generierten PRs |

| Time to Merge | <4h | Geschwindigkeit des Prozesses |

| Bug Escape Rate | <5% | Wie viele Bugs schaffen es in Production |

| Test Coverage Delta | >0% | Verbessert sich die Testabdeckung? |

| Developer Satisfaction | >4/5 | Hilft das System dem Team wirklich? |

Zusammenfassung

Die Kernbotschaften

- Production AI Coding ist kein Zukunftsthema -- Stripe, Google und andere machen es heute

- Qualitätssicherung ist der Schlüssel: Nicht die Code-Generierung ist schwer, sondern die Verifikation

- Starte klein: Pilot → Team → Organisation → Enterprise

- Menschen bleiben im Loop: AI generiert, Menschen entscheiden

- Infrastruktur zürst: Ohne gute Tests und CI/CD kein Production AI

Dein nächster Schritt

- Diese Woche: Richte Claude Code oder Cursor in deinem Projekt ein

- Diesen Monat: Lass einen AI Agent deine ersten 10 PRs schreiben

- Dieses Quartal: Etabliere einen AI-Coding-Workflow für dein Team

- Dieses Jahr: Skaliere auf 50+ AI-generierte PRs pro Woche

Die Zukunft der Software-Entwicklung ist nicht "KI ersetzt Entwickler" -- sie ist "Entwickler mit KI-Agents sind 10x produktiver als ohne."