Physical AI: Wenn künstliche Intelligenz die reale Welt betritt

Lektion 1: Von der Textbox in die physische Welt

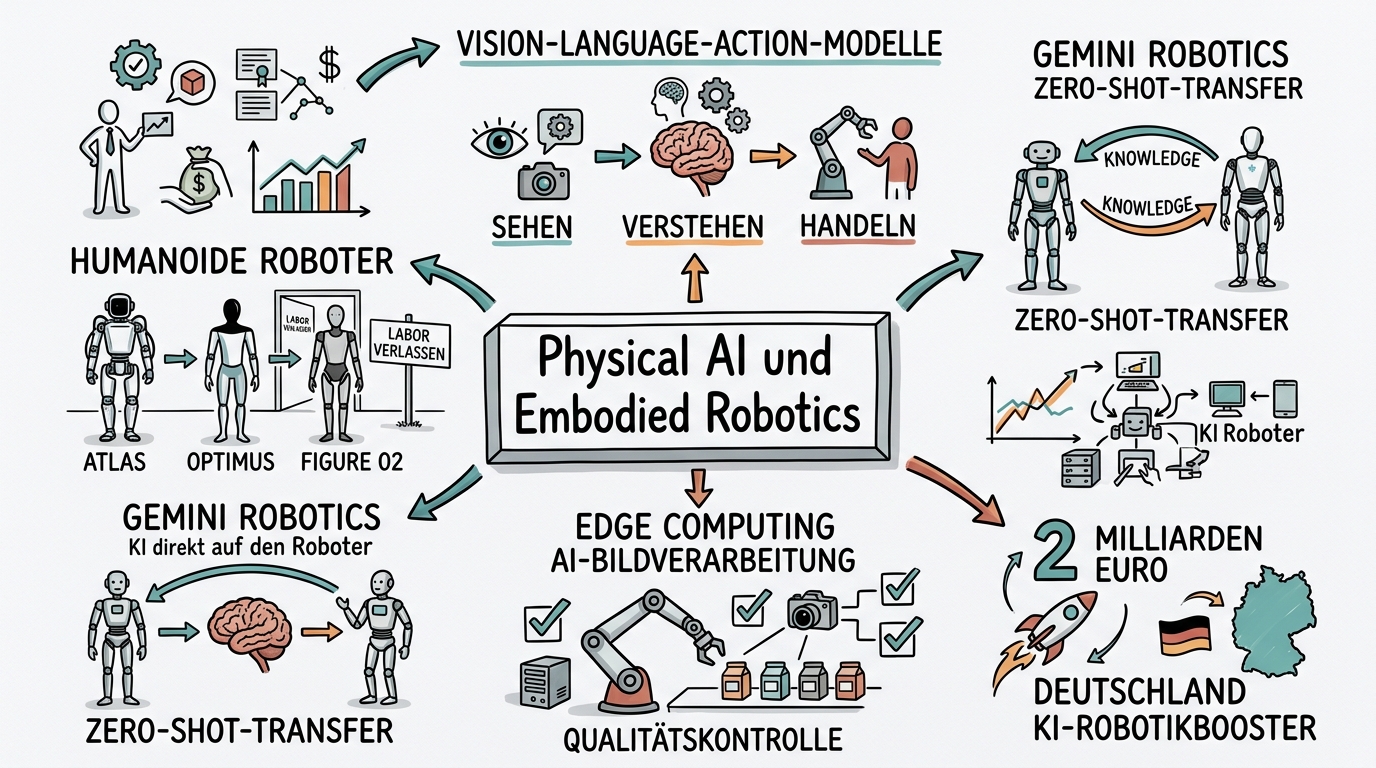

Künstliche Intelligenz hat in den vergangenen Jahren vor allem in der digitalen Welt brilliert: Texte schreiben, Bilder generieren, Code erzeugen. Doch 2026 markiert einen Wendepunkt. KI verlässt den Bildschirm und beginnt, direkt mit der physischen Welt zu interagieren. Roboter, die sehen, verstehen und handeln können, sind keine Science-Fiction mehr — sie arbeiten bereits in Lagerhallen, Fabriken und zunehmend auch in Haushalten.

Der Begriff Physical AI beschreibt KI-Systeme, die in physischen Körpern agieren und ihre Umgebung durch Sensoren wahrnehmen, durch Sprach- und Bildmodelle verstehen und durch Aktuatoren verändern können. Der entscheidende Durchbruch der letzten zwei Jahre waren sogenannte Vision-Language-Action-Modelle, kurz VLAs. Diese Modelle verbinden drei Fähigkeiten, die bisher getrennt waren: Sie sehen die Welt durch Kameras, verstehen Anweisungen in natürlicher Sprache und übersetzen beides in präzise Bewegungen. Statt einen Roboter für jede einzelne Aufgabe zu programmieren, kann man ihm einfach sagen: "Räum den Tisch ab" — und er versteht, was zu tun ist.

Nvidia-CEO Jensen Huang hat Physical AI als "die nächste Welle der künstlichen Intelligenz" bezeichnet und Milliarden in die Entwicklung von Plattformen wie Omniverse und Isaac investiert, die als Trainingsumgebungen für physische KI dienen. Die Idee: Roboter lernen in simulierten Welten, bevor sie in der realen Welt eingesetzt werden. Das reduziert Kosten, Risiken und Trainingszeit dramatisch.

Die wirtschaftliche Dimension ist enorm. Goldman Sachs schätzt den Markt für humanoide Roboter auf 38 Milliarden Dollar bis 2035. China hat mit einem 138-Milliarden-Dollar-Investitionsprogramm die Führung übernommen und kontrolliert 2026 rund 70 Prozent des globalen Marktes für Embodied-AI-Produkte. Europa und insbesondere Deutschland reagieren mit eigenen Initiativen — doch der Vorsprung ist beträchtlich.

Lektion 2: Die Roboter-Revolution — Atlas, Optimus, Figure und Co.

Wenn man die Entwicklung humanoider Roboter in den letzten 24 Monaten betrachtet, scheint es, als hätte jemand die Geschwindigkeit verdreifacht. Boston Dynamics, jahrzehntelang bekannt für beeindruckende aber unpraktische Demos, hat 2026 die Serienproduktion seines elektrischen Atlas-Roboters gestartet. Der neue Atlas ist nicht mehr der stürzende Laborroboter vergangener YouTube-Videos, sondern ein industrietaugliches System, das in Hyundai-Werken Bauteile handhabt und Qualitätskontrollen durchführt.

Tesla verfolgt mit Optimus einen radikal anderen Ansatz: vertikale Integration und Massenproduktion. Elon Musk hat den humanoiden Roboter als "das wichtigste Produkt, das Tesla je bauen wird" bezeichnet und plant eine Produktionslinie für eine Million Einheiten in Fremont sowie eine zweite für zehn Millionen Einheiten jährlich. Der angestrebte Preis von 20.000 bis 30.000 Dollar liegt deutlich unter dem, was industrielle Robotiksysteme heute kosten. Laut Musk gibt es drei entscheidende Herausforderungen für humanoide Roboter — das Engineering der Hand, Real-World-KI und Volumenproduktion — und Tesla sei das einzige Unternehmen, das alle drei beherrsche. Ob diese ambitionierten Zeitpläne realistisch sind, wird in der Branche kontrovers diskutiert, aber die Signalwirkung auf den Markt ist unbestreitbar.

Figure AI hat mit dem Figure 03 und seinem Helix-2-Modell den vielleicht beeindruckendsten Meilenstein gesetzt. Der Roboter absolvierte die längste autonom durchgeführte Aufgabe eines humanoiden Roboters überhaupt: das vollständige Ausräumen einer Spülmaschine mit 61 Manipulationsaktionen, ohne menschlichen Eingriff und ohne Resets. Das Helix-2-Modell ist ein einziges neuronales Netzwerk mit 10 Millionen Parametern, das den gesamten Körper steuert und Befehle mit 1.000 Hertz ausgibt. Die Drei-System-Architektur — System Zero für menschenähnliche Ganzkörper-Kontrolle, System 1 für Manipulation und System 2 für Planung — wurde mit 1.000 Stunden menschlicher Bewegungsdaten trainiert. Besonders bemerkenswert: Der Roboter nutzt seinen ganzen Körper als Werkzeug, schliesst Schubladen mit der Hüfte und hebt Türen mit dem Fuss an, wenn die Hände belegt sind.

Agility Robotics geht mit Digit einen pragmatischeren Weg. Statt eines menschenähnlichen Designs hat Digit ein funktionales Design für Logistik-Aufgaben. Amazon hat in grossem Massstab in Agility investiert und testet Digit in seinen Fulfillment-Centern für Aufgaben wie das Bewegen von Kisten und das Befüllen von Regalen. Der Vorteil gegenüber traditioneller Lagerautomatisierung: Digit kann in Umgebungen arbeiten, die für Menschen gebaut wurden, ohne dass die Infrastruktur umgebaut werden muss.

Lektion 3: Gemini Robotics und die KI-Gehirne der Zukunft

Die Hardware ist nur die Hälfte der Geschichte. Der eigentliche Durchbruch bei Physical AI liegt in den KI-Modellen, die als Gehirn der Roboter fungieren. Google DeepMind hat mit Gemini Robotics ein System vorgestellt, das die Grenze zwischen Sprachmodell und Robotersteuerung aufhebt.

Gemini Robotics verfolgt drei Schlüsselqualitäten: General — nie gesehene Situationen bewältigen können, Interactive — in Echtzeit auf Veränderungen reagieren, und Dextrous — Feinmotorik beherrschen, bis hin zum Falten von Origami. In Generalisierungstests hat Gemini Robotics die Leistung bisheriger Vision-Language-Action-Modelle mehr als verdoppelt. Ein Roboter, der die Anweisung "Slam Dunk" erhält, versteht das Konzept und setzt es mit einem unbekannten Ball und Korb um, ohne diese Kombination je trainiert zu haben.

Besonders revolutionär ist die On-Device-Variante: Gemini Robotics läuft komplett lokal auf dem Roboter, ohne Cloud-Zugang. Die Anpassung an neue Aufgaben gelingt mit nur 50 bis 100 Demonstrationen statt Tausender Trainingsdaten. Die Embodied-Reasoning-Variante erreicht dabei zwei- bis dreimal höhere Erfolgsraten als das Standard-Gemini-2.0-Modell und kann sogar eigenen Controller-Code in Python generieren. Googles Partner-Ökosystem umfasst Apptronik (350 Millionen Dollar Funding mit Google-Beteiligung), Boston Dynamics und Agility Robotics. Bemerkenswert ist auch Googles "Robot Constitution", inspiriert von Asimovs Robotergesetzen: automatisch generierte Sicherheitsregeln in natürlicher Sprache, die dem Roboter ethische Leitplanken geben.

Nvidia liefert mit seiner Omniverse-Plattform die Trainingsinfrastruktur. In Omniverse werden photorealistische Simulationen der physischen Welt erzeugt, in denen Roboter millionenfach üben können, ohne dass eine echte Tasse zu Bruch geht. Diese Sim-to-Real-Pipeline hat die Trainingszeiten von Monaten auf Stunden reduziert. Ein Roboter kann über Nacht in der Simulation lernen, was er am nächsten Morgen in der realen Fabrikhalle ausführt.

Lektion 4: Cobots und Industrial AI — Die Fabrik wird intelligent

Während humanoide Roboter die Schlagzeilen dominieren, verändern kollaborative Roboter — sogenannte Cobots — die industrielle Fertigung bereits heute. Cobots sind keine Science-Fiction, sondern Alltag in Tausenden von Fabriken weltweit. Der Unterschied zu traditionellen Industrierobotern: Cobots arbeiten direkt neben Menschen, ohne Schutzzaun, und können durch einfaches Vormachen programmiert werden.

KUKA, Universal Robots und ABB dominieren den europäischen Cobot-Markt. Das deutsche Unternehmen KUKA hat mit seinem LBR iisy einen Cobot vorgestellt, der durch KI-gestützte Bildverarbeitung seine Aufgaben selbst optimiert. Statt starr programmierter Bewegungspfade passt er sein Verhalten an wechselnde Bedingungen an — etwa wenn Werkstücke in unterschiedlichen Positionen ankommen oder wenn ein Mensch seinen Arbeitsbereich betritt.

Ein Praxisbeispiel aus der deutschen Automobilindustrie illustriert den Wandel. Ein BMW-Zulieferer in Bayern setzt KI-gestützte Cobots für die Qualitätskontrolle ein. Die Cobots fotografieren jedes Bauteil, analysieren das Bild in Echtzeit und erkennen Oberflächendefekte, die das menschliche Auge übersieht — Risse von 0,1 Millimetern, Farbabweichungen im Mikrometerbereich. Die Fehlerquote sank um 94 Prozent, während die Prüfgeschwindigkeit sich verdreifachte.

Der Trend geht zur kognitiven Fabrik: Maschinen, die nicht nur ausführen, sondern verstehen, planen und lernen. Siemens hat mit dem Industrial Copilot ein KI-System vorgestellt, das Ingenieure bei der Programmierung von Fertigungsanlagen unterstützt. Statt SPS-Code manüll zu schreiben, beschreiben Ingenieure in natürlicher Sprache, was die Anlage tun soll, und der Industrial Copilot erzeugt den Code. Das demokratisiert die Roboterprogrammierung und macht sie auch für Unternehmen zugänglich, die keine Robotik-Spezialisten beschäftigen.

Lektion 5: Service-Roboter — KI im Alltag und in der Pflege

Jenseits der Fabrik dringen KI-gestützte Roboter in den Dienstleistungssektor vor. Hotels, Krankenhäuser, Pflegeheime und Einzelhandelsgeschäfte setzen zunehmend auf Service-Roboter, die einfache aber zeitaufwändige Aufgaben übernehmen. In Japan und Südkorea ist das bereits gängige Praxis — in Europa steckt die Entwicklung noch in den Anfängen, nimmt aber rapide an Fahrt auf.

In der Pflege sind die Erwartungen besonders hoch, denn der Fachkräftemangel in Deutschland ist akut. Rund 500.000 Pflegekräfte fehlen laut Bundesgesundheitsministerium bis 2030. Roboter können dieses Problem nicht lösen, aber sie können Pflegekräfte von zeitraubenden Routinetätigkeiten entlasten. Transportroboter bringen Medikamente und Mahlzeiten, Reinigungsroboter übernehmen die Bodenreinigung, und soziale Roboter wie Pepper oder das japanische PARO bieten Demenz-Patienten Interaktion und emotionale Stimulation.

Ein Modellprojekt des Fraunhofer IPA in Stuttgart zeigt, wie Physical AI in der Pflege konkret aussehen kann. Ein mobiler Assistenzroboter unterstützt Pflegekräfte beim Transfer von bettlägerigen Patienten, bringt Getränke und erinnert Bewohner an ihre Medikamenteneinnahme. Die Pflegekräfte berichten, dass sie durch den Roboter mehr Zeit für die menschliche Zuwendung haben — genau die Aufgabe, die kein Roboter übernehmen kann und soll.

Im Einzelhandel experimentieren Ketten wie Edeka und Rewe mit Inventur-Robotern, die nachts durch die Gänge fahren, Regale scannen und automatisch Nachbestellungen auslösen. Die Technologie ist nicht perfekt — noch haben die Roboter Schwierigkeiten mit unaufgeräumt Regalen und unerwarteten Hindernissen —, aber die Fortschritte der letzten 18 Monate sind beeindruckend.

Lektion 6: Edge Computing und Sicherheit — Die technischen Grundlagen

Physical AI stellt besondere technische Anforderungen, die sich fundamental von cloudbasierter KI unterscheiden. Ein Roboter, der in einer Fabrik arbeitet, kann nicht auf eine Cloud-Antwort warten, die 200 Millisekunden dauert. Wenn ein Roboterarm ein Werkstück greift und erkennt, dass ein Mensch in den Arbeitsbereich tritt, muss die Reaktion in Millisekunden erfolgen, nicht in Sekunden.

Die Lösung heisst Edge Computing: KI-Berechnungen finden direkt auf dem Roboter oder in unmittelbarer Nähe statt, nicht in der Cloud. Nvidia hat mit dem Jetson Thor einen speziell für humanoide Roboter entwickelten Chip vorgestellt, der die Leistung eines kleinen Rechenzentrums in einem energieeffizienten Formfaktor liefert. Qualcomm und Intel bieten ähnliche Lösungen. Die Herausforderung: Grosse Sprachmodelle, die auf Cloud-Servern mit Hunderten von GPUs laufen, müssen so komprimiert werden, dass sie auf einem einzigen Edge-Chip funktionieren — ohne zu viel an Qualität zu verlieren.

Sicherheit ist bei Physical AI existenziell wichtig, denn Fehler haben physische Konsequenzen. Ein Chatbot, der falsch antwortet, ist ärgerlich. Ein Roboter, der falsch greift, kann Sachschäden verursachen oder Menschen verletzen. Die ISO 10218 und ISO/TS 15066 definieren Sicherheitsstandards für kollaborative Roboter, und der EU AI Act stuft viele Physical-AI-Anwendungen als Hochrisiko-Systeme ein, die strenge Auflagen für Testing, Dokumentation und menschliche Aufsicht erfordern.

Ein weiteres technisches Thema ist die Sensor-Fusion: Die Kombination verschiedener Sensortypen — Kameras, LiDAR, Kraftsensoren, taktile Sensoren — zu einem kohärenten Weltmodell. Moderne Roboter nutzen bis zu 50 verschiedene Sensoren gleichzeitig und müssen deren Daten in Echtzeit fusionieren. Diese Fähigkeit ist es, die einen Roboter von einer einfachen Maschine unterscheidet: Er nimmt seine Umgebung wahr und passt sein Verhalten kontinuierlich an.

Lektion 7: Deutschlands Position — Der KI-Robotikbooster und die europäische Strategie

Deutschland hat eine starke Tradition im Maschinenbau und in der Automatisierung, aber bei Physical AI droht das Land den Anschluss zu verlieren. Die Bundesregierung hat darauf mit dem KI-Robotikbooster reagiert, einer Flaggschiff-Massnahme der Hightech Agenda mit einem Gesamtvolumen von über zwei Milliarden Euro.

Der KI-Robotikbooster umfasst vier Saulen: Leitprojekte für Mehrzweckroboter, Schaufenster für Embodied AI, den Ausbau der Forschungsinfrastruktur und den Aufbau von Erprobungs- und Weiterbildungszentren. Das Ziel ist klar: Deutschland soll nicht nur Roboter einsetzen, sondern auch entwickeln und produzieren. Die Fraunhofer-Gesellschaft, das DFKI in Kaiserslautern und die Technische Universität München spielen dabei Schlüsselrollen.

Europas Stärke liegt nicht in der Massenproduktion von Hardware — das beherrscht China besser und billiger — sondern in der spezialisierten Anwendung. Deutsche Unternehmen wie KUKA (inzwischen in chinesischem Besitz), Festo, Beckhoff und Schunk sind Weltmarktführer für Roboterkomponenten und Automatisierungslösungen. Die Strategie muss sein, diese Stärke mit modernen KI-Modellen zu verbinden: europäische Präzisionsrobotik plus amerikanische oder europäische KI-Modelle.

Für Unternehmen, die in Physical AI investieren wollen, ist der Einstieg einfacher als gedacht. Man muss nicht gleich einen humanoiden Roboter kaufen. Der pragmatische Weg führt über Cobots mit KI-Bildverarbeitung für die Qualitätskontrolle, über autonome mobile Roboter für die Intralogistik oder über KI-gestützte Predictive Maintenance für bestehende Maschinenparks. Die Technologie ist reif, die Tools sind verfügbar — was fehlt, sind Fachkräfte und Mut zum Anfangen.

Lektion 8: Ausblick — Wenn Roboter denken lernen

Die nächsten fünf Jahre werden Physical AI von einer Nischentechnologie zur Alltagsrealität machen. Die Konvergenz von leistungsfähigen KI-Modellen, preiswerter Robotik-Hardware und ausgereiften Simulationsumgebungen schafft ein Ökosystem, in dem die Entwicklung exponentiell beschleunigt.

Drei Entwicklungen verdienen besondere Aufmerksamkeit. Erstens die Weltmodelle: KI-Systeme, die nicht nur auf Reize reagieren, sondern ein inneres Modell der physischen Welt aufbauen und Konsequenzen von Handlungen vorhersagen können. Meta und Google arbeiten an solchen Modellen, die einem Roboter erlauben würden, einen Raum zu betreten und sofort zu verstehen, wo Hindernisse sind, was sich bewegt und welche Objekte er manipulieren kann — ohne jeden einzelnen Fall vorher trainiert zu haben.

Zweitens die Schwarmintelligenz: Hunderte oder Tausende von Robotern, die ihr Wissen teilen. Wenn ein Roboter in einer Amazon-Lagerhalle lernt, wie man ein neues Paketformat handhabt, kann dieses Wissen innerhalb von Minuten an alle anderen Roboter weltweit übertragen werden. Dieses kollektive Lernen beschleunigt die Fähigkeitsentwicklung um Grössenordnungen.

Drittens die Mensch-Roboter-Köxistenz: Die gesellschaftliche Frage, wie wir mit Robotern zusammenleben und zusammenarbeiten wollen. Japan ist hier Vorreiter — dort werden Roboter kulturell als Helfer akzeptiert, nicht als Bedrohung. In Europa dominiert noch die Skepsis. Die ethischen Fragen sind berechtigt: Wer haftet, wenn ein autonomer Roboter einen Fehler macht? Wie verhindern wir, dass Physical AI Arbeitsplätze vernichtet statt neue zu schaffen? Und wie stellen wir sicher, dass die Technologie allen zugutekommt, nicht nur denen, die sie sich leisten können?

Diese Fragen müssen jetzt diskutiert werden — nicht erst, wenn die Roboter bereits in unseren Strassen laufen. Denn sie werden kommen, schneller als die meisten erwarten. Die Frage ist nicht ob, sondern wie wir diesen Übergang gestalten.