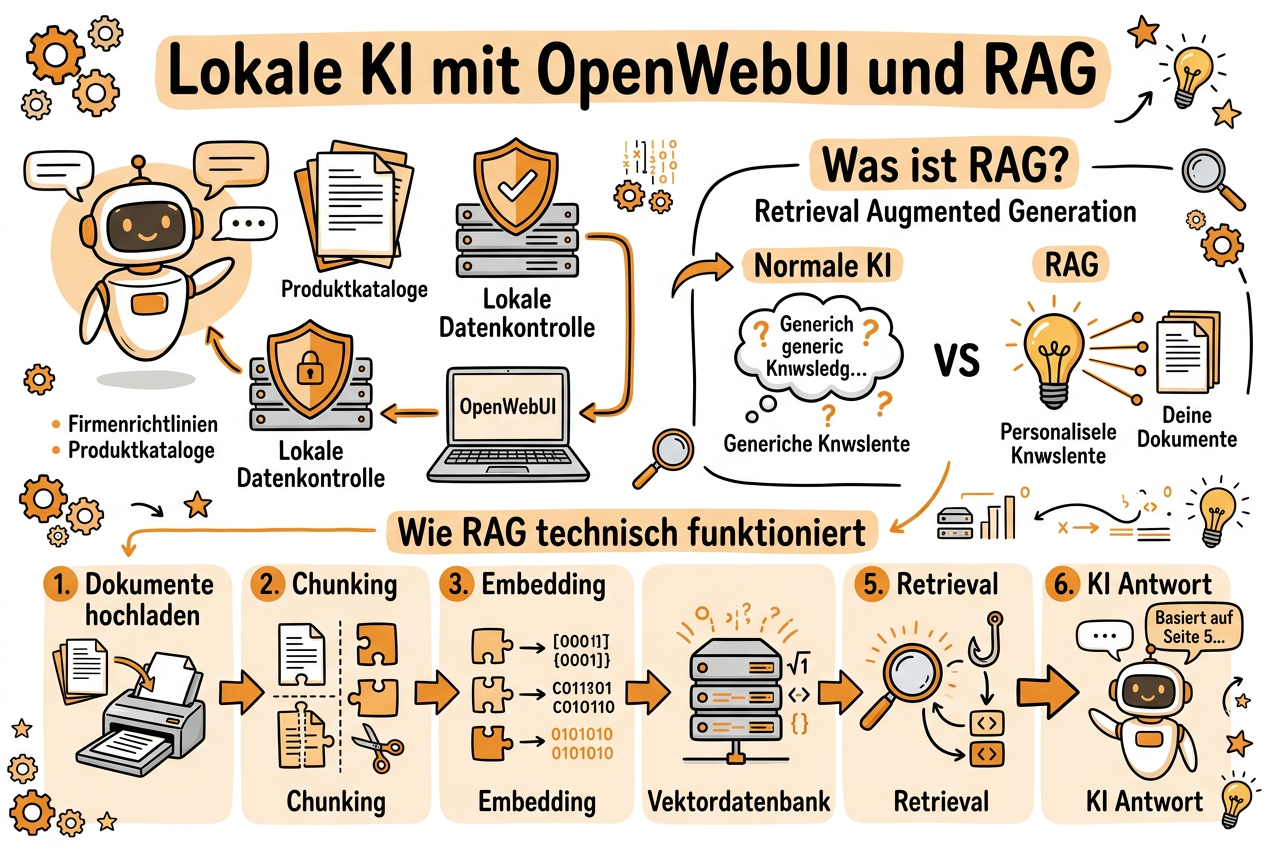

Lokale KI mit OpenWebUI und RAG

Richte deinen eigenen KI-Chatbot ein, der auf deinem Wissen basiert -- mit OpenWebUI, Ollama und Retrieval Augmented Generation

Richte deinen eigenen KI-Chatbot ein, der auf deinem Wissen basiert -- mit OpenWebUI, Ollama und Retrieval Augmented Generation

Klicken zum Vergrößern

Stell dir vor, du hast einen Chatbot, der deine internen Firmenrichtlinien kennt, deine Produktkataloge durchsuchen kann und auf Basis deiner eigenen Dokumente antwortet -- ohne dass ein einziges Wort an externe Server gesendet wird. Genau das ist möglich mit OpenWebUI und RAG.

In diesem Kurs lernst du, wie du deinen eigenen KI-Chatbot mit eigenem Wissen einrichtest. Schritt für Schritt, ohne Programmierkenntnisse, mit maximaler Datenkontrolle.

RAG steht für Retrieval Augmented Generation. Vereinfacht gesagt bedeutet es: Du gibst einem KI-Modell eigenes Wissen mit, und die KI antwortet auf Basis dieses Wissens statt zu raten.

Warum ist das wichtig? Normale KI-Modelle wie ChatGPT oder Claude kennen nur die Informationen, mit denen sie trainiert wurden. Deine internen Dokumente, Firmenrichtlinien, Produktspezifikationen oder branchenspezifisches Fachwissen sind ihnen unbekannt. Mit RAG machst du genau dieses Wissen verfügbar.

Hinter den Kulissen passiert Folgendes:

Normalerweise ist das Einrichten von RAG technisch anspruchsvoll. Du müsstest Skripte schreiben, eine Vektordatenbank konfigurieren und die einzelnen Schritte manüll orchestrieren. OpenWebUI nimmt dir all diese Arbeit ab.

OpenWebUI ist das wahrscheinlich beliebteste Open-Source-Tool für das Verwenden von KI-Modellen. Es bietet eine schöne, ChatGPT-ähnliche Oberfläche und funktioniert sowohl mit lokalen Modellen als auch mit Cloud-Modellen aller Anbieter.

Die grössten Vorteile:

In der linken Seitenleiste von OpenWebUI findest du unter "Arbeitsbereich" den Tab "Wissen". Hier erstellst du deine erste Kollektion:

Jetzt füllst du die Kollektion mit Inhalten:

OpenWebUI übernimmt ab hier die gesamte technische Arbeit: Chunking, Embedding und Speicherung in der Vektordatenbank -- automatisch, im Hintergrund.

Um dein Wissen im Chat zu verwenden, gibt es zwei Wege:

Weg 1: Manüll pro Chat Tippe im Prompt-Feld eine Raute (#) und wähle deine Kollektion aus. Du kannst sogar einzelne Dateien referenzieren, wenn du nur bestimmtes Wissen verwenden willst.

Weg 2: Fest in ein Modell einbinden Unter Admin > Einstellungen > Modelle kannst du eine Wissensdatenbank direkt an ein Modell anbinden. Danach hat dieses Modell automatisch Zugriff auf dein Wissen, ohne dass Nutzer es manüll referenzieren müssen.

Unter Admin > Einstellungen > Dokumente findest du alle RAG-Parameter:

Empfehlung: Lass die Standardwerte zunächst unberührt. Nur wenn die Antwortqualität nicht stimmt, lohnt es sich hier anzupassen.

Das Embedding-Modell wandelt Text in Vektoren um. OpenWebUI nutzt standardmässig das "All-MiniLM-L6-V2"-Modell, das erfahrungsgemäss sehr gut funktioniert.

Auf Hugging Face findest du über 5.000 alternative Embedding-Modelle. Für den Einstieg ist das Standardmodell aber mehr als ausreichend.

Der Top-K Parameter (Standard: 3) bestimmt, wie viele der relevantesten Chunks für eine Antwort herangezogen werden. Bei gezielten Fragen reichen 3 Chunks in der Regel aus. Bei breiteren Themen kannst du auf 5 oder mehr erhöhen.

DigitaleProfis demonstriert die Funktion mit Onboarding-Dokumenten. Auf die Frage "Was sind die wichtigsten Punkte aus der IT-Nutzungsrichtlinie?" liefert das Modell:

Auf die Frage "Was ist das beste E-Bike für leichte Trekkingtouren?" -- die nichts mit den Onboarding-Dokumenten zu tun hat -- reagiert das Modell korrekt:

"Die bereitgestellten Kontextinformationen enthalten keine Antwort auf Ihre Frage, da sie sich ausschliesslich auf interne Onboarding-Dokumente beziehen."

Optional liefert das Modell danach noch allgemeine Informationen aus seinem Training -- aber der entscheidende Hinweis, dass die RAG-Daten keine Antwort enthalten, kommt zuverlässig.

Nachdem du eine Kollektion fest an ein Modell gebunden hast, erkennt das Modell automatisch, wann auf das interne Wissen zugegriffen werden soll. Die Frage "Bitte fasse den Verhaltenskodex unseres Unternehmens zusammen" wird korrekt aus den hinterlegten Dokumenten beantwortet -- mit Quellenangaben und spezifischen Textstellen.

OpenWebUI arbeitet nahtlos mit Ollama zusammen. Damit kannst du Modelle wie Llama, Qwen oder Mistral direkt auf deinem eigenen Rechner ausführen. Alle Daten bleiben lokal -- maximaler Datenschutz.

Voraussetzung: Eine halbwegs aktülle Grafikkarte (GPU) für akzeptable Geschwindigkeit. Ohne GPU laufen die Modelle nur auf der CPU und sind deutlich langsamer.

Du kannst in OpenWebUI auch Cloud-Modelle wie Gemini, GPT oder Claude per API Key einbinden. Damit hast du die neuesten und leistungsfähigsten Modelle, sendest aber Daten an externe Server.

In der Praxis nutzen viele Teams beide Ansätze:

OpenWebUI macht diesen Mix besonders einfach, weil alle Modelle in der gleichen Oberfläche verfügbar sind.

Lokale KI mit OpenWebUI und RAG macht erstmals Wissensmanagement per KI für jeden zugänglich:

Im nächsten Kurs gehen wir einen Schritt weiter und zeigen dir, wie du eine komplette KI-Infrastruktur selbst hostest -- von der Hardware-Auswahl über die Server-Einrichtung bis zum sicheren Betrieb.