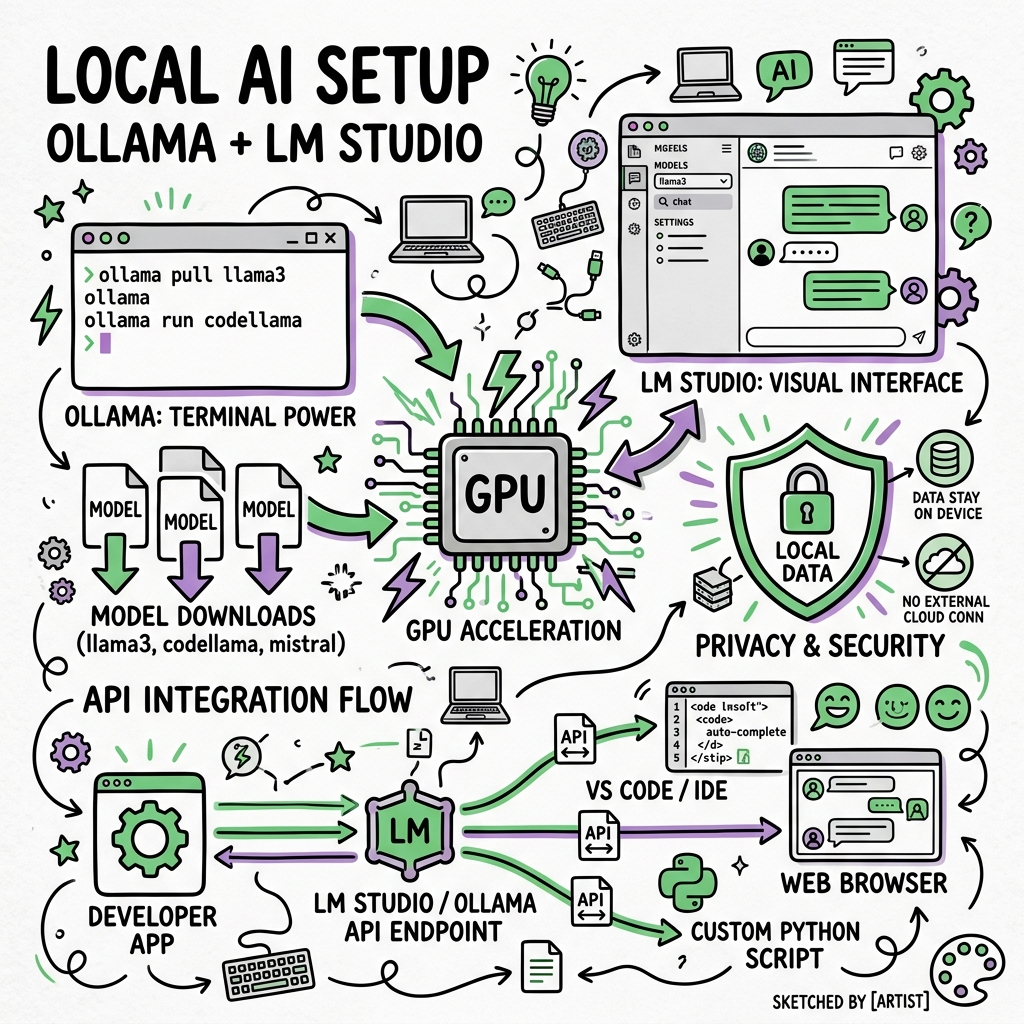

Lokale KI mit Ollama und LM Studio

Praktischer Einstieg in lokale KI-Modelle: Ollama und LM Studio installieren, konfigurieren und in eigene Anwendungen integrieren, komplett offline und datenschutzkonform.

Praktischer Einstieg in lokale KI-Modelle: Ollama und LM Studio installieren, konfigurieren und in eigene Anwendungen integrieren, komplett offline und datenschutzkonform.

Klicken zum Vergrößern

Nicht jede KI-Anwendung muss über die Cloud laufen. Lokale KI-Modelle bieten maximale Datensouveränität, keine laufenden API-Kosten und volle Kontrolle über die Infrastruktur. Dieser Kurs zeigt Ihnen Schritt für Schritt, wie Sie mit Ollama und LM Studio leistungsfähige Sprachmodelle auf Ihrem eigenen Rechner betreiben.

Sie lernen, welche Modelle für welche Aufgaben geeignet sind, wie Sie die Performance optimieren und wie Sie lokale KI in Ihre eigenen Anwendungen integrieren.

Datenschutz und Compliance: Ihre Daten verlassen niemals den eigenen Rechner oder Server. Für Unternehmen mit strengen Datenschutzanforderungen, etwa im Gesundheitswesen, bei Anwaltskanzleien oder im Finanzsektor, ist das oft die einzige Option.

Keine API-Kosten: Cloud-basierte KI-Dienste berechnen pro Token. Bei intensiver Nutzung summiert sich das schnell auf Hunderte oder Tausende Euro monatlich. Ein lokales Modell verursacht nach der Anschaffung der Hardware keine laufenden Kosten.

Offline-Fähigkeit: Lokale Modelle funktionieren ohne Internetverbindung. Ideal für Umgebungen mit eingeschränkter Konnektivität oder für Anwendungsfälle, bei denen Latenz kritisch ist.

Anpassbarkeit: Sie können lokale Modelle fine-tunen, mit eigenen Daten erweitern und exakt auf Ihre Bedürfnisse zuschneiden.

Lokale KI ist ideal für: vertrauliche Dokumente, repetitive Aufgaben mit vorhersagbarem Volumen, Echtzeit-Anwendungen und Umgebungen ohne stabile Internetverbindung.

Cloud-KI bleibt überlegen bei: komplexen Reasoning-Aufgaben, multimodalen Anwendungen (Bild und Video), wenn die neuesten Modelle benötigt werden und bei geringem, unregelmäßigem Nutzungsvolumen.

Ollama ist ein Open-Source-Tool, das die Installation und Nutzung von Large Language Models auf dem eigenen Rechner radikal vereinfacht. Statt komplizierter Python-Setups und Dependency-Management reicht ein einziger Befehl.

macOS und Linux: ```bash curl -fsSL https://ollama.com/install.sh | sh ```

Windows: Laden Sie den Installer von ollama.com herunter und folgen Sie dem Setup-Assistenten.

```bash ollama pull llama3.1 ollama run llama3.1 ```

Das war's. In weniger als fünf Minuten haben Sie ein leistungsfähiges Sprachmodell auf Ihrem Rechner laufen. Sie können sofort Fragen stellen, Texte zusammenfassen oder Code generieren.

Ollama stellt automatisch eine REST-API auf Port 11434 bereit:

```bash curl http://localhost:11434/api/generate -d '{ "model": "llama3.1", "prompt": "Erkläre Quantencomputing in drei Sätzen." }' ```

Diese API ist kompatibel mit dem OpenAI-Format, sodass viele bestehende Tools und Bibliotheken ohne Änderung funktionieren.

LM Studio bietet eine elegante grafische Oberfläche für lokale KI-Modelle. Ideal für alle, die lieber mit einer visüllen Anwendung arbeiten als mit dem Terminal.

Ollama ist die bessere Wahl, wenn Sie: über die Kommandozeile arbeiten, Automatisierung brauchen, mehrere Modelle per Skript verwalten oder einen Server ohne GUI betreiben.

LM Studio eignet sich besser, wenn Sie: eine visülle Oberfläche bevorzugen, Modelle vergleichen möchten, schnell verschiedene Konfigurationen testen oder nicht-technischen Kollegen den Zugang ermöglichen wollen.

Beide Tools können parallel installiert sein. Viele Profis nutzen LM Studio zum Testen und Ollama für die Produktion.

Die Open-Source-Modellwelt entwickelt sich rasant. Die wichtigsten Modellfamilien:

Meta Llama 3.1/3.2: Der Allrounder. Verfügbar in 8B, 70B und 405B Parametern. Das 8B-Modell läuft auf den meisten modernen Laptops flüssig. Stark bei mehrsprachigen Aufgaben, auch auf Deutsch.

Mistral/Mixtral: Französisches Modell mit exzellenter Effizienz. Mixtral nutzt eine Mixture-of-Experts-Architektur, die bessere Ergebnisse bei geringerem Ressourcenverbrauch liefert.

Microsoft Phi-3/Phi-4: Kleine, aber überraschend leistungsfähige Modelle. Phi-3 Mini mit nur 3,8B Parametern schlägt viele größere Modelle bei Reasoning-Aufgaben.

Google Gemma 2: Kompakte Modelle mit 2B und 9B Parametern. Besonders gut für Zusammenfassungen und Texterstellung.

Qwen 2.5: Starkes Modell von Alibaba, besonders gut bei Code und Mathematik. Verfügbar von 0,5B bis 72B Parameter.

Modelle werden in verschiedenen Quantisierungsstufen angeboten (Q4_K_M, Q5_K_M, Q8_0, etc.). Niedrigere Quantisierung bedeutet kleinere Dateien und schnellere Ausführung, aber leicht reduzierte Qualität. Für die meisten Anwendungsfälle ist Q4_K_M ein guter Kompromiss.

Für ein 7B-Modell in Q4-Quantisierung benötigen Sie mindestens: 8 GB RAM, eine moderne CPU (Apple M1/M2/M3 oder Intel/AMD mit AVX2) und 5 GB freien Speicherplatz.

Eine dedizierte GPU beschleunigt die Inferenz dramatisch:

Sowohl Ollama als auch LM Studio bieten eine API, die kompatibel mit der OpenAI-Schnittstelle ist. Das bedeutet: Jede Anwendung, die mit ChatGPT funktioniert, kann mit minimalen Änderungen auf ein lokales Modell umgestellt werden.

Python-Beispiel mit dem OpenAI SDK: ```python from openai import OpenAI

client = OpenAI( base_url="http://localhost:11434/v1", api_key="nicht-nötig" )

response = client.chat.completions.create( model="llama3.1", messages=[{"role": "user", "content": "Fasse diesen Vertrag zusammen..."}] ) ```

Retrieval-Augmented Generation funktioniert hervorragend mit lokalen Modellen. Kombinieren Sie Ollama mit einer lokalen Vektordatenbank wie Qdrant oder ChromaDB, und Sie haben ein vollständig privates Wissenssystem.

Mit Ollama Modelfiles können Sie Modelle anpassen: ``` FROM llama3.1 PARAMETER temperature 0.3 SYSTEM "Du bist ein Experte für deutsches Vertragsrecht. Antworte präzise und mit Paragraphenverweisen." ```

Speichern Sie das als Datei und erstellen Sie Ihr Custom-Modell: `ollama create vertragsexperte -f Modelfile`

Lokale KI löst mehrere DSGVO-Herausforderungen:

Wenn Sie Ollama oder LM Studio im Firmennetzwerk bereitstellen:

Einzelplatz: Ein Entwickler oder Analyst nutzt Ollama auf dem eigenen Rechner. Einfachste Variante, kein Setup nötig.

Team-Server: Ollama läuft auf einem dedizierten Server mit GPU. Teammitglieder greifen über die API oder ein Frontend wie Open WebUI zu.

On-Premises-Cluster: Für große Organisationen: Mehrere GPU-Server mit Load Balancing. Tools wie vLLM oder TGI ermöglichen hohen Durchsatz.

Lokale KI ist keine Kompromisslösung, sondern eine strategische Entscheidung. Mit Ollama und LM Studio stehen Werkzeuge zur Verfügung, die den Einstieg in wenigen Minuten ermöglichen. Die Kombination aus Datenschutz, Kosteneffizienz und Anpassbarkeit macht lokale Modelle für viele Anwendungsfälle zur besseren Wahl als Cloud-Dienste.