Legal Tech: Wie KI die Rechtsbranche transformiert

Lektion 1: Die stille Revolution in den Kanzleien

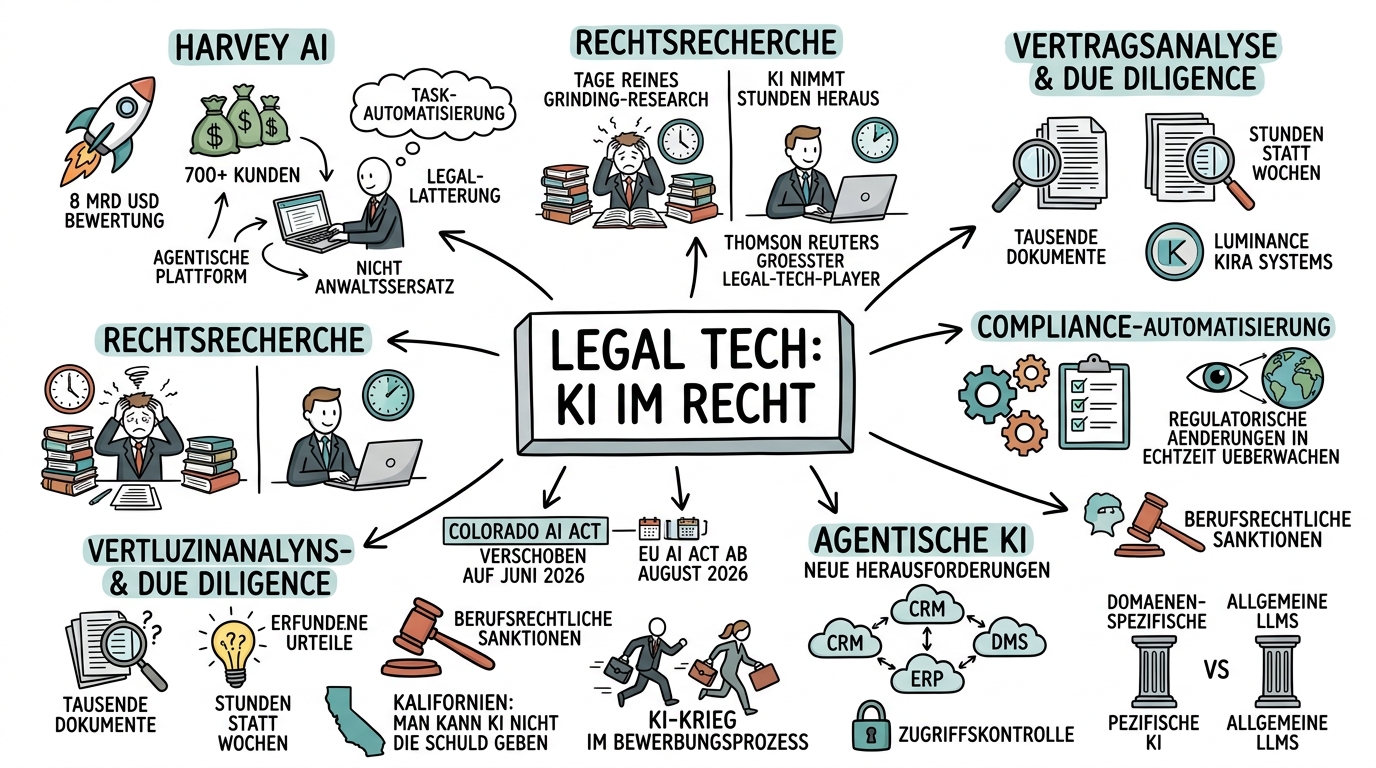

Die Rechtsbranche galt lange als digitalisierungsresistent. Während andere Branchen längst auf KI-gestützte Prozesse umgestellt hatten, arbeiteten Anwälte noch mit denselben Methoden wie vor zwanzig Jahren: manülle Recherche in Datenbanken, stundenlange Dokumentenprüfung und handschriftliche Vertragsanmerkungen. Das hat sich 2025 und 2026 grundlegend geaendert. Harvey AI, das führende Legal-KI-Unternehmen, wurde Ende 2025 mit 8 Milliarden US-Dollar bewertet und zählte bereits über 700 globale Kanzlei- und Unternehmenskunden. Die Investorenrunde über 160 Millionen US-Dollar wurde von Schwergewichten wie Sequoia, Kleiner Perkins, a16z und Google Ventures angeführt.

Was diese Entwicklung besonders macht: Es handelt sich nicht um eine oberflächliche Automatisierung einfacher Aufgaben. Harvey CEO Winston Weinberg beschreibt die Komplexität des juristischen Feldes als einzigartig: "Im Recht ist es unglaublich komplex und es ist ein Mehrspielerspiel." Verschiedene spezialisierte Anwälte, Kanzleien und Fortune-500-Unternehmen müssen interagieren, wobei strikte Vertraulichkeit und sogenannte Ethical Walls eingehalten werden müssen. Eine KI-Plattform für Kanzleien muss daher weit mehr leisten als ein einfacher Chatbot: Sie muss Integration, Sicherheit, granulare Berechtigungen und korrekte Datengrundierung bieten.

Gleichzeitig bleiben die Erwartungen realistisch. Weinberg betont: "Das ist Task-Automatisierung, und ich denke, das wird immer Task-Automatisierung bleiben." Anwälte werden nicht ersetzt, ihre Arbeit wird aufgewertet. Die KI übernimmt die zeitraubenden Routineaufgaben, während die strategische Beratung, das Mandantengespräch und die kreative Argumentationsführung in menschlicher Hand bleiben. Der Trend geht vom klassischen Subscription-Modell hin zu Outcome-basiertem Pricing, bei dem Kanzleien nicht für die Nutzung der Software zahlen, sondern für die erzielten Ergebnisse.

Lektion 2: KI-gestützte Rechtsrecherche

Juristische Recherche ist das Herzsteuck der anwaltlichen Arbeit und gleichzeitig ihr grösster Zeitfresser. Bei komplexen Milliardenklagen dauert die Recherche Tage, manchmal Wochen, in denen Anwälte Gesetze, Urteile, Kommentare und Fachartikel durcharbeiten, Argumente und Gegenargumente abwägen und Präzedenzfälle aus verschiedenen Rechtsordnungen vergleichen. Alexander, Co-Lead AI Research bei Thomson Reuters, dem grössten Anbieter juristischer Fachinformation, beschreibt es unverblümt: "Juristische Recherchefragen erfordern Tage und Tage reines Grinding-Research, um alle Nuancen, Argumente, Gegenargumente und Gesetze herauszuarbeiten."

KI-gestützte Rechtsrecherche kann Stunden aus diesem Prozess herausnehmen. Moderne Systeme durchsuchen nicht einfach Datenbanken nach Stichworten, sondern verstehen die juristische Fragestellung im Kontext. Sie identifizieren relevante Urteile, erkennen Argumentationsmuster und können sogar Gegenargumente antizipieren. Thomson Reuters baut seine KI-Forschungskapazitäten durch gezielte Akquisitionen spezialisierter Unternehmen systematisch aus, weil die vertikale Spezialisierung in der juristischen KI dem Einsatz allgemeiner Sprachmodelle deutlich überlegen ist.

Die Unterscheidung zwischen domänenspezifischer KI und allgemeinen Sprachmodellen ist im Recht besonders wichtig. Ein allgemeines Modell wie ChatGPT kann zwar juristische Texte plausibel formulieren, neigt aber zu sogenannten Halluzinationen: Es erfindet Urteile, die nie existiert haben, oder zitiert Gesetze mit falschen Paragraphen. In keiner anderen Branche sind solche Fehler so gefährlich wie im Recht, wo ein falsches Zitat die Glaubwürdigkeit eines Anwalts vor Gericht zerstören kann. Spezialisierte Legal-KI-Systeme vermeiden dieses Problem, indem sie ihre Antworten konsequent auf verifizierte Rechtsquellen gründen und jede Aussage mit einer nachprüfbaren Quellenangabe versehen.

Lektion 3: Vertragsanalyse und Dü Diligence

Die automatisierte Vertragsanalyse ist einer der reifsten Anwendungsfälle für KI im Recht. Bei einer Dü Diligence im Rahmen einer Unternehmensübernahme müssen Anwälte innerhalb weniger Wochen tausende von Verträgen, Beschlüssen, Protokollen und anderen Dokumenten prüfen. Traditionell sitzen Teams von Junganwälten wochenlang in Datenräumen und markieren relevante Klauseln. KI-Systeme erledigen diese Arbeit in einem Bruchteil der Zeit und mit höherer Konsistenz.

Plattformen wie Harvey AI, Luminance und Kira Systems analysieren Verträge nicht nur auf Schlüsselwörter, sondern verstehen deren rechtliche Bedeutung im Kontext. Sie erkennen ungewöhnliche Klauseln, identifizieren Risiken wie einseitige Kündigungsrechte oder ungünstige Haftungsregelungen und markieren Abweichungen von Standardverträgen. Ein Anwalt, der früher drei Tage für die Prüfung von hundert Mietverträgen brauchte, kann dieselbe Aufgabe mit KI-Unterstützung in wenigen Stunden erledigen und sich dabei auf die wirklich kritischen Punkte konzentrieren.

Bei der Vertragserstellung unterstützen KI-Systeme durch die Generierung von Erstentwürfen, die auf der Analyse tausender vergleichbarer Verträge basieren. Der Anwalt gibt die wesentlichen Parameter ein, etwa Vertragsparteien, Gegenstand, Laufzeit und besondere Bedingungen, und das System generiert einen strukturierten Entwurf, der die gängigen Standards und Best Practices der jeweiligen Vertragsart berücksichtigt. Die finale Prüfung und Anpassung bleibt selbstverständlich Aufgabe des Anwalts, aber der Zeitaufwand für die erste Fassung sinkt erheblich.

Besonders im internationalen Kontext entfaltet die KI-gestützte Vertragsarbeit ihren vollen Nutzen. Bei grenzüberschreitenden Transaktionen müssen Verträge die Anforderungen mehrerer Rechtsordnungen gleichzeitig erfüllen. KI-Systeme können Klauseln automatisch auf Kompatibilität mit verschiedenen Rechtsordnungen prüfen und auf Konflikte hinweisen, die einem menschlichen Prüfer möglicherweise entgehen würden. Wie Weinberg bemerkt: "In zehn Jahren wird ein Mensch internationale Fusionen nicht mehr ohne KI-Systeme prüfen können, die sich mit allem anderen integrieren."

Lektion 4: Compliance-Automatisierung und Risikobewertung

Die Einhaltung regulatorischer Vorgaben ist für Unternehmen zu einer der grössten Herausforderungen geworden. Die Menge an Gesetzen, Verordnungen und Branchenstandards wächst stetig, und die Konsequenzen bei Verstössen reichen von empfindlichen Geldstrafen bis zum Verlust der Geschäftslizenz. KI-gestützte Compliance-Systeme überwachen regulatorische Änderungen in Echtzeit, bewerten deren Relevanz für das Unternehmen und generieren konkrete Handlungsempfehlungen.

Ein praktisches Beispiel: Ein mittelständisches Unternehmen exportiert in zwanzig Länder. Jede Änderung der Exportkontrollvorschriften, der Sanktionslisten oder der lokalen Produktregulierung muss erfasst, bewertet und umgesetzt werden. Ohne KI erfordert das ein Team von Compliance-Spezialisten, die taglich Hunderte von Quellen überwachen. Mit KI wird die Überwachung automatisiert, während die menschlichen Experten sich auf die Bewertung und Umsetzung der als relevant eingestuften Änderungen konzentrieren können.

Im Bereich der Risikobewertung analysieren KI-Systeme Verträge, Geschäftsprozesse und Korrespondenz auf potenzielle rechtliche Risiken. Sie erkennen Muster, die auf kartellrechtliche Probleme, Datenschutzverstösse oder Compliance-Lücken hindeuten können. Diese präventive Analyse ist besonders wertvoll, weil sie Probleme identifiziert, bevor sie zu kostspieligen Rechtsstreitigkeiten oder Regulierungsverfahren führen.

Die Integration von KI in die Compliance-Funktion verändert auch die Rolle des Compliance-Beauftragten. Statt manüll Checklisten abzuarbeiten und regelmässige Audits durchzuführen, wird er zum Architekten eines intelligenten Überwachungssystems, das kontinuierlich arbeitet und nur dann menschliche Aufmerksamkeit einfordert, wenn tatsächlich Handlungsbedarf besteht. Dieser Wandel erfordert neue Kompetenzen an der Schnittstelle von Recht, Technologie und Datenanalyse.

Lektion 5: KI-Governance und rechtliche Rahmenbedingungen

Die regulatorische Landschaft für KI im Recht ist komplex und entwickelt sich rasant. Eine zentrale Erkenntnis der juristischen Analyse von BakerBotts für 2026 lautet: Das grösste Problem ist nicht KI-spezifische Gesetzgebung, sondern KI, die bestehende Gesetze verletzt. Wenn ein KI-System im Bewerbungsprozess diskriminiert, verstöest es gegen Arbeitsrecht und Gleichbehandlungsgesetze, die längst existieren. Die Besonderheit liegt darin, dass der Verstoss automatisiert und in grossem Massstab geschieht, was ihn schwerer erkennbar, aber in seinen Auswirkungen gravierender macht.

In Kalifornien wurde 2026 ein wegweisendes Prinzip gesetzlich verankert: "Man kann KI nicht die Schuld geben." Unternehmen und die verantwortlichen Personen bleiben für Entscheidungen verantwortlich, auch wenn diese von KI-Systemen unterstützt oder ausgeführt wurden. Dieses Prinzip erinnert an ein berühmtes Zitat aus einem alten IBM-Handbuch: "Ein Computer kann niemals eine Managemententscheidung treffen, weil ein Computer niemals zur Verantwortung gezogen werden kann." Dieser Grundsatz hat in der KI-Ära nichts an Gültigkeit verloren.

Der Colorado AI Act, der ursprünglich im Februar 2026 in Kraft treten sollte, wurde auf Juni 2026 verschoben, während auf Bundesebene Bestrebungen laufen, einzelstaatliche Regelungen durch ein einheitliches Bundesgesetz zu ersetzen. In Europa greift der EU AI Act ab August 2026 vollständig, mit weitreichenden Konsequenzen für den Einsatz von KI in der juristischen Arbeit. Kanzleien müssen dokumentieren, welche KI-Systeme sie einsetzen, wie diese funktionieren und welche Massnahmen zur Qualitätssicherung getroffen werden.

Agentische KI schafft dabei völlig neue Herausforderungen. Wenn ein KI-Agent selbstständig auf CRM-, ERP- oder Dokumentenmanagementsysteme zugreift, um juristische Aufgaben zu erledigen, stellen sich Fragen der Zugangskontrolle, der Disaster Recovery und der Systemhärtung, die über traditionelle IT-Sicherheit hinausgehen. Kanzleien müssen ihre gesamte digitale Infrastruktur darauf überprüfen, ob sie für den Einsatz agentischer KI-Systeme geeignet ist.

Lektion 6: Halluzinationen, Haftung und die Grenzen der KI

Die Gefahr von KI-Halluzinationen ist im juristischen Kontext besonders brisant. Mehrere Fälle, in denen Anwälte von ChatGPT erfundene Urteile in ihre Schriftsätze übernommen hatten, sorgten 2023 und 2024 weltweit für Schlagzeilen und führten zu berufsrechtlichen Sanktionen. Diese Vorfälle haben das Bewusstsein der Branche geschärft, aber das Problem ist nicht verschwunden. Auch spezialisierte Legal-KI-Systeme können fehlerhafte Aussagen generieren, wenngleich deutlich seltener als allgemeine Sprachmodelle.

Die Haftungsfrage bei KI-gestützter Rechtsberatung ist noch weitgehend ungeklärt. Wer haftet, wenn ein KI-System eine falsche Rechtsauskunft gibt, auf deren Basis ein Mandant eine nachteilige Entscheidung trifft? Der Anwalt, der die KI eingesetzt hat? Die Kanzlei? Der Anbieter des KI-Systems? Die meisten Rechtsordnungen gehen davon aus, dass der Anwalt für die Qualität seiner Arbeit verantwortlich bleibt, unabhängig davon, welche Hilfsmittel er einsetzt. Das bedeutet: Jede KI-generierte Aussage muss vom Anwalt überprüft werden, bevor sie verwendet wird.

Die Copyright-Frage bei LLM-Training bleibt ebenfalls ungelöst. Die grossen Frontier-Labs haben ihre Modelle mit urheberrechtlich geschützten Texten trainiert, darunter auch juristische Fachliteratur und Gerichtsentscheidungen. Die laufenden Klagen werden bisher eher durch Vergleiche als durch Urteile beendet, was bedeutet, dass noch keine definitive Rechtsprechung existiert. Für Kanzleien, die eigene KI-Modelle mit ihrem Bestand an Verträgen und Schriftsätzen trainieren möchten, stellen sich ähnliche Fragen: Wem gehören die daraus resultierenden Modelle, und wie verhält es sich mit der Mandantenvertraulichkeit?

Ein bemerkenswerter Nebeneffekt des KI-Einsatzes zeigt sich im Bewerbungsprozess, der sich zu einem regelrechten "KI-Krieg" entwickelt hat. Bewerber nutzen KI für ihre Lebensläufe und Anschreiben, während Arbeitgeber KI für das Screening einsetzen. Beide Seiten schaffen damit Haftungsrisiken: Bewerber, die übertrieben KI-polierte Bewerbungen einreichen, und Arbeitgeber, deren KI-Screening-Tools möglicherweise diskriminieren. Für Kanzleien, die sowohl als Arbeitgeber als auch als Berater ihrer Mandanten agieren, ist dieses Thema doppelt relevant.

Lektion 7: Legal Tech in der Praxis: Der Einstieg für Ihre Organisation

Der Einstieg in Legal Tech beginnt nicht mit der Auswahl einer Software, sondern mit einer ehrlichen Bestandsaufnahme der eigenen Prozesse. Welche Tätigkeiten sind besonders zeitintensiv und repetitiv? Wo passieren die meisten Fehler? Wo klagen Mandanten über lange Bearbeitungszeiten? Die Antworten auf diese Fragen identifizieren die Bereiche, in denen KI den grössten Nutzen stiften kann.

Für eine mittelgrosse Kanzlei empfiehlt sich ein schrittweiser Ansatz. Der erste Schritt ist häufig die Einführung eines KI-gestützten Recherche-Tools, das die bestehende Fachdatenbank ergänzt. Der Zeitgewinn ist sofort spürbar, das Risiko überschaubar und die Akzeptanz bei den Anwälten in der Regel hoch. Im zweiten Schritt folgt die automatisierte Vertragsanalyse für Standardverträge, während komplexe Transaktionen weiterhin manüll bearbeitet werden. Im dritten Schritt können Compliance-Monitoring und Dokumentenerstellung integriert werden.

Die Akzeptanz im Team ist der entscheidende Erfolgsfaktor. Anwälte, die Legal Tech als Bedrohung ihrer Expertise wahrnehmen, werden es sabotieren. Anwälte, die es als Werkzeug verstehen, das sie von Routinearbeit befreit und für die eigentlich wertschöpfende Beratungstätigkeit freisetzt, werden es enthusiastisch nutzen. Die Einführung sollte daher von umfassender Schulung begleitet werden, die nicht nur die Bedienung der Tools vermittelt, sondern auch deren Grenzen transparent macht.

Thomson Reuters, Harvey AI und andere führende Anbieter zeigen, wohin die Reise geht: von einzelnen Tools hin zu integrierten Plattformen, die den gesamten juristischen Workflow abdecken. In zehn Jahren wird es für Anwälte ebenso selbstverständlich sein, mit KI-Unterstützung zu arbeiten, wie es heute selbstverständlich ist, juristische Datenbanken online zu nutzen. Die Kanzleien, die sich jetzt positionieren, werden diese Zukunft gestalten statt ihr hinterherzulaufen.