KI-Videoproduktion: Filme, Clips und Animationen mit künstlicher Intelligenz erstellen

Lektion 1: Die Video-Revolution -- Warum KI-Video 2026 alles verändert

Video ist das dominante Medium unserer Zeit. Über 80 Prozent des gesamten Internetverkehrs entfallen auf Videoinhalte, und dieser Anteil wächst weiter. Gleichzeitig ist professionelle Videoproduktion traditionell teuer, zeitaufwändig und ressourcenintensiv: Kamerateams, Schauspieler, Locations, Post-Produktion -- ein einminütiger Werbespot kann leicht fünf- bis sechsstellige Beträge kosten. KI-Videoproduktion verändert diese Gleichung fundamental und macht hochwertige Bewegtbildinhalte für Unternehmen und Kreative jeder Grösse zugänglich.

Der technologische Fortschritt der letzten zwei Jahre ist atemberaubend. Während frühe KI-Videos (2023/2024) noch durch verschwommene Details, physikalisch unmögliche Bewegungen und flackernde Artefakte auffielen, liefern aktülle Systeme wie Runway Gen-4, Sora und Kling Ergebnisse, die für viele Anwendungsfälle professionell einsetzbar sind. Die Clips sind schärfer, die Bewegungen natürlicher, und die Konsistenz über längere Sequenzen hat sich dramatisch verbessert. Natürlich erreichen wir noch nicht die Qualität einer Hollywood-Produktion, aber für Social Media, Erklärvideos, Produktpräsentationen und Marketing-Content ist die Qualität mehr als ausreichend.

Besonders spannend ist die Demokratisierung: Ein Solo-Content-Creator kann 2026 Videos produzieren, die vor drei Jahren ein Team von zehn Leuten erfordert hätten. Ein Mittelständler kann Produktvideos für seinen Online-Shop erstellen, ohne eine Produktionsfirma beauftragen zu müssen. Und eine Marketingabteilung kann A/B-Tests mit verschiedenen Videovarianten fahren, weil die Produktionskosten pro Variante bei wenigen Euro statt bei Tausenden liegen.

Dieser Kurs führt dich durch die gesamte KI-Videoproduktions-Pipeline: von der Konzeption über die Generierung und Bearbeitung bis zur Veröffentlichung. Du lernst die wichtigsten Tools kennen, verstehst ihre Stärken und Grenzen, und entwickelst Workflows, die KI-Video sinnvoll in deine Kommunikationsstrategie integrieren.

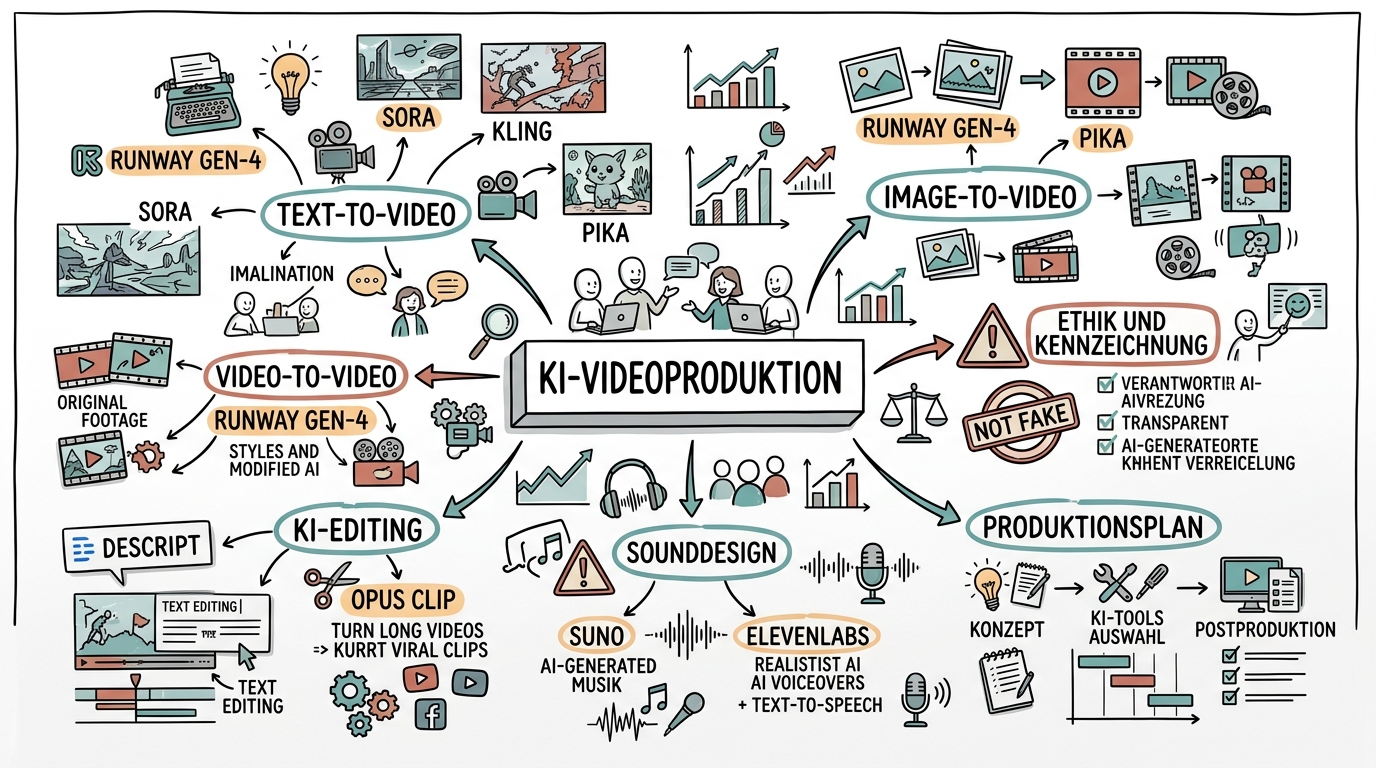

Lektion 2: Die KI-Video-Toollandschaft im Überblick

Das Angebot an KI-Video-Tools ist 2026 umfangreich und kann auf den ersten Blick unübersichtlich wirken. Eine klare Kategorisierung hilft bei der Orientierung: Es gibt Tools für die Generierung von Videoinhalten (Text-to-Video, Image-to-Video), Tools für die intelligente Bearbeitung bestehender Videos, und Tools für spezifische Aufgaben wie Untertitelung, Übersetzung oder Clip-Erstellung.

ByteDances Seedance 2.0 hat sich im März 2026 als neuer Marktführer positioniert. Das revolutionäre @-Referenzsystem erlaubt multimodale Kontrolle auf einem völlig neuen Niveau: Bis zu neun Bilder, drei Videos und drei Audioquellen können als Referenz in einen einzigen Prompt eingebunden werden. Das bedeutet: Du zeigst dem Modell nicht nur, was du willst, sondern gibst ihm visülle, bewegte und klangliche Vorlagen gleichzeitig. Kein anderes Tool bietet aktüll diese Tiefe der kreativen Steuerung.

Runway bleibt als Pionier mit Gen-4 ein Schwergewicht. Die Plattform liefert Clips von bis zu 16 Sekunden Länge in 4K-Auflösung und bietet präzise Kontrolle über Kamerabewegung, Beleuchtung und Stilistik. Die Multi-Motion-Brush-Funktion erlaubt es, verschiedene Bereiche eines Bildes unterschiedlich zu animieren. Runway bietet zudem ein vollständiges Browser-basiertes Studio mit Schnitt, Greenscreen-Entfernung und Farbkorrektur. Die Preise beginnen bei 15 US-Dollar pro Monat für 125 Credits.

OpenAIs Sora hat in Version 2 nachgelegt und überzeugt besonders bei längeren, erzählerischen Clips mit mehreren interagierenden Personen. Sora versteht räumliche Beziehungen besser als die meisten Wettbewerber. Die Integration in ChatGPT Plus macht den Einstieg besonders niedrigschwellig, allerdings zeigen Vergleichstests, dass Seedance 2.0 in den meisten Kategorien inzwischen gleichwertig oder besser abschneidet.

Kling 3.0 von Kuaishou hat sich als Preis-Leistungs-Sieger etabliert: 66 kostenlose Credits täglich, 4K-Auflösung bei 60 fps und beeindruckende 38 steuerbare Kamerabewegungen, die sich direkt im Interface auswählen lassen. Besonders hervorzuheben ist das Multi-Shot-Storyboarding, mit dem sich zusammenhängende Szenenfolgen planen lassen. HailuoAI (MiniMax) besticht durch besonders flüssige Kamerabewegungen und natürliche Bewegungsabläufe. Pika hat sich als Spezialist für kurze Loop-Animationen, Motion Design und Produktanimationen positioniert. Luma Dream Machine bietet solide Text-to-Video-Qualität mit einem grosszügigen kostenlosen Tier.

Ein entscheidendes Praxis-Pattern hat sich unter professionellen KI-Videoproduzenten etabliert: der Multi-Tool-Workflow. Die Besten nutzen verschiedene Modelle für verschiedene Shot-Typen und fügen alles erst im Schnitt zusammen. Kling eignet sich besonders für Actionszenen und Kamerabewegungen, Seedance für referenzbasierte Szenen mit hoher Kontrolle, und Runway für Postproduktion und Stileffekte.

Auf der Bearbeitungsseite stehen Tools wie Descript (Text-basierter Videoschnitt, bei dem du das Video wie ein Textdokument bearbeitest), CapCut (automatische Untertitel, Effekte und Schnittvorschläge) und Opus Clip (automatische Erstellung von Short-Form-Content aus langen Videos). Diese Tools ersetzen nicht das professionelle Editing in Premiere Pro oder DaVinci Resolve, aber sie decken den Grossteil der alltäglichen Videobearbeitung ab und sparen dabei enorm viel Zeit.

Lektion 3: Text-to-Video -- Vom Prompt zum bewegten Bild

Text-to-Video ist die spektakulärste Fähigkeit der aktüllen KI-Videotools, erfordert aber ein Umdenken gegenüber traditioneller Videoproduktion. Du schreibst kein Drehbuch im klassischen Sinn, sondern formulierst Beschreibungen, die das KI-Modell in Bewegtbilder umsetzt. Die Qualität des Ergebnisses steht und fällt mit der Qualität des Prompts.

Ein guter Video-Prompt unterscheidet sich von einem Bild-Prompt durch die zeitliche Dimension. Neben dem Was (Motiv), dem Wie (Stil) und dem Wo (Setting) beschreibst du das Wann (zeitlicher Ablauf) und die Bewegung (Kamera und Objekte). Ein Beispiel: Statt "Eine Frau in einem Büro" schreibst du "Eine Geschäftsfrau mittleren Alters blickt konzentriert auf ihren Laptop, nimmt langsam ihre Lesebrille ab und schaut nachdenklich zum Fenster, während die Kamera langsam von einer Nahaufnahme in eine mittlere Einstellung zurückfährt. Weiches natürliches Licht von links, modernes Büro mit Pflanzen im Hintergrund, filmischer Look mit flacher Schärfentiefe."

Diese Detaillierung mag übertrieben wirken, führt aber zu deutlich besseren Ergebnissen als vage Beschreibungen. Das Modell trifft bei unklaren Anweisungen eigene Entscheidungen, die selten dem entsprechen, was du dir vorstellst. Je präziser du die Szene beschreibst, desto näher kommt das Ergebnis an deine Vision.

Ein bewährter Workflow für Text-to-Video besteht aus vier Phasen. In der Konzeptphase erstellst du eine Sequenzliste: Welche einzelnen Clips brauchst du, um deine Geschichte zu erzählen? Jeder Clip ist eine eigenständige Szene von drei bis zehn Sekunden. In der Generierungsphase erzeugst du für jede Szene drei bis fünf Varianten und wählst die stärkste aus. Qualität schlägt Geschwindigkeit: Nimm dir die Zeit, den Prompt zu verfeinern, bis das Ergebnis überzeugt. In der Assemblierungsphase fügst du die ausgewählten Clips in einem Schnittprogramm zusammen, fügst Übergänge, Musik und Soundeffekte hinzu. In der Finalisierungsphase kommen Text-Overlays, Logo-Animationen und ein abschliessender Color-Grade hinzu.

Wichtig zu verstehen: Kein einzelner Text-to-Video-Clip wird perfekt sein. Die Kunst liegt in der Auswahl und Kombination. Professionelle KI-Videoproduzenten generieren deutlich mehr Material als sie verwenden und schneiden die besten Momente zu einem überzeugenden Gesamtwerk zusammen. Dieser "Überschuss-und-Kuratieren"-Ansatz ist fundamental anders als traditionelle Videoproduktion, wo jeder Drehtag teuer ist und daher möglichst effizient genutzt werden muss.

Lektion 4: Image-to-Video und Video-to-Video -- Mehr Kontrolle

Reines Text-to-Video bietet die grösste kreative Freiheit, aber die geringste Kontrolle über das Ergebnis. Für viele professionelle Anwendungsfälle brauchst du mehr Präzision: Ein bestimmtes Produktfoto soll sich drehen, ein Landschaftsbild soll zum Leben erwachen, ein bestehender Clip soll in einem anderen Stil gerendert werden. Hier kommen Image-to-Video und Video-to-Video ins Spiel.

Image-to-Video ist der derzeit zuverlässigste Weg, kontrollierte KI-Videos zu erstellen. Du startest mit einem sorgfältig ausgewählten oder generierten Standbild und beschreibst dann, wie es sich bewegen soll. Der grosse Vorteil: Das Ausgangsbild bestimmt Komposition, Farben, Stil und Motiv, und die KI muss nur noch die Bewegung hinzufügen. Das reduziert die Variabilität enormen und führt zu konsistenteren Ergebnissen. In Runway aktivierst du dafür den Image-to-Video-Modus, läadst dein Bild hoch und beschreibst die gewünschte Bewegung. Die Motion-Brush-Funktion erlaubt dir sogar, einzelne Bereiche des Bildes zu markieren und ihnen unterschiedliche Bewegungsrichtungen zuzuweisen: Der Himmel bewegt sich langsam nach links, die Blätter im Vordergrund wehen nach rechts.

Ein typischer Produktionsworkflow: Du erstellst zunächst in Midjourney oder Firefly ein hochwertiges Standbild mit exakt der Komposition und dem Stil, die du möchtest. Dann animierst du dieses Bild in Runway oder Kling mit einer präzisen Bewegungsbeschreibung. Das Ergebnis ist deutlich kontrollierter als reines Text-to-Video, weil du einen festen visüllen Ausgangspunkt hast.

Video-to-Video transformiert bestehende Clips in einen neuen Stil. Du filmst eine einfache Szene mit deinem Smartphone und lässt sie von der KI in eine Aquarell-Animation, einen Cyberpunk-Look oder einen Vintage-Filmstil umwandeln. Runway, Pika und Kaiber bieten diese Funktion an. Die Bewegungen des Originals bleiben erhalten, nur die visülle Ästhetik ändert sich. Das ist besonders interessant für Musikvideos, Werbespots und Social-Media-Content, wo ein einzigartiger visüller Stil wichtiger ist als fotorealistische Qualität.

Die Kombination beider Ansätze eröffnet mächtige Workflows. Stell dir vor, du filmst einen einfachen Produktdreh mit deinem Smartphone: Das Produkt auf einem Tisch, sanfte Drehung, weiches Licht. Dann lässt du diesen Clip per Video-to-Video in einen High-End-Werbespot-Look transformieren: dramatische Beleuchtung, cineastische Farbgebung, elegante Zeitlupe. Das Ergebnis sieht nach grossem Budget aus, kostet aber einen Bruchteil einer professionellen Produktion.

Lektion 5: KI im Video-Editing -- Schnitt, Untertitel und Repurposing

Nicht immer geht es darum, Videos komplett neu zu generieren. Häufig ist die wertvollste KI-Anwendung die intelligente Bearbeitung bestehender Videos. Von automatischen Untertiteln über KI-gesteuerten Schnitt bis zur Umwandlung eines einstundigen Webinars in zehn Social-Media-Clips bieten KI-Editing-Tools enormes Potenzial für Content-Teams.

Descript hat das Video-Editing revolutioniert, indem es Video wie Text behandelt. Du importierst ein Video, Descript erstellt automatisch ein vollständiges Transkript, und du bearbeitest das Video, indem du den Text bearbeitest: Löscht du einen Satz im Transkript, wird die entsprechende Stelle im Video geschnitten. Änderst du ein Wort, kann Descript es per KI-Stimme in der Originalstimme des Sprechers ersetzen. Für Content-Creator, die regelmässig Videos mit gesprochenen Inhalten produzieren (Tutorials, Podcasts, Interviews), ist Descript ein enormer Zeitsparer.

Opus Clip hat sich als das führende Tool für "Repurposing" etabliert: Du gibst ein langes Video ein (Webinar, Podcast-Aufnahme, YouTube-Video) und erhältst automatisch mehrere kurze Clips, die für TikTok, Instagram Reels und YouTube Shorts optimiert sind. Die KI erkennt die interessantesten Momente, schneidet sie heraus, fügt automatische Untertitel hinzu und formatiert den Clip im Hochformat. Die Qualität der automatischen Selektion ist überraschend gut: In Tests erkennt Opus Clip zuverlässig emotionale Höhepunkte, prägenante Aussagen und humorvolle Momente.

CapCut, ursprünglich als einfacher Mobile-Editor gestartet, hat sich zu einem vollwertigen KI-Video-Editor entwickelt. Die automatische Untertitelung ist branchenführend genau und unterstützt über 50 Sprachen. Die Auto-Reframe-Funktion passt Videos automatisch an verschiedene Seitenverhältnisse an und verfolgt dabei intelligent das Hauptmotiv. Und die KI-Effektbibliothek bietet hunderte vorgefertigte Animationen und Übergänge, die mit einem Klick angewendet werden können.

Für Unternehmen, die regelmässig Video-Content produzieren, hat sich ein dreistufiger Repurposing-Workflow bewährt. Stufe eins ist die Produktion eines "Mastervideos" pro Woche, etwa ein ausführliches Erklärvideo oder Interview von 15 bis 30 Minuten Länge. Stufe zwei ist die automatische Extraktion von fünf bis zehn Kurzclips durch Opus Clip oder CapCut, jeweils mit Untertiteln und im richtigen Format für die jeweilige Plattform. Stufe drei ist die manülle Kuration: Ein Mensch prüft die generierten Clips, wählt die stärksten aus, und plant sie über die Woche verteilt zur Veröffentlichung. Dieser Workflow liefert aus einer einzigen Produktion genug Content für eine ganze Woche auf mehreren Kanälen.

Lektion 6: Sounddesign und Vertonung mit KI

Ein Video ohne guten Sound ist wie ein Restaurant ohne Würzung: technisch funktional, aber emotional flach. Sounddesign -- die Kombination aus Musik, Soundeffekten, Voiceover und Atmosphäre -- macht aus bewegten Bildern ein emotionales Erlebnis. KI-Tools haben diesen traditionell aufwändigen Produktionsschritt dramatisch vereinfacht und zugänglich gemacht.

Für die musikalische Untermalung bieten sich verschiedene Ansätze an. Suno und Udio generieren auf Textbeschreibung hin vollständige Musikstücke inklusive Gesang. Für Hintergrundmusik in Unternehmensvideos, Podcast-Intros oder Social-Media-Content ist die Qualität 2026 vollkommen ausreichend. Der Prompt "Upbeat, optimistic corporate background music, acoustic guitar and light piano, 120 BPM, 90 seconds" liefert in unter einer Minute ein verwendbares Ergebnis. Für mehr Kontrolle über Stil und Struktur bieten Soundtrack-Generatoren wie AIVA und Mubert die Möglichkeit, Musik nach Stimmung, Genre, Dauer und Instrumentierung zu parametrisieren.

ElevenLabs und PlayHT haben die Sprachsynthese auf ein Niveau gebracht, das professionelle Sprecher für viele Anwendungsfälle ersetzen kann. Die Stimmen klingen natürlich, emotional nuanciert und sind in Dutzenden von Sprachen verfügbar. Für Erklärvideos, E-Learning-Inhalte und interne Kommunikation spart das nicht nur Kosten für Sprecherbuchungen, sondern vor allem Zeit: Änderungen am Text erfordern keine erneute Aufnahme-Session, sondern nur eine Neugenerierung des betreffenden Abschnitts.

KI-Soundeffekte sind ein noch junges, aber schnell wachsendes Feld. Tools wie ElevenLabs Sound Effects und Stability Audio erzeugen Umgebungsgeräusche, Foley-Sounds und atmosphärische Klanglandschaften auf Textbeschreibung. Für die meisten Videoproduktionen reichen diese generierten Sounds aus, während High-End-Produktionen weiterhin auf professionelle Sound-Libraries zurückgreifen.

Der praktische Rat für die Vertonung von KI-Videos: Erstelle zürst den visüllen Schnitt ohne Sound, definiere dann die emotionale Kurve deines Videos (Anfang ruhig, Mitte spannend, Ende optimistisch), generiere passende Musikstücke und Soundeffekte für jede Phase, und füge alles in einem Audio-Editor oder direkt im Schnittprogramm zusammen. Die Trennung von Bild- und Tonproduktion mag zunächst umständlich wirken, führt aber zu deutlich besseren Ergebnissen als der Versuch, alles in einem Schritt zu erledigen.

Lektion 7: Ethik, Recht und Kennzeichnung bei KI-Videos

KI-generierte Videos bewegen sich in einem Spannungsfeld zwischen kreativer Freiheit und gesellschaftlicher Verantwortung. Die Fähigkeit, realistisch aussehende Videos von Menschen und Szenen zu erzeugen, die nie stattgefunden haben, wirft fundamentale Fragen auf, die jeder professionelle Anwender beantworten muss.

Der EU AI Act schafft ab August 2026 einen verbindlichen Rechtsrahmen. KI-generierte oder KI-manipulierte Videoinhalte müssen als solche gekennzeichnet werden, insbesondere wenn sie Personen zeigen oder nachahmen. Die Kennzeichnungspflicht gilt für alle kommerziellen und öffentlichen Verwendungen. Technisch wird dies durch C2PA-Metadaten umgesetzt, die in die Videodatei eingebettet werden und von Plattformen wie YouTube, Meta und TikTok automatisch ausgelesen werden können. Runway und Sora betten diese Metadaten bereits automatisch ein.

Deepfakes sind das offensichtlichste ethische Problem. Die Technologie, das Gesicht einer Person in ein Video einzusetzen oder einer Person Worte in den Mund zu legen, die sie nie gesagt hat, ist 2026 trivial einfach zugänglich. Die rechtlichen Konsequenzen sind allerdings erheblich: Deepfakes ohne Einwilligung der dargestellten Person sind in der EU strafbar und können zu empfindlichen Geldstrafen führen. Für Unternehmen gilt: Niemals ohne ausdrückliche schriftliche Einwilligung das Abbild oder die Stimme einer realen Person per KI erzeugen oder manipulieren.

Darüber hinaus stellen sich Fragen der Transparenz gegenüber Kunden und Zuschauern. Sollte ein Unternehmen offenlegen, dass sein Produktvideo KI-generiert ist? Die rechtliche Antwort ist: ja, in den meisten Fällen. Die strategische Antwort ist ebenfalls ja, denn Transparenz stärkt das Vertrauen. Formulierungen wie "Visualisierung mit KI-Unterstützung erstellt" oder ein dezenter Hinweis in der Videobeschreibung sind inzwischen branchenüblich und werden von Zuschauern positiv wahrgenommen.

Für Unternehmen empfiehlt sich die Entwicklung einer internen KI-Video-Richtlinie, die folgende Punkte adressiert: Welche Arten von KI-Videos dürfen ohne Freigabe erstellt werden? Wer prüft KI-generierte Videos vor der Veröffentlichung? Wie werden KI-Videos gekennzeichnet? Welche Daten dürfen in KI-Video-Tools hochgeladen werden? Gibt es ein Eskalationsverfahren für ethisch fragwürdige Inhalte? Eine solche Richtlinie schützt nicht nur vor rechtlichen Risiken, sondern gibt dem Team auch Handlungssicherheit im täglichen Umgang mit der Technologie.

Lektion 8: Dein KI-Video-Produktionsplan -- Von der Idee zum fertigen Film

Am Ende dieses Kurses hast du einen umfassenden Überblick über die Möglichkeiten der KI-Videoproduktion. Jetzt geht es darum, dieses Wissen in einen konkreten Plan umzusetzen, der zu deinen Ressourcen und Zielen passt.

Der Einstieg gelingt am besten mit einem klar definierten Pilotprojekt. Wähle ein Video, das dein Unternehmen ohnehin produzieren müsste: ein Produkterklärvideo, ein Social-Media-Clip, eine interne Schulung. Erstelle dieses Video mit KI-Unterstützung und vergleiche den Aufwand und das Ergebnis mit einer traditionellen Produktion. Dieser direkte Vergleich liefert dir die besten Argumente für oder gegen den weiteren Einsatz von KI-Video in deinem Kontext.

Für den Aufbau eines nachhaltigen KI-Video-Workflows empfiehlt sich ein Toolstack aus drei Ebenen. Die Generierungsebene bilden ein oder zwei Tools für die Erstellung neuer Videoinhalte, etwa Runway für hochwertige Clips und Kling für schnelle Varianten. Die Bearbeitungsebene deckt Descript oder CapCut für Schnitt und Untertitel ab. Die Vertonungsebene nutzt ElevenLabs für Voiceover und Suno für Hintergrundmusik. Dieser Stack deckt die meisten Anforderungen ab und kostet in der Summe zwischen 50 und 150 Euro pro Monat -- ein Bruchteil dessen, was eine einzelne professionelle Videoproduktion kosten würde.

Setze dir realistische Ziele für die ersten drei Monate. Im ersten Monat erstellst du zwei bis drei kurze Videos (15 bis 60 Sekunden) für Social Media, um die Tools kennenzulernen und deinen Workflow zu finden. Im zweiten Monat produzierst du ein längeres Erklärvideo oder Produktvideo (zwei bis fünf Minuten) und sammelst Feedback von Kollegen und Kunden. Im dritten Monat etablierst du einen regelmässigen Produktionsrhythmus und dokumentierst deinen Workflow, sodass auch andere Teammitglieder Videos erstellen können.

Die KI-Videoproduktion steckt trotz aller Fortschritte noch in den Kinderschuhen. Die Tools werden besser, die Qualität steigt, und die Kosten sinken kontinuierlich. Wer sich jetzt mit der Technologie vertraut macht, baut einen Wissensvorsprung auf, der in den kommenden Jahren immer wertvoller wird. Die beste Zeit, mit KI-Video anzufangen, ist jetzt.