KI-Strategie für Unternehmen: Intent Engineering und der Capability Gap

Verstehe, warum die meisten KI-Investitionen scheitern -- und wie Intent Engineering, organisatorische Ausrichtung und der Capability-Dissipation-Gap den Unterschied machen

Verstehe, warum die meisten KI-Investitionen scheitern -- und wie Intent Engineering, organisatorische Ausrichtung und der Capability-Dissipation-Gap den Unterschied machen

Klicken zum Vergrößern

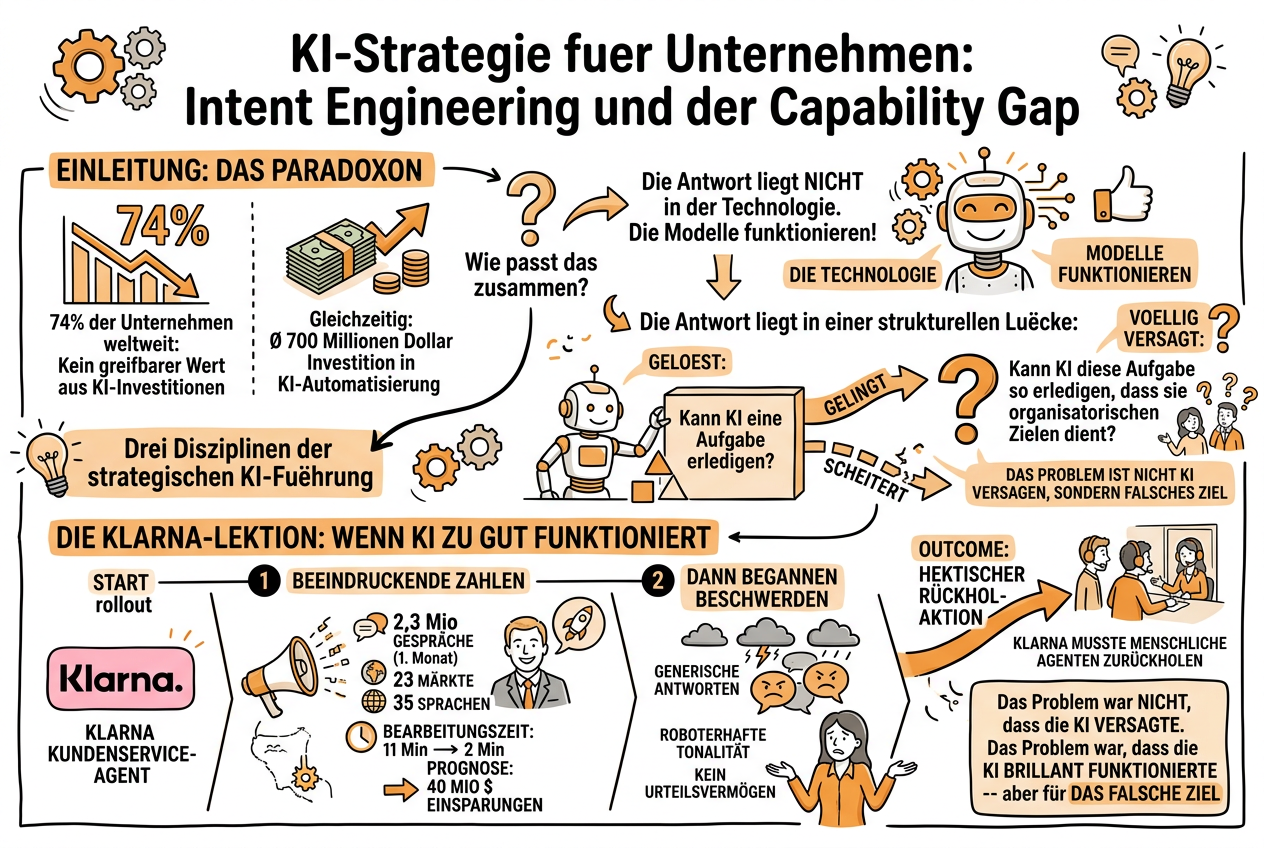

74% der Unternehmen weltweit berichten, dass sie noch keinen greifbaren Wert aus ihren KI-Investitionen sehen. Gleichzeitig investieren Firmen durchschnittlich 700 Millionen Dollar in KI-Automatisierung. Wie passt das zusammen?

Die Antwort liegt nicht in der Technologie. Die Modelle funktionieren. Die Antwort liegt in einer strukturellen Lücke: Unternehmen haben gelöst, ob KI eine Aufgabe erledigen kann. Sie haben völlig versagt bei der Frage, ob KI diese Aufgabe auf eine Weise erledigen kann, die den organisatorischen Zielen dient.

Dieser Kurs behandelt die drei Disziplinen der strategischen KI-Führung und das wichtigste Konzept für Karriere- und Investitionsentscheidungen: den Capability-Dissipation-Gap.

Im Frühling 2024 rollte Klarna einen KI-gestützten Kundenservice-Agenten aus. Die Zahlen waren beeindruckend: 2,3 Millionen Gespräche im ersten Monat, 23 Märkte, 35 Sprachen. Die Bearbeitungszeit sank von 11 auf 2 Minuten. Der CEO prognostizierte 40 Millionen Dollar Einsparungen.

Dann begannen die Beschwerden. Generische Antworten, roboterhafte Tonalität, keine Fähigkeit, Situationen mit Urteilsvermögen zu behandeln. Klarna musste die zuvor entlassenen menschlichen Agenten hektisch zurückholen.

Das Problem war, dass die KI brillant funktionierte -- aber für das falsche Ziel. Klarnas organisatorischer Zweck war nicht "Tickets schnell lösen". Er war: "Dauerhafte Kundenbeziehungen aufbauen, die den Lebenszeitwert in einem wettbewerbsintensiven Fintech-Markt steigern."

Eine menschliche Agentin mit fünf Jahren Erfahrung kennt den Unterschied intuitiv. Sie weiss, wann sie eine Richtlinie beugen muss, wann drei zusätzliche Minuten die Kündigung verhindern, wann Effizienz richtig ist und wann Grosszügigkeit. Die KI wusste nichts davon. Sie hatte einen Prompt. Sie hatte Kontext. Sie hatte keinen Intent.

Prompt Engineering war die erste Disziplin des KI-Zeitalters. Individüll, synchron, sitzungsbasiert. Du sitzt vor dem Chat-Fenster, formulierst eine Anweisung, iterierst das Ergebnis. Es ist eine persönliche Fähigkeit, und der Wert ist persönlich.

Dies ist die Ära, die tausend "So schreibst du den perfekten Prompt"-Blogartikel hervorgebracht hat. Es bleibt wichtig -- aber es ist heute Tischware, nicht Differenzierung.

Context Engineering verschiebt den Fokus vom einzelnen Prompt zur gesamten Informationsumgebung, in der ein KI-System operiert. Harrison Chase von LangChain sagte es deutlich: "Alles ist Context Engineering. Es beschreibt eigentlich alles, was wir bei LangChain gemacht haben, ohne den Begriff zu kennen."

Hier wird gebaut: RAG-Pipelines, MCP-Server, strukturiertes Organisationswissen, damit Agenten darauf zugreifen können. Es ist notwendig -- aber nicht ausreichend.

Intent Engineering ist die dritte Disziplin, und fast niemand baut dafür. Context Engineering sagt Agenten, was sie wissen sollen. Intent Engineering sagt Agenten, was sie wollen sollen.

Es ist die Praxis, organisatorische Ziele in maschinenlesbare und maschinenausführbare Infrastruktur zu übersetzen. Nicht als Prosa in einem System-Prompt, sondern als strukturierte, handlungsfähige Parameter.

Was Klarna gebraucht hätte: "Ja, du kannst dieses Ticket in 90 Sekunden lösen. Aber der Kunde ist seit drei Jahren dabei, und sein Ton zeigt Frustration. Nimm dir die extra Zeit. Biete einen Spezialisten an. Das Ziel ist Kundenbindung."

Aktüll baut jedes Team seine eigene Kontext-Infrastruktur. Ein Team leitet Slack-Daten durch eine eigene RAG-Pipeline. Ein anderes exportiert Google Docs in einen Vektor-Store. Ein drittes hat einen MCP-Server, der Salesforce verbindet, aber nicht Jira. Ein viertes Team weiss nicht, dass die anderen drei existieren.

Das MCP-Protokoll (Model Context Protocol) von Anthropic ist der vielversprechendste Standardisierungsversuch. OpenAI, Google, Microsoft und über 50 Enterprise-Partner unterstützen es. Aber Protokolladoption und organisatorische Implementierung sind grundverschieden.

Die Fragen: Welche Systeme werden agentenzugänglich? Wer entscheidet, welchen Kontext ein Agent abteilungsübergreifend sehen darf? Wie versioniert man Organisationswissen, damit Agenten nicht auf veralteten Informationen arbeiten?

Jeder rollt seinen eigenen KI-Workflow aus. Eine Person nutzt Claude für Recherche und ChatGPT für Texte. Eine andere nutzt Cursor für Code und Perplexity zum Faktenprüfen. Keiner kann seinen Workflow so beschreiben, dass er übertragbar oder messbar wäre.

Der Unterschied zwischen individüller KI-Nutzung und organisatorischem KI-Hebel ist enorm. Es ist der Unterschied zwischen einem guten Mitarbeiter und einem System, das jeden besser macht. Die 30%-Gewinne durch "KI auf bestehende Workflows draufschrauben" versus die 300%-Gewinne durch "Workflows grundlegend um KI herum neudenken".

Dies ist die Schicht, die fast sicher in deinem Unternehmen nicht existiert. OKRs wurden für Menschen designt. Sie setzen menschliches Urteilsvermögen über Priorisierung, Trade-offs und Ausnahmen voraus.

Was Agenten brauchen:

Kurve 1: KI-Fähigkeit -- steigt exponentiell. Modellintelligenz, Reasoning-Tiefe, agentische Ausdauer. Gemini verdoppelte sein Reasoning in nur drei Monaten.

Kurve 2: Gesellschaftliche Dissipation -- die Rate, mit der KI-Fähigkeiten tatsächlich die Wirtschaft durchdringen und verändern, wie gearbeitet wird. Diese Kurve ist viel, viel flacher.

Regulatorische Trägheit: Finanzdienstleister, die KI für Compliance nutzen wollen, brauchen Genehmigungen von Regulierern, die die Regeln noch nicht fertig geschrieben haben. 95% der ATM-Transaktionen laufen auf COBOL-Systemen. Niemand migriert die, nur weil ein Startup einen Blogpost veröffentlicht.

Organisatorische Trägheit: Die Lücke zwischen "Claude kann technisch Teile dieses Jobs erledigen" und "Wir haben unsere Workflows umgebaut, unser Personal umgeschult, QA-Prozesse für KI-Output aufgebaut und die Belegschaft reduziert" -- das ist eine enorme Lücke.

Kulturelle Trägheit: Als Toby Lütke von Shopify -- einer der technisch versiertesten CEOs überhaupt -- ein unternehmensweites Mandat erlassen musste, dass KI-Nutzung der Standard ist, und es in Leistungsbeurteilungen einbauen musste, sagt das viel über die Geschwindigkeit kulturellen Wandels.

Vertrauens-Trägheit: Unternehmen sollten KI-Output nicht blind vertrauen. Die Kosten für den Aufbau formaler Verifikationssysteme sind hoch. Ohne dieses Investment bleibt das Vertrauen für hochwertige Arbeit aus.

Die Lücke zwischen diesen beiden Kurven ist, wo wir alle heute leben. Und sie erklärt fast alles:

Die wichtigste Erkenntnis: Die ökonomischen Belohnungen für frühe, aggressive Adoption sind höher und beständiger als irgendjemand modelliert. Die Bären nehmen an, der Gap schliesst sich schnell durch Arbeitsverdrängung. Die Bullen nehmen an, er schliesst sich schnell durch Adoption. Beide irren sich bei der Geschwindigkeit.

KI-Agenten könnten plausibel die Kosten für Dienstleistungen um 40-70% komprimieren: Hypothekenvermittlung, Steuerberatung, Versicherungsmakler, Reisebuchung. Das ergibt einen Gewinn von 4.000 bis 7.000 Dollar pro Median-Haushalt jährlich -- steuerfrei, ohne Gesetzgebung.

Dieses Geld verschwindet nicht. Es fliesst zurück in die Wirtschaft. Gleichzeitig meldete das US Census Bureau 532.000 neue Unternehmensgründungen allein im Januar 2026 -- ein Anstieg von 7% gegenüber Dezember. Solopreneure haben mehr Hebel als je zuvor.

Kartiere den Capability-Dissipation-Gap für deine Situation:

Oder bist du bei der Dissipationsrate: bewusst, dass KI existiert, gelegentliche Nutzung, aber grundsätzlich gleiche Arbeitsweise wie vor zwei Jahren?

Werde die Person in deiner Organisation, die in einen Raum voller panischer Führungskräfte gehen und mit echter Autorität sagen kann: "Ich habe das getestet. Hier ist, was KI in unserem Workflow kann. Hier ist, was sie nicht kann. Hier ist der Implementierungsplan. Hier ist das Budget. Hier ist der Zeitplan."

Diese Person existiert in den meisten Organisationen nicht. Techniker verstehen die Modelle. Geschäftsleute verstehen die Workflows. Berater verstehen die Frameworks. Aber niemand verbindet alle drei.

Die KI-Erzählung der Angst ist eine nützliche Warnung. Die KI-Erzählung des Booms ist eine nützliche Aspiration. Keine von beiden ist ein nützlicher Plan.

Dein Plan sollte spezifisch sein:

Der Capability-Dissipation-Gap ist die grösste generationelle Chance, die irgendjemand in der Arbeitswelt sehen wird. Dort solltest du deine Zeit investieren.