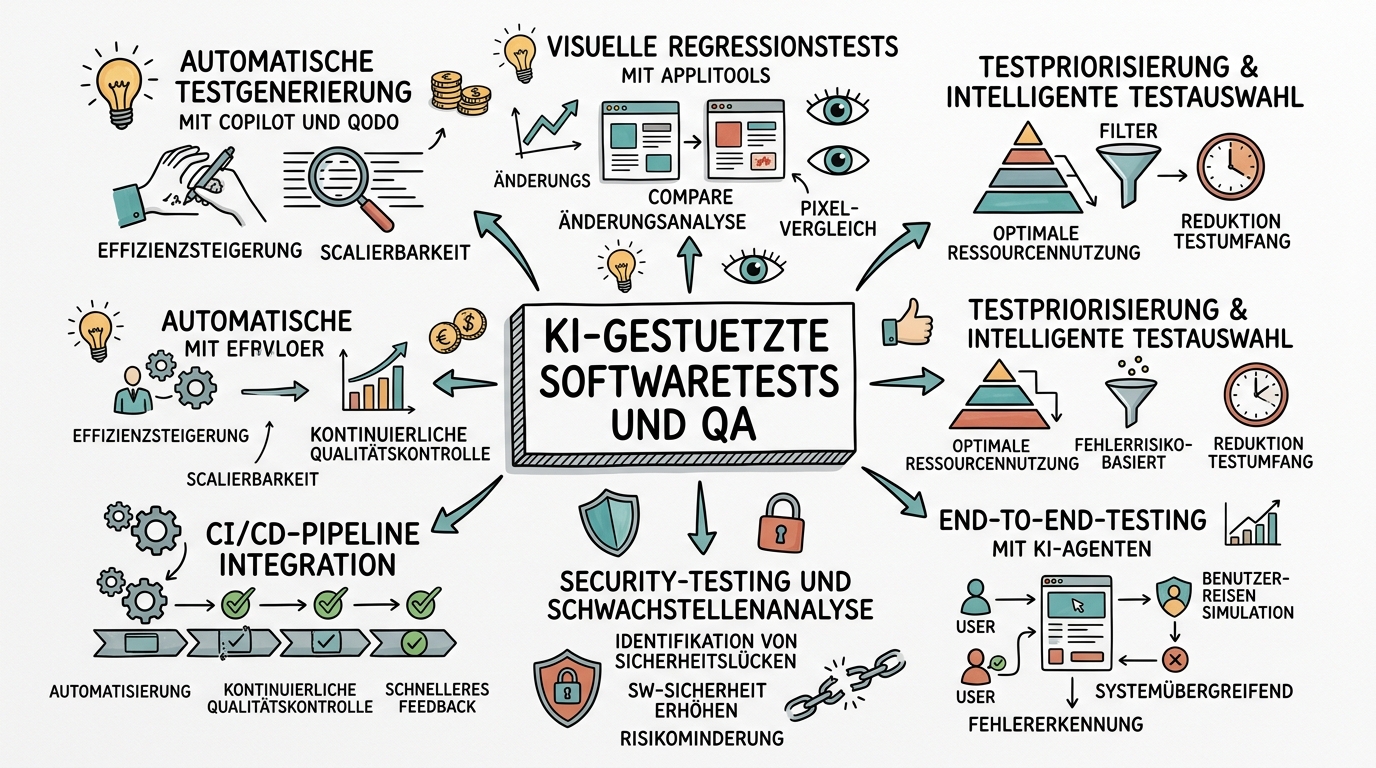

KI-gestützte Softwaretests und QA: Qualität mit künstlicher Intelligenz sichern

Automatisierte Testgenerierung, intelligente Fehlererkennung und KI-gestützte Qualitätssicherung für Entwicklungsteams.

Automatisierte Testgenerierung, intelligente Fehlererkennung und KI-gestützte Qualitätssicherung für Entwicklungsteams.

Klicken zum Vergrößern

Softwaretests gelten in vielen Entwicklungsteams als notwendiges Übel. Sie kosten Zeit, sind repetitiv und werden unter Zeitdruck gerne gekürzt, oft mit teuren Konsequenzen. Studien zeigen, dass Softwarefehler, die erst in der Produktion entdeckt werden, bis zu hundertmal teurer zu beheben sind als solche, die in der Entwicklungsphase gefunden werden. Gleichzeitig wächst die Komplexität moderner Software rasant: Microservices, APIs, Cloud-native Architekturen und kontinuierliche Deployments machen manülles Testen zunehmend unpraktikabel.

Künstliche Intelligenz verändert dieses Bild grundlegend. Statt dass Entwicklerinnen und Entwickler Testfälle mühsam per Hand schreiben, können KI-Modelle Code analysieren und automatisch sinnvolle Tests generieren. Statt dass QA-Teams stundenlang Testprotokolle durchforsten, erkennen KI-Systeme Muster in Fehlerberichten und priorisieren die kritischsten Probleme. Und statt dass Regressionstests Stunden oder Tage laufen, optimiert KI die Testauswahl so, dass nur die Tests ausgeführt werden, die für die jeweilige Änderung relevant sind.

Der Markt für KI-gestützte Testtools hat 2026 ein Volumen von über 2 Milliarden Dollar erreicht. Grosse Anbieter wie Microsoft mit GitHub Copilot, Google mit Gemini Code Assist und spezialisierte Startups wie Codium AI, Diffblü und Mabl kämpfen um Marktanteile. Für Entwicklungsteams bedeutet das: Die Werkzeuge sind da, die Frage ist nur noch, wie man sie effektiv einsetzt.

Die naheliegendste Anwendung von KI im Testing ist die automatische Erstellung von Unit-Tests und Integrationstests. Werkzeuge wie GitHub Copilot, Codium AI (jetzt Qodo) und Amazon CodeWhisperer können aus bestehendem Code Testfälle ableiten, die Randfälle abdecken, an die Entwickler oft nicht denken.

Nehmen wir ein konkretes Beispiel: Ein Entwickler hat eine Funktion geschrieben, die Benutzereingaben für ein Formular validiert. Die Funktion prüft E-Mail-Adressen, Telefonnummern und Postleitzahlen. Manüll würde der Entwickler vielleicht fünf bis zehn Testfälle schreiben: gültige Eingaben, leere Felder, offensichtlich falsche Formate. Ein KI-Assistent analysiert dagegen die Funktionslogik und generiert 30 bis 40 Testfälle, darunter Unicode-Zeichen in E-Mail-Adressen, extrem lange Eingaben, SQL-Injection-Versuche und länderspezifische Sonderformate. Genau diese Randfälle sind es, die in der Produktion zu Problemen führen.

Qodo (ehemals Codium AI) hat sich auf diesen Bereich spezialisiert. Das Tool integriert sich direkt in die IDE und bietet nach der Analyse einer Funktion einen "Test Generation"-Button an. Es versteht nicht nur die Syntax, sondern auch die Semantik des Codes: Welche Geschäftslogik steckt dahinter? Welche Vorbedingungen müssen erfüllt sein? Welche Zustände können zu Fehlern führen? Die generierten Tests sind nicht perfekt, aber sie liefern eine solide Grundlage, die Entwickler dann verfeinern können.

Wichtig ist dabei die richtige Erwartungshaltung. KI-generierte Tests ersetzen kein durchdachtes Testkonzept. Sie sind ein Beschleuniger, kein Ersatz für Testexpertise. Die besten Ergebnisse erzielen Teams, die KI-generierte Tests als Ausgangspunkt nehmen und sie dann mit ihrem Domänenwissen ergänzen und priorisieren.

Eines der frustrierendsten Probleme in der Frontend-Entwicklung sind visülle Regressionen: Ein CSS-Update verschiebt einen Button um zwei Pixel, ein Schrift-Fallback ändert das Layout auf bestimmten Geräten, oder ein neues Bild sprengt das responsive Design. Solche Fehler fallen in klassischen Unit-Tests nicht auf, weil der Code technisch korrekt funktioniert. Erst das menschliche Auge bemerkt, dass etwas "nicht stimmt".

KI-gestützte visülle Testtools wie Applitools Eyes, Percy (von BrowserStack) und Chromatic lösen dieses Problem elegant. Sie erstellen Screenshots jeder Seite und jeder Komponente, vergleichen sie mit einer Referenzversion und markieren Abweichungen. Der entscheidende Unterschied zu pixelbasiertem Vergleich: Die KI versteht, welche Änderungen beabsichtigt sind und welche nicht. Ein neuer Menüpunkt ist eine gewollte Änderung, ein verschobener Footer nicht.

In der Praxis hat ein mittelgrosses E-Commerce-Team mit Applitools Eyes seine visüllen Regressionstests von acht Stunden manüller Prüfung pro Release auf 20 Minuten automatisierte Analyse reduziert. Die KI prüft dabei nicht nur Desktop-Ansichten, sondern simuliert automatisch verschiedene Bildschirmgrössen, Browser und Betriebssysteme. Das Team hat seitdem die Release-Frequenz von zweimal monatlich auf wöchentlich erhöhen können, weil das Vertrauen in die visülle Qualität drastisch gestiegen ist.

Besonders spannend ist der Einsatz von Multimodal-KI im UI-Testing. GPT-4o und Gemini 1.5 können Screenshots "anschauen" und Fehler beschreiben, die kein automatisierter Test finden würde: "Der Kontrast zwischen Text und Hintergrund ist zu gering für Barrierefreiheit" oder "Das Formular hat keinen sichtbaren Fokus-Indikator". Diese Art von qualitativem Feedback war bisher nur von menschlichen Testern zu bekommen.

Nicht jeder Test ist gleich wichtig, und nicht jede Code-Änderung erfordert die vollständige Testsuite. Eines der grossen Versprechen von KI im Testing ist die intelligente Testauswahl: Basierend auf der Art der Änderung, der Fehlerhistorie und den Abhängigkeiten im Code entscheidet die KI, welche Tests ausgeführt werden müssen und welche übersprungen werden können.

Launchable, ein Tool das von ehemaligen Jenkins-Entwicklern gegründet wurde, analysiert die Git-Historie eines Projekts und lernt, welche Code-Änderungen historisch welche Tests zum Scheitern gebracht haben. Wenn ein Entwickler nun eine Änderung in der Zahlungslogik committet, weiss das System, dass vor allem die Integration-Tests für den Checkout-Prozess und die API-Tests für den Payment-Provider relevant sind, während die Tests für das Benutzerprofil wahrscheinlich nicht betroffen sind.

Das klingt trivial, hat aber enorme Auswirkungen auf die Entwicklungsgeschwindigkeit. Ein Unternehmen mit einer Testsuite, die zwei Stunden läuft, konnte durch KI-gestützte Testauswahl die durchschnittliche Feedback-Zeit auf 15 Minuten reduzieren, bei gleichbleibender Fehlererkennungsrate. Das bedeutet, dass Entwickler nicht mehr eine Stunde auf Testergebnisse warten und in der Zwischenzeit den Kontext verlieren, sondern fast sofort wissen, ob ihre Änderung funktioniert.

Ein weiterer Einsatzbereich ist die Priorisierung von Fehlermeldungen. In grossen Projekten kommen täglich Dutzende oder Hunderte Bugreports herein. KI-Systeme wie die in Jira oder Linear integrierten Modelle können automatisch Duplikate erkennen, die Schwere eines Fehlers einschätzen und sogar vorschlagen, welcher Entwickler am besten geeignet ist, den Fehler zu beheben, basierend auf der Codeownership und der bisherigen Bearbeitungshistorie.

End-to-End-Tests sind die Königsdisziplin des Softwaretestings. Sie simulieren echte Benutzerinteraktionen über den gesamten Anwendungsstapel hinweg: Login, Navigation, Dateneingabe, Checkout. Klassische E2E-Frameworks wie Selenium, Cypress oder Playwright erfordern fragile Selektoren und brechen bei jedem UI-Redesign. KI-Agenten versprechen hier einen Paradigmenwechsel.

Tools wie Momentic, TestRigor und Agent.ai verfolgen einen völlig anderen Ansatz. Statt "Klicke auf den Button mit der ID submit-order" formuliert der Tester in natürlicher Sprache: "Lege ein Produkt in den Warenkorb, gehe zur Kasse und schliesse die Bestellung mit Kreditkarte ab." Die KI interpretiert diese Anweisung, findet selbständig die richtigen Elemente auf der Seite und führt die Schritte aus. Ändert sich das UI, passt sich der Agent automatisch an, solange der logische Ablauf gleich bleibt.

In einem Praxistest hat ein SaaS-Unternehmen seine 200 Selenium-Tests durch 50 KI-basierte Tests in TestRigor ersetzt. Die Wartungszeit für die Tests sank von 20 Stunden pro Sprint auf unter 3 Stunden, weil die KI-Tests robust gegenüber UI-Änderungen waren. Gleichzeitig stieg die Testabdeckung, weil die natürlichsprachlichen Tests auch von Product Ownern und QA-Analysten ohne Programmierkenntnisse geschrieben werden konnten.

Der Nachteil dieser Werkzeuge ist die geringere Präzision bei komplexen, zustandsabhängigen Szenarien. Wenn ein Test exakt prüfen muss, ob ein bestimmter Datenbankwert nach einer Transaktion korrekt ist, sind klassische Frameworks nach wie vor überlegen. Die Kunst liegt in der Kombination: KI-Agenten für die breite Abdeckung typischer User-Journeys, klassische Tests für die präzise Verifikation kritischer Geschäftslogik.

Sicherheitslücken in Software werden immer teurer. Der durchschnittliche Schaden eines Datenlecks lag 2025 bei über 4,5 Millionen Dollar. Gleichzeitig werden Angriffe raffinierter und automatisierter. KI kann hier auf beiden Seiten spielen: Angreifer nutzen sie, um Schwachstellen schneller zu finden, und Verteidiger nutzen sie, um ihre Software proaktiv abzusichern.

GitHub Advanced Security mit Copilot Autofix ist eines der beeindruckendsten Werkzeuge in diesem Bereich. Das System scannt Pull Requests automatisch auf Sicherheitsprobleme wie SQL-Injection, Cross-Site-Scripting oder unsichere Kryptografie und schlägt gleich einen Fix vor. In einer internen Studie von GitHub konnte Copilot Autofix über 90 Prozent der gefundenen Schwachstellen korrekt beheben, mit einer durchschnittlichen Bearbeitungszeit von unter einer Minute statt mehrerer Stunden manüller Arbeit.

Snyk, ein weiterer wichtiger Akteur, kombiniert KI-gestützte Analyse mit einer umfangreichen Schwachstellendatenbank. Das Tool prüft nicht nur den eigenen Code, sondern auch alle Abhängigkeiten und Container-Images. Wenn eine Bibliothek eine bekannte Sicherheitslücke hat, schlägt Snyk automatisch ein Update oder einen Workaround vor. Für Unternehmen, die Hunderte von Dependencies verwalten, ist das ein enormer Zeitgewinn.

Besonders vielversprechend ist der Einsatz von KI für "Adversarial Testing", also das gezielte Suchen nach Schwachstellen durch simulierte Angriffe. Tools wie BurpSuite mit KI-Erweiterung oder Pentera nutzen maschinelles Lernen, um automatisiert Angriffsszenarien durchzuspielen, die ein menschlicher Pentester Tage brauchen würde. Das ersetzt keine professionellen Sicherheitsaudits, aber es schliesst die Lücke zwischen quartalsweisen Prüfungen und der täglichen Realität neuer Code-Änderungen.

Die besten Testtools nützen wenig, wenn sie nicht nahtlos in den Entwicklungsworkflow eingebettet sind. Moderne Continuous-Integration- und Continuous-Deployment-Pipelines sind der natürliche Ort für KI-gestützte Tests, denn hier wird ohnehin bei jedem Commit automatisch gebaut und geprüft.

Die Integration folgt typischerweise einem Stufenmodell. In der ersten Stufe laufen bei jedem Commit die schnellen KI-Checks: statische Code-Analyse mit Copilot, Security-Scans mit Snyk und Linting. Diese Checks dauern Sekunden bis wenige Minuten und geben sofortiges Feedback. In der zweiten Stufe, die bei Pull Requests oder täglichen Builds läuft, kommen die KI-generierten Unit-Tests und die KI-priorisierten Integrationstests. In der dritten Stufe, vor jedem Release, laufen die vollständigen E2E-Tests mit KI-Agenten und die visüllen Regressionstests.

Ein mittelgrosses Entwicklungsteam bei einem deutschen Finanzdienstleister hat dieses Stufenmodell über sechs Monate eingeführt. Das Ergebnis war bemerkenswert: Die Anzahl der Bugs, die es in die Produktion schafften, sank um 67 Prozent. Die durchschnittliche Zeit von Commit bis Deployment verkürzte sich von vier Tagen auf acht Stunden. Und die Entwicklerzufriedenheit stieg messbar, weil niemand mehr Wochenenden mit Hotfixes verbringen musste.

Entscheidend für den Erfolg ist die schrittweise Einführung. Beginnen Sie mit einem einzigen KI-Tool, zum Beispiel Copilot für Testgenerierung, und integrieren Sie es in einen bestehenden Pipeline-Schritt. Messen Sie die Auswirkungen über vier Wochen. Erweitern Sie dann schrittweise. Teams, die versuchen, alle KI-Testtools gleichzeitig einzuführen, erzeugen Chaos statt Qualität.

Nach sieben Lektionen voller Tools und Techniken stellt sich die zentrale Frage: Wo fangen Sie an? Die Antwort hängt von Ihrem aktüllen Reifegrad ab. Teams, die heute kaum automatisierte Tests haben, profitieren am meisten von KI-generierter Testabdeckung. Teams mit einer umfangreichen Testsuite profitieren stärker von intelligenter Testpriorisierung und Wartungsreduktion.

Für den Einstieg empfiehlt sich ein dreistufiger Ansatz. Im ersten Monat führen Sie ein KI-Coding-Tool wie GitHub Copilot oder Qodo ein und nutzen es gezielt für die Testgenerierung. Setzen Sie sich ein messbares Ziel, zum Beispiel die Code-Coverage um 15 Prozentpunkte zu steigern. Im zweiten Monat integrieren Sie ein Security-Testing-Tool in Ihre Pipeline und etablieren den Prozess, dass kein Pull Request ohne bestandenen Security-Check gemerged wird. Im dritten Monat evaluieren Sie ein visülles Regressionstool oder ein E2E-Testing-Tool mit KI-Agenten für Ihre kritischsten User-Journeys.

Vergessen Sie dabei nicht die menschliche Seite. KI-Testing verändert die Rolle von QA-Spezialisten grundlegend. Statt manüller Testausführung und Testfallerstellung werden Teststrategien, Testdatenmanagement und die Bewertung von KI-Ergebnissen zu den Kernkompetenzen. Investieren Sie in die Weiterbildung Ihres Teams, denn die besten Tools nützen nichts ohne Menschen, die wissen, wie man sie einsetzt und ihre Ergebnisse interpretiert.