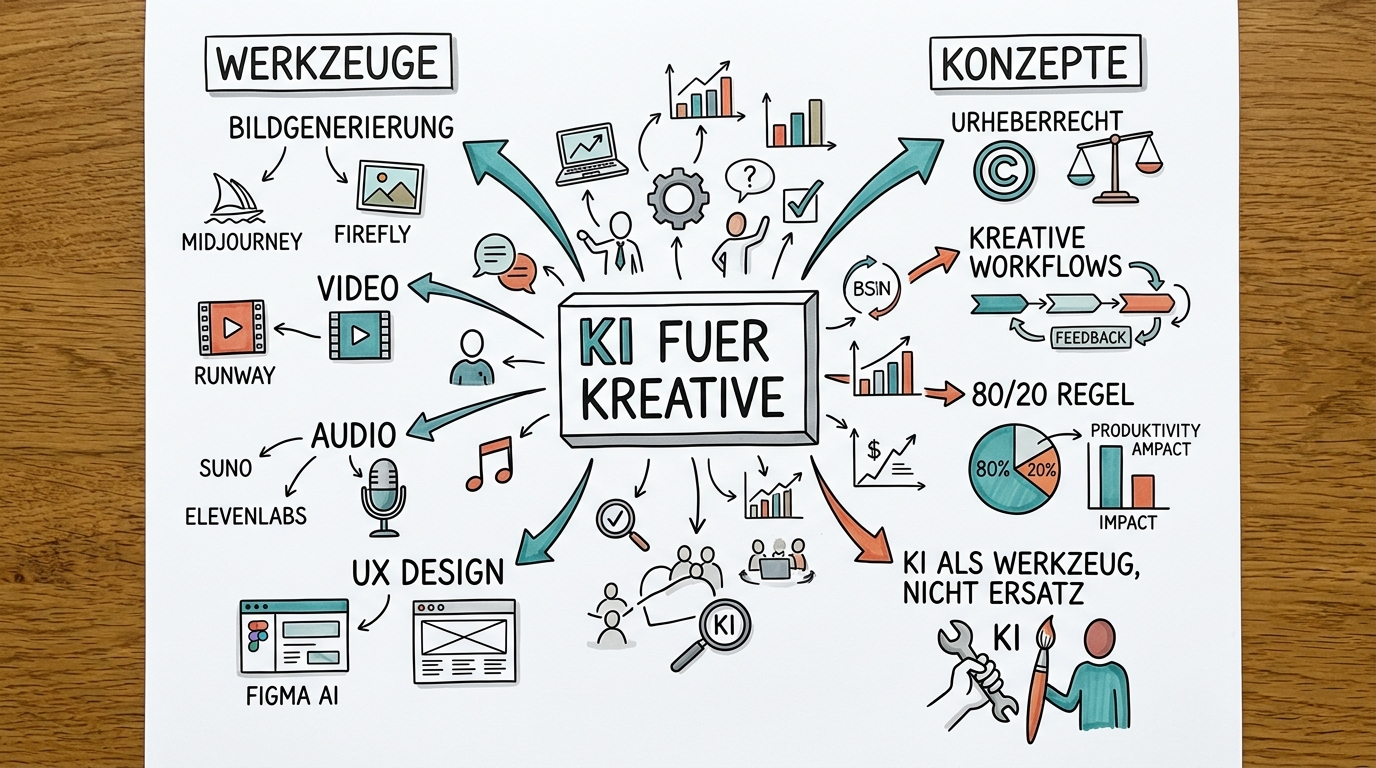

KI für Kreative: Wie künstliche Intelligenz Design, Video und Musik verändert

Lektion 1: Die kreative Revolution -- Wo stehen wir 2026?

Die kreative Branche erlebt gerade den grössten Umbruch seit der Einführung des Desktop Publishing in den 1980er Jahren. Doch während damals die Werkzeuge digitalisiert wurden, verändert sich 2026 etwas Grundlegenderes: Die Rolle des Kreativen selbst wandelt sich vom ausführenden Handwerker zum kuratorischen Regisseur. Wer mit KI-Tools umgehen kann, produziert in einer Stunde, wofür früher ein ganzer Tag nötig war. Wer sie ignoriert, riskiert den Anschluss zu verlieren.

Die Zahlen sprechen eine deutliche Sprache. Laut dem Adobe Creators' Toolkit Report nutzen 2026 bereits 95 Prozent der deutschen Kreativen regelmässig KI-Tools in ihrem Workflow -- in Agenturen sind es sogar 98 Prozent (BVDW-Studie). Die Produktivitätssteigerung liegt je nach Disziplin bei Faktor 4 (PwC AI Jobs Barometer), und 63 Prozent der Kreativen berichten von deutlich verkürzten Produktionszeiten. Gleichzeitig zeigt der Arbeitsmarkt eine harte Kehrseite: Stellenanzeigen im Copywriting sind um 53 Prozent zurückgegangen, im Projektmanagement um 48 Prozent (Stepstone/Table.Media 2026). Die Angst vor dem Ersatz durch KI ist einer pragmatischen Nutzung gewichen -- wer KI beherrscht, gewinnt. Wer sie ignoriert, verliert Aufträge.

Das KI-Tool-Ökosystem für Kreative hat 2026 eine beeindruckende Reife erreicht. Midjourney ist in Version 7 angekommen und liefert dank der neuen Omni-Reference-Funktion erstmals konsistente Charaktere und Stile über mehrere Generierungen hinweg -- ein Gamechanger für Branding und Kampagnen. Adobe hat mit Firefly 4 die KI zur allumfassenden Multimedia-Suite ausgebaut: Bildgenerierung, Text-to-Video direkt in Premiere Pro, KI-Avatare und Audio-Übersetzung in Dutzende Sprachen. Runway hat mit Gen-4 und dem neuen Aleph-Editor einen Standard für KI-Videoproduktion gesetzt, bei dem sich Videos per Textanweisung nachbearbeiten lassen. Suno generiert in Version 5 Musik mit isolierbaren Stems, die sich direkt in professionelle DAWs importieren lassen. ElevenLabs hat mit Audio Tags in Version 3 einen Paradigmenwechsel eingeleitet: Stimme, Emotion und Sprechstil lassen sich per Tag-System millimetergenau steuern.

Dieser Kurs richtet sich an Kreativprofis, die KI nicht als Bedrohung, sondern als das mächtigste Werkzeug begreifen wollen, das ihnen je zur Verfügung stand. Wir schauen uns die wichtigsten Tools an, lernen fortgeschrittene Prompt-Techniken für visülle Medien und entwickeln Workflows, die KI sinnvoll in den kreativen Prozess integrieren -- ohne die menschliche Kreativität zu ersetzen.

Lektion 2: Bildgenerierung für Profis -- Jenseits von "Erstelle mir ein Bild"

Die meisten Nutzer kratzen bei der KI-Bildgenerierung nur an der Oberfläche. Sie tippen einen kurzen Prompt ein, erhalten ein ansprechendes Ergebnis und sind zufrieden. Für professionelle kreative Arbeit reicht das nicht. Hier geht es um Markenkonsistenz, technische Präzision und reproduzierbare Qualität. Die gute Nachricht: Mit den richtigen Techniken lassen sich all diese Anforderungen erfüllen.

Die Wahl des richtigen Tools hängt vom Einsatzzweck ab. Midjourney v7 ist der Goldstandard für ästhetisch anspruchsvolle Bilder: Marketing-Visuals, Hero-Shots für Websites, konzeptionelle Illustrationen. Die Stärke liegt in der ästhetischen Kohärenz und der natürlichen Lichtführung, die andere Tools so nicht erreichen. Adobe Firefly 4 ist dagegen die beste Wahl, wenn du innerhalb der Creative Cloud arbeitest: Generative Fill in Photoshop, Generative Expand, und Text-Effekte sind nahtlos integriert und -- das ist ein entscheidender Vorteil -- kommerziell unbedenklich, da Firefly nur auf lizenzierten Inhalten trainiert wurde. FLUX.2 und Stable Diffusion SDXL sind die Open-Source-Alternativen für alle, die volle Kontrolle über den Generierungsprozess benötigen und bereit sind, sich mit technischen Details zu befassen.

Professionelles Prompt Engineering für Bilder unterscheidet sich fundamental vom Texten. Während bei Text-Prompts Klarheit und Präzision zählen, arbeiten visülle Prompts mit Schichten: Im Vordergrund steht das Motiv (Was soll dargestellt werden?), dann folgt der Stil (Fotorealistisch? Illustration? Aquarell?), das Licht (Goldene Stunde? Studiobeleuchtung? Dramatisches Chiaroscuro?), die Kameräinstellung (Nahaufnahme? Vogelperspektive? 35mm Weitwinkel?) und schliesslich die Atmosphäre (Warm und einladend? Kuhl und professionell? Mysterioes?). Erfahrene Kreative arbeiten mit Prompt-Templates, die diese Schichten systematisch abdecken und nur das Motiv austauschen, um eine konsistente visülle Sprache über eine gesamte Kampagne hinweg zu gewährleisten.

Ein besonders mächtige Technik für 2026 ist das Arbeiten mit Referenzbildern. Sowohl Midjourney als auch Firefly erlauben es, ein Referenzbild mitzugeben, das Stil, Farbpalette oder Komposition vorgibt. In der Praxis bedeutet das: Du erstellst ein Moodboard mit dem gewünschten Look, nutzt eines der Bilder als Stil-Referenz, und alle folgenden Generierungen folgen dieser ästhetischen Linie. Für Corporate Design und Markenarbeit ist das ein Gamechanger, weil es das Problem der visüllen Konsistenz löst, das KI-generierte Bilder lange hatten.

Lektion 3: KI-Video -- Von Text zu Film

Video ist das aufwändigste kreative Medium überhaupt. Ein einminütiger Werbespot kann eine sechsstellige Summe kosten, wenn Dreh, Schauspiel, Location, Post-Produktion und Musik zusammenkommen. KI-Videogenerierung demokratisiert dieses Medium radikal: Was früher Tage dauerte und Tausende kostete, ist 2026 in Minuten und für zweistellige Beträge möglich. Allerdings mit wichtigen Einschränkungen, die man kennen muss.

Runway Gen-4 hat sich als führendes Tool für KI-Videogenerierung etabliert. Die Plattform beherrscht Text-to-Video (aus einer Textbeschreibung wird ein Clip), Image-to-Video (ein Standbild wird animiert) und Video-to-Video (ein bestehendes Video wird stilistisch transformiert). Die Qualität hat 2026 einen Punkt erreicht, an dem kurze Clips für Social Media, Produktpräsentationen und Erklärvideos professionell einsetzbar sind. Besonders beeindruckend ist die Konsistenz: Charaktere behalten ihr Aussehen über mehrere Szenen hinweg bei, und die physikalische Plausibilität von Bewegungen hat sich dramatisch verbessert.

OpenAIs Sora hat nach einem holprigen Start ebenfalls nachgelegt und überzeugt besonders bei längeren Clips und komplexen Szenen mit mehreren Akteuren. Die chinesischen Tools Kling und HailuoAI bieten überraschende Qualität zu niedrigeren Preisen und haben sich eine treue Nutzerbasis aufgebaut. Pika hat sich auf Motion Design und kurze Loop-Animationen spezialisiert und ist damit ideal für Social-Media-Content und UI-Animationen.

Der praktische Workflow für KI-Videoproduktion unterscheidet sich grundlegend von traditioneller Filmproduktion. Statt eines linearen Prozesses (Drehbuch, Dreh, Schnitt) arbeitest du iterativ: Du generierst mehrere Varianten einer Szene, wählst die beste aus, verfeinerst sie durch Regenerierung mit angepasstem Prompt, und fügst die fertigen Clips in einem klassischen Schnittprogramm zusammen. Die KI ersetzt also nicht den gesamten Produktionsprozess, sondern übernimmt die aufwändigste Phase: die Erzeugung des Rohmaterials. Schnitt, Timing, Sounddesign und die kreative Vision bleiben beim Menschen.

Für professionelle Ergebnisse ist es entscheidend, die Grenzen der Technologie zu kennen. Längere zusammenhängende Videos über 30 Sekunden sind nach wie vor schwierig. Präzise Textdarstellung in Videos gelingt nur unzuverlässig. Und spezifische Markenelemente wie Logos oder Produktdesigns lassen sich noch nicht zuverlässig reproduzieren. Die Lösung liegt in hybriden Workflows: KI generiert Hintergründe und atmosphärische Szenen, während Logos, Text-Overlays und Produktshots traditionell eingebunden werden.

Lektion 4: Audio und Musik -- KI als Klangkünstler

Die KI-Revolution in der Audioproduktion ist vielleicht die am wenigsten beachtete, dabei aber eine der fortgeschrittensten. Während KI-Bilder und Videos viel Aufmerksamkeit erhalten, haben Tools wie Suno, Udio und ElevenLabs die Musikproduktion und Sprachsynthese auf ein Niveau gebracht, das selbst Branchenexperten überrascht.

Suno hat sich in Version 5 als das Midjourney der Musik etabliert. Du beschreibst in natürlicher Sprache, welche Art von Musik du möchtest -- Genre, Stimmung, Tempo, Instrumente -- und erhältst in weniger als einer Minute einen vollständigen Song mit Gesang, Instrumenten und professionellem Mix. Die Qualität reicht für Hintergrundmusik in Videos, Podcasts, Präsentationen und sogar für Social-Media-Jingles völlig aus. Was noch vor zwei Jahren nach roboterhaftem Geleiere klang, ist 2026 emotional nuanciert und rhythmisch präzise.

ElevenLabs hat die Sprachsynthese perfektioniert. Die Text-to-Speech-Engine erzeugt Stimmen, die von echten menschlichen Sprechern kaum zu unterscheiden sind, in über 30 Sprachen. Für Kreative eröffnet das völlig neue Möglichkeiten: Erklärvideos mit professioneller Vertonung, ohne einen Sprecher buchen zu müssen. Podcast-Intros in verschiedenen Sprachen für internationale Zielgruppen. Hörbuch-Prototypen, um zu testen, ob ein Konzept funktioniert, bevor man in eine professionelle Produktion investiert. Besonders mächtig ist das Voice Cloning: Mit wenigen Minuten Audiomaterial kannst du eine Stimme nachbilden und dann beliebige Texte in dieser Stimme generieren -- natürlich nur mit Einverständnis des Stimmgebers.

Für die praktische Integration in kreative Workflows hat sich ein bestimmtes Muster bewährt. Du erstellst erst das visülle Konzept (Video, Präsentation, Website), definierst dann die Audio-Anforderungen pro Szene oder Abschnitt, generierst mehrere Audio-Varianten und wählst die passendste aus. Wichtig ist dabei die Trennung von Musik und Sprache: Hintergrundmusik und Voiceover sollten separat generiert und erst im Schnittprogramm zusammengefügt werden, um volle Kontrolle über Lautstärke, Timing und Übergänge zu behalten. Die besten Ergebnisse erzielst du, wenn du KI-Audio als hochwertige Vorlage verstehst, die du in einer DAW (Digital Audio Workstation) wie GarageBand, Logic oder Audacity feinjustierst.

Lektion 5: UX/UI Design mit KI-Unterstützung

Die Integration von KI in den UX/UI-Design-Prozess hat 2026 eine neue Qualität erreicht. Während frühe KI-Design-Tools hauptsächlich Varianten von Layouts generierten, arbeiten aktülle Systeme kontextbewusst: Sie verstehen Designsysteme, kennen Accessibility-Richtlinien und können auf Basis von Nutzerdaten datengetriebene Designentscheidungen vorschlagen.

Figma hat mit seiner AI-Integration den Standard gesetzt. Die "First Draft"-Funktion generiert auf Basis einer natürlichsprachlichen Beschreibung einen vollständigen Screen-Entwurf, der die bestehenden Design-Tokens und Komponenten deines Teams verwendet. Das ist ein fundamentaler Unterschied zu generischen Generatoren: Statt eines beliebigen Designs erhältst du einen Entwurf, der zu deinem bestehenden Designsystem passt. Die "Make Designs"-Funktion geht noch weiter und erstellt mehrere Varianten gleichzeitig, die du als Diskussionsgrundlage im Team verwenden kannst.

Der wertvollste KI-Einsatz im UX-Design liegt jedoch nicht in der Generierung, sondern in der Analyse. Tools wie Attention Insight simulieren, wohin Nutzer auf einem Screen zürst schauen, und liefern Heatmaps ohne echte Nutzertests. UXCam und Maze nutzen KI, um Nutzer-Sessions zu analysieren und Pain Points automatisch zu identifizieren. Diese Tools ersetzen keine echte User Research, aber sie ermöglicht es, frühzeitig im Designprozess offensichtliche Probleme zu erkennen, bevor aufwändige Nutzertests durchgeführt werden.

Ein praxiserprobter KI-unterstützter Design-Workflow sieht so aus: Du startest mit einer Textbeschreibung des gewünschten Screens und lässt Figma AI oder ein vergleichbares Tool einen ersten Entwurf generieren. Diesen Entwurf verfeinest du manüll und passt Abstande, Typografie und Interaktionsmuster an. Dann lässt du eine KI-gestützte Accessibility-Prüfung laufen, die Kontrastverhältnisse, Schriftgrössen und Touch-Target-Grössen überprüft. Schliesslich testest du den Entwurf mit einem KI-basierten Attention-Analyse-Tool, um sicherzustellen, dass die wichtigsten Elemente die nötige visülle Aufmerksamkeit erhalten. Dieser Prozess reduziert die Iterationszyklen drastisch, weil viele Probleme bereits im ersten Durchlauf erkannt und behoben werden.

Lektion 6: Rechtliche Rahmenbedingungen -- Urheberrecht und KI-generierte Werke

Die rechtliche Landschaft rund um KI-generierte kreative Werke ist 2026 noch immer komplex, hat sich aber deutlich geklärt. Wer KI-Tools professionell einsetzt, muss die Grundzüge kennen, um rechtliche Risiken zu vermeiden und die eigenen Werke schützen zu können.

In der Europäischen Union hat der EU AI Act ab dem 2. August 2026 einen verbindlichen Rahmen geschaffen. KI-generierte Bilder, Videos, Audio und Texte müssen maschinenlesbar (per Metadaten oder Wasserzeichen) und für Menschen sichtbar gekennzeichnet werden. Die Bussgelder für Verstösse betragen bis zu 35 Millionen Euro. Für den urheberrechtlichen Schutz gilt weiterhin der Grundsatz, dass ein Werk eine "persönliche geistige Schöpfung" darstellen muss: Rein per Prompt generierte Bilder sind gemeinfrei und geniessen keinen Urheberrechtsschutz. Ein wegweisendes Urteil des LG Frankfurt (Dezember 2025) hat dies für hybride Werke präzisiert: Ein menschlich verfasster Songtext ist geschützt, die KI-generierte Musik dazu nicht. Die praktische Konsequenz für Kreative ist klar: Substanzielle menschliche Bearbeitung sichert die Schutzfähigkeit, und jeder KI-Einsatz im Workflow sollte dokumentiert werden.

In den USA hat das Copyright Office 2025 klargestellt, dass rein KI-generierte Bilder nicht urheberrechtlich schützbar sind, während Werke mit "sufficient human authorship" geschützt werden können. Die Grenze ist fliessend, und die Rechtsprechung entwickelt sich laufend weiter. Für internationale Kampagnen bedeutet das: Man sollte immer dokumentieren, welchen kreativen Beitrag der Mensch geleistet hat, um im Streitfall die Schutzfähigkeit belegen zu können.

Auf der anderen Seite stehen die Rechte der Künstler, deren Werke als Trainingsdaten verwendet wurden. Mehrere hochkarätige Klagen (Getty Images gegen Stability AI, Künstler gegen Midjourney) haben zu Vergleichen geführt, die zu mehr Transparenz und Opt-out-Möglichkeiten für Künstler geführt haben. Adobe Firefly bleibt hier die sicherste Wahl, da es ausschliesslich auf lizenzierten Daten trainiert wurde. Wer mit Midjourney oder Stable Diffusion arbeitet, sollte insbesondere bei kommerziellen Projekten die jeweiligen Nutzungsbedingungen genau kennen und im Zweifel eine rechtliche Beratung einholen.

Ein pragmatischer Ansatz für Kreativagenturen ist die "KI als Startpunkt"-Strategie: KI-generierte Bilder dienen als Inspiration, Moodboard oder Kompositionsvorlage, werden aber nicht eins zu eins für kommerzielle Zwecke verwendet. Der kreative Mehrwert entsteht durch die menschliche Verfeinerung, Anpassung und Integration in ein Gesamtkonzept. Dieser Ansatz minimiert rechtliche Risiken und stellt gleichzeitig sicher, dass die Arbeit einen echten kreativen Mehrwert bietet, der über das hinausgeht, was jeder mit dem gleichen Prompt erzielen könnte.

Lektion 7: KI-Workflows für kreative Teams

Einzelne KI-Tools zu kennen ist eine Sache, sie in den Arbeitsalltag eines kreativen Teams zu integrieren eine ganz andere. In dieser Lektion schauen wir uns bewährte Workflows an, die Teams unterschiedlicher Grösse und Disziplinen produktiver machen, ohne die kreative Qualität zu opfern.

Der "Briefing-to-Concept"-Workflow ist einer der wirkungsvollsten. Traditionell dauert es Tage, bis ein Kreativteam auf ein Kundenbriefing mit ersten Konzepten antwortet: Briefing-Analyse, Recherche, Moodboard-Erstellung, erste Skizzen. Mit KI verkürzt sich dieser Prozess auf wenige Stunden. Der Art Director füttert das Briefing in ein Sprachmodell, das die Kernbotschaft, Zielgruppe und gewünschte Tonalität herausarbeitet. Basierend darauf generiert Midjourney oder Firefly zehn bis zwanzig Bildkonzepte in verschiedenen Stilen. Ein weiteres KI-Tool erstellt Headline-Varianten und Copytext-Entwürfe. Aus diesem Material kuratiert das Team die stärksten Ansätze und prasentiert dem Kunden nicht einen, sondern drei bis fünf ausgearbeitete Konzeptrichtungen. Der Kunde erhält schneller mehr Auswahl, und das Team kann seine Energie auf die Verfeinerung des gewählten Konzepts konzentrieren statt auf die zeitraubende Erstproduktion.

Für wiederkehrende Aufgaben wie Social-Media-Content hat sich der "Template-und-Variieren"-Workflow bewährt. Das Team erstellt ein Set von Vorlagen für verschiedene Content-Typen (Zitatbild, Produkthighlight, Behind-the-Scenes, Infografik), die den visüllen Stil der Marke definieren. Für jeden neuen Post wird nur noch der Inhalt ausgetauscht, während KI-Tools die Anpassung an verschiedene Formate (Instagram Square, Story, LinkedIn, TikTok) automatisieren. Canva AI ist für diesen Workflow besonders geeignet, weil es Markenvorlagen mit KI-gestützter Anpassung kombiniert.

Der Schlüssel zum Erfolg liegt in der Definition klarer Rollen: Die KI ist das Produktionswerkzeug, der Mensch ist der kreative Direktor. Jedes KI-Output durchläuft einen menschlichen Review, bevor es an den Kunden oder in die Öffentlichkeit geht. Teams, die diese Rollenverteilung früh etablieren, berichten von deutlich höherer Akzeptanz und besseren Ergebnissen als Teams, die KI entweder komplett ablehnen oder unkritisch übernehmen. Die beste kreative Arbeit entsteht 2026 in der Kollaboration zwischen menschlicher Vision und maschineller Ausführung.

Lektion 8: Deine kreative KI-Strategie entwickeln

Am Ende dieses Kurses steht die Frage: Wie integrierst du KI konkret in deine kreative Arbeit? Die Antwort ist so individüll wie deine Disziplin, dein Team und deine Kunden. Doch es gibt bewährte Prinzipien, die für alle Kreativen gelten.

Das erste Prinzip ist die 80/20-Regel der kreativen KI -- aber mit einem wichtigen Caveat. Etwa 80 Prozent der kreativen Arbeit besteht aus Routineaufgaben, die wichtig, aber nicht kreativ fordernd sind: Bildgrössen anpassen, Varianten erstellen, Texte für verschiedene Kanäle umschreiben, Hintergründe freistellen, Farbkorrekturen vornehmen. Diese 80 Prozent sind ideal für KI-Automatisierung. Die verbleibenden 20 Prozent -- die strategische Konzeption, die emotionale Idee, die überraschende Wendung -- bleiben menschlich. Aber Achtung: Eine bemerkenswerte Studie zeigt, dass erfahrene Designprofis bis zu 57 Prozent mehr Zeit benötigen, wenn sie auf KI-generierte Vorschläge aufbauen müssen, statt von Grund auf selbst zu arbeiten. Die Überarbeitung und Qualitätssicherung von KI-Outputs kann bei High-End-Arbeit länger dauern als eine Eigenproduktion. Bei Routineaufgaben spart KI dagegen massiv Zeit. Die Kunst liegt also darin, genau zu wissen, wann KI hilft und wann sie im Weg steht.

Das zweite Prinzip ist kontinuierliches Lernen. Die KI-Tool-Landschaft entwickelt sich so schnell, dass Wissen von heute in sechs Monaten veraltet sein kann. Plane feste Zeiten ein, um neue Tools zu testen, Prompt-Techniken zu verfeinern und dich mit anderen Kreativen über Best Practices auszutauschen. Communities wie der Midjourney Discord, die Runway-Foren und spezialisierte LinkedIn-Gruppen sind wertvolle Ressourcen.

Das dritte Prinzip ist die ethische Reflexion. Nur weil du etwas mit KI erstellen kannst, heisst das nicht, dass du es solltest. Frage dich bei jedem Projekt: Ist der Einsatz von KI hier transparent? Werden die Rechte anderer Künstler respektiert? Würde ich dem Kunden offen erzählen, wie dieses Werk entstanden ist? Kreative, die diese Fragen ehrlich beantworten und KI verantwortungsvoll einsetzen, bauen langfristiges Vertrauen auf und positionieren sich als zukunftsfähige Partner, die Technologie beherrschen, statt von ihr beherrscht zu werden.

Dein nächster Schritt: Wähle ein konkretes Projekt aus deinem aktüllen Auftragsbestand und identifiziere drei Stellen, an denen KI den Prozess beschleunigen könnte. Teste diese Möglichkeiten bei deinem nächsten Projekt, messe die Zeitersparnis und die Qualität des Ergebnisses. Nach drei bis fünf Projekten mit KI-Unterstützung wirst du ein intuitives Gefühl dafür entwickelt haben, wo KI einen echten Mehrwert bietet und wo menschliche Kreativität unersetzbar bleibt.