Deepfakes und KI-Fakes erkennen

Wie du KI-generierte Bilder, Videos und Audios erkennst -- mit praktischen Tipps gegen Desinformation und für kritische Medienkompetenz

Wie du KI-generierte Bilder, Videos und Audios erkennst -- mit praktischen Tipps gegen Desinformation und für kritische Medienkompetenz

Klicken zum Vergrößern

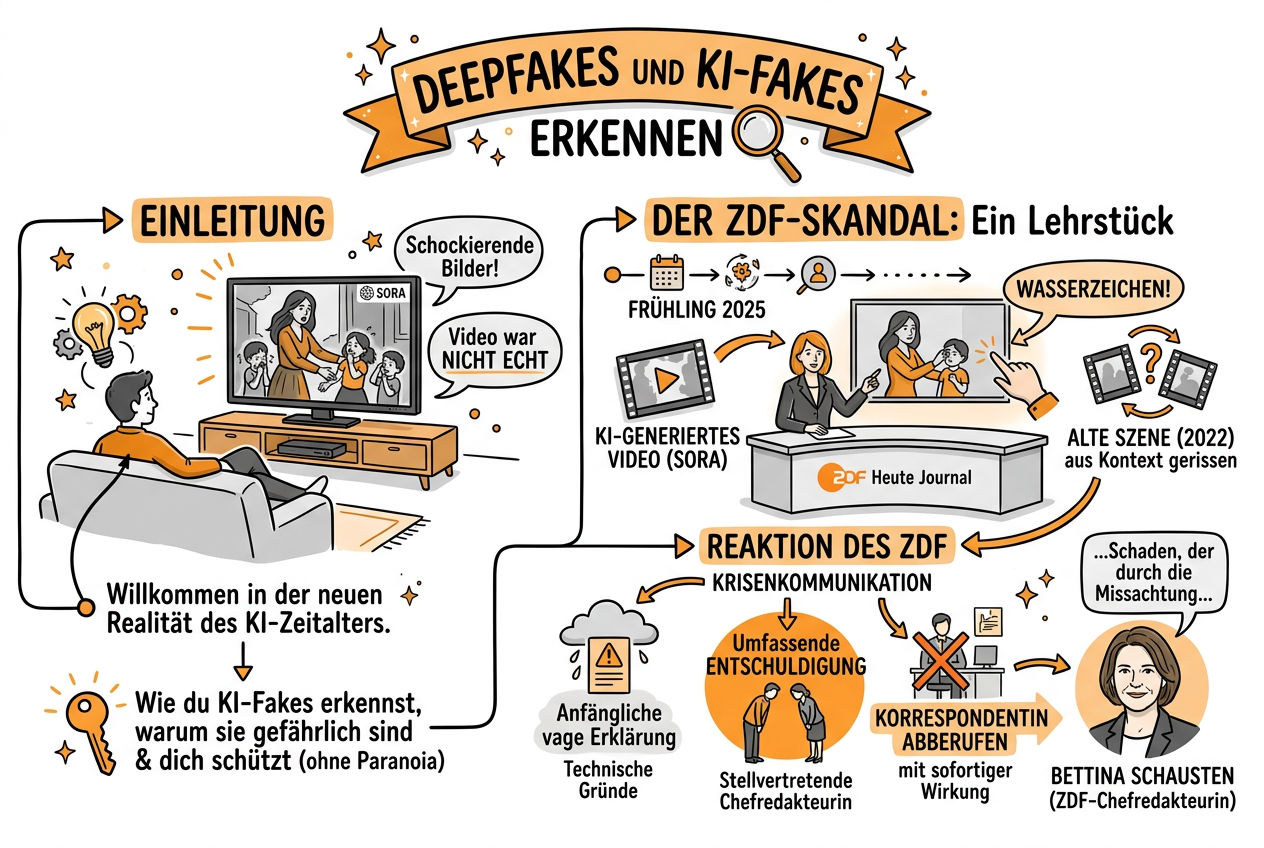

Stell dir vor, du sitzt auf dem Sofa, schaltest die Nachrichten ein und siehst dramatische Bilder: Eine Mutter wird vor den Augen ihrer weinenden Kinder von Grenzbeamten abgeführt. Schockierend. Nur: Das Video war nicht echt. Es war KI-generiert, erstellt mit OpenAIs Sora -- komplett mit sichtbarem Wasserzeichen. Und trotzdem wurde es ohne Kennzeichnung als authentisches Material im ZDF Heute Journal gesendet.

Willkommen in der neuen Realität des KI-Zeitalters. Dieser Kurs zeigt dir, wie du KI-Fakes erkennst, warum sie so gefährlich sind -- und wie du dich und dein Umfeld schützen kannst, ohne in Paranoia zu verfallen.

Im Frühling 2025 verwendete das ZDF Heute Journal in einem Beitrag über Abschiebungen unter der Trump-Administration ein KI-generiertes Video. Der Clip zeigte eine emotionale Szene, die mit Sora erstellt worden war -- Wasserzeichen inklusive. Zusätzlich wurde eine reale Szene aus dem Jahr 2022 aus ihrem ursprünglichen Kontext gerissen und falsch eingeordnet.

Die Reaktion des ZDF war ein Lehrstück in Krisenkommunikation -- im Negativen wie im Positiven. Einer anfänglichen vagen Erklärung über "technische Gründe" folgte eine umfassende Entschuldigung der stellvertretenden Chefredakteurin. Die zuständige Korrespondentin wurde mit sofortiger Wirkung abberufen. ZDF-Chefredakteurin Bettina Schausten erklärte: "Der Schaden, der durch die Missachtung journalistischer Regeln entstanden ist, ist gross. Es geht im Kern um die Glaubwürdigkeit unserer Berichterstattung."

Nur zwei Tage nach dem ZDF-Beitrag explodierte auf Social Media die nächste Kontroverse. Ein Video zeigte die Linken-Fraktionschefin Heidi Reichineck vor einem teuren Audi A8. Rechte Accounts riefen "Doppelmoral" -- und Unterstützer der Linken konterten sofort: "Klar KI-generiert, offensichtlich Fake!"

Die Wahrheit: Das Video war echt. Der Wagen war ein geleastes Dienstfahrzeug der Bundestagsfraktion.

Dieser Doppelschlag zeigt, warum KI-Fakes so gefährlich sind. Nicht nur, weil sie Lügen verbreiten können -- sondern weil sie uns alle misstrauisch machen gegenüber echten Bildern, gegenüber Medien, gegenüber der Wahrheit selbst. Plötzlich glaubt keiner mehr irgendetwas. Und genau das wollen Manipulatoren erreichen: Chaos, Polarisierung und Vertrauensverlust.

Die Zeitschrift "Die Aktülle" veröffentlichte ein vollständig KI-generiertes Interview mit Michäl Schumacher unter der Schlagzeile "Das erste Interview" -- nachdem der ehemalige Formel-1-Profi seit seinem Unfall aus der Öffentlichkeit verschwunden war. Dies war eine bewusst inszenierte Täuschung.

Der Spiegel veröffentlichte am Ende einer Meldung über die Deutsche Bahn versehentlich den letzten Teil eines KI-generierten Texts -- inklusive der Anweisung: "Wenn du magst, pass ich Ton und Detailtiefe an." Ein peinlicher, aber letztlich transparenter Fehler, der jedem auffiel, der den Artikel aufmerksam zu Ende las.

Millionen Menschen glaubten an ein Bild, das Papst Franziskus in einer stylischen weissen Daunenjacke zeigte. Es war KI-generiert -- ein vermeintlich harmloser Spass, der aber zeigte, wie leicht wir getäuscht werden können.

In Deutschland kursieren bereits Deepfakes von Prominenten und Politikern, die perfekt natürlich klingende Statements abgeben -- nur eben völlig erfunden. Bei künftigen Wahlen könnte ein einzelner 15-Sekunden-Clip ausreichen, um eine Wahl zu beeinflussen.

Wer hat es zürst gepostet? Ein serioeses Medium oder ein anonymer Account mit 12 Followern? Wenn etwas zu perfekt, zu emotional und zu passend klingt, solltest du der Sache mit gesunder Skepsis begegnen. Frage dich: Wem nützt diese Information? Welche Emotion soll sie auslösen?

Lade das Bild oder Video herunter und nutze Werkzeuge wie Google Lens, TinEye oder InVID für eine Rückwärtssuche. Wenn das Material nur an einer einzigen Stelle auftaucht und keine weiteren Quellen existieren, solltest du den Wahrheitsgehalt hinterfragen.

Auch wenn Bild- und Videomodelle immer besser werden, machen sie Fehler. Achte auf:

Tipp: Spiele Videos langsam ab. Viele Artefakte werden erst in Zeitlupe sichtbar.

Nutze professionelle Faktenchecker, bevor du Inhalte glaubst oder teilst:

Bevor du etwas teilst, frage dich: Hilft das jemandem -- oder ist es nur provokativer Rage Bait, also ein Beitrag mit dem Ziel, möglichst viel Aufregung zu erzeugen? Jedes Teilen und Weiterverbreiten steigert die Reichweite von Fake News und gibt ihnen mehr Gewicht.

Aktülle KI-Modelle wie Midjourney, DALL-E, Stable Diffusion und Flux können fotorealistische Bilder aus Textbeschreibungen erzeugen. Die Qualität hat sich dramatisch verbessert -- viele generierte Bilder sind auf den ersten Blick nicht mehr von echten Fotos zu unterscheiden.

Tools wie Sora (OpenAI), Kling, Veo (Google) und Seedance können kurze Videoclips generieren, die überzeugend aussehen. Die Qualität ist noch nicht perfekt -- aber sie verbessert sich in atemberaubendem Tempo. Der ZDF-Fall zeigt, dass selbst Journalisten Schwierigkeiten haben, KI-generierte Videos zu erkennen.

Stimmen können mit wenigen Sekunden Audiomaterial geklont werden. Das Ergebnis klingt oft täuschend echt. Besonders gefährlich: Telefonbetrug, bei dem die geklonte Stimme eines Familienmitglieds verwendet wird, um Geld zu erbitten.

Es gibt eine fundamentale Asymmetrie: KI-Fakes zu erstellen wird immer einfacher und billiger. Sie zu erkennen wird immer schwieriger. Diese Asymmetrie wird sich in den kommenden Jahren weiter verschärfen.

Der EU AI Act verpflichtet Anbieter und Nutzer von KI-Systemen zunehmend zur Kennzeichnung KI-generierter Inhalte. Das ist ein wichtiger Schritt, aber kein Allheilmittel -- denn Manipulatoren werden sich kaum an Kennzeichnungspflichten halten. Umso wichtiger bleibt die eigene Medienkompetenz.

KI-Fakes sind Teil unserer Realität und sie werden nicht verschwinden. Im Gegenteil: Die Qualität wird weiter steigen. Was hilft, ist eine gesunde Portion Skepsis und Menschenverstand. Nicht alles glauben, was wir sehen. Nicht reflexhaft "Fake!" schreien bei allem, das uns nicht passt. Sondern innehalten, prüfen, nachdenken -- und erst dann urteilen oder teilen.

Die fünf wichtigsten Punkte:

Medienkompetenz im KI-Zeitalter bedeutet nicht, niemandem mehr zu vertrauen. Es bedeutet, bewusster zu vertrauen -- und die Werkzeuge zu kennen, um Vertrauen auf eine solide Grundlage zu stellen.