KI-gestützte Datenanalyse für Entscheider

Lektion 1: Warum Daten allein nicht reichen — Die neue Rolle der KI in der Analyse

Unternehmen ertrinken in Daten, aber verdursten nach Erkenntnissen. Dieses Paradox beschreibt die Situation in vielen Organisationen, die zwar riesige Datenmengen sammeln, aber nur einen Bruchteil davon tatsächlich für Entscheidungen nutzen. Studien zeigen, dass Führungskräfte im Schnitt weniger als 30 Prozent der verfügbaren Daten in ihre strategischen Entscheidungen einbeziehen — nicht aus Desinteresse, sondern weil die Werkzeuge bisher zu komplex waren.

Künstliche Intelligenz verändert dieses Bild grundlegend. Moderne KI-Systeme können nicht nur strukturierte Tabellen auswerten, sondern auch unstrukturierte Daten wie E-Mails, Berichte, Kundenfeedback und sogar Bilder analysieren. Der entscheidende Unterschied zu klassischer Business Intelligence liegt darin, dass KI Muster erkennt, die Menschen schlicht übersehen würden — etwa saisonale Schwankungen in Kombination mit Wetterdaten und Social-Media-Stimmungen, die gemeinsam einen Umsatzeinbruch vorhersagen.

Für Entscheider bedeutet das einen Paradigmenwechsel: Statt retrospektiv auf Dashboards zu schauen und zu fragen "Was ist passiert?", können sie nun vorausschauend agieren und fragen "Was wird passieren und was sollten wir tun?". Dieser Übergang von deskriptiver zu präskriptiver Analyse ist der Kern der KI-gestützten Datenanalyse. In diesem Kurs lernen Sie, wie Sie diesen Übergang in Ihrer Organisation gestalten — ohne selbst programmieren zu müssen.

Ein mittelständischer Logistikdienstleister aus Süddeutschland illustriert den Wandel anschaulich: Das Unternehmen hatte jahrelang Excel-Tabellen gepflegt, um Lieferzeiten zu optimieren. Nach der Einführung eines KI-gestützten Analysetools sanken die Verspätungen um 23 Prozent, weil das System Zusammenhänge zwischen Wetterbedingungen, Strassenbaustellen und Fahrerauslastung erkannte, die kein Mensch hätte manüll verknüpfen können.

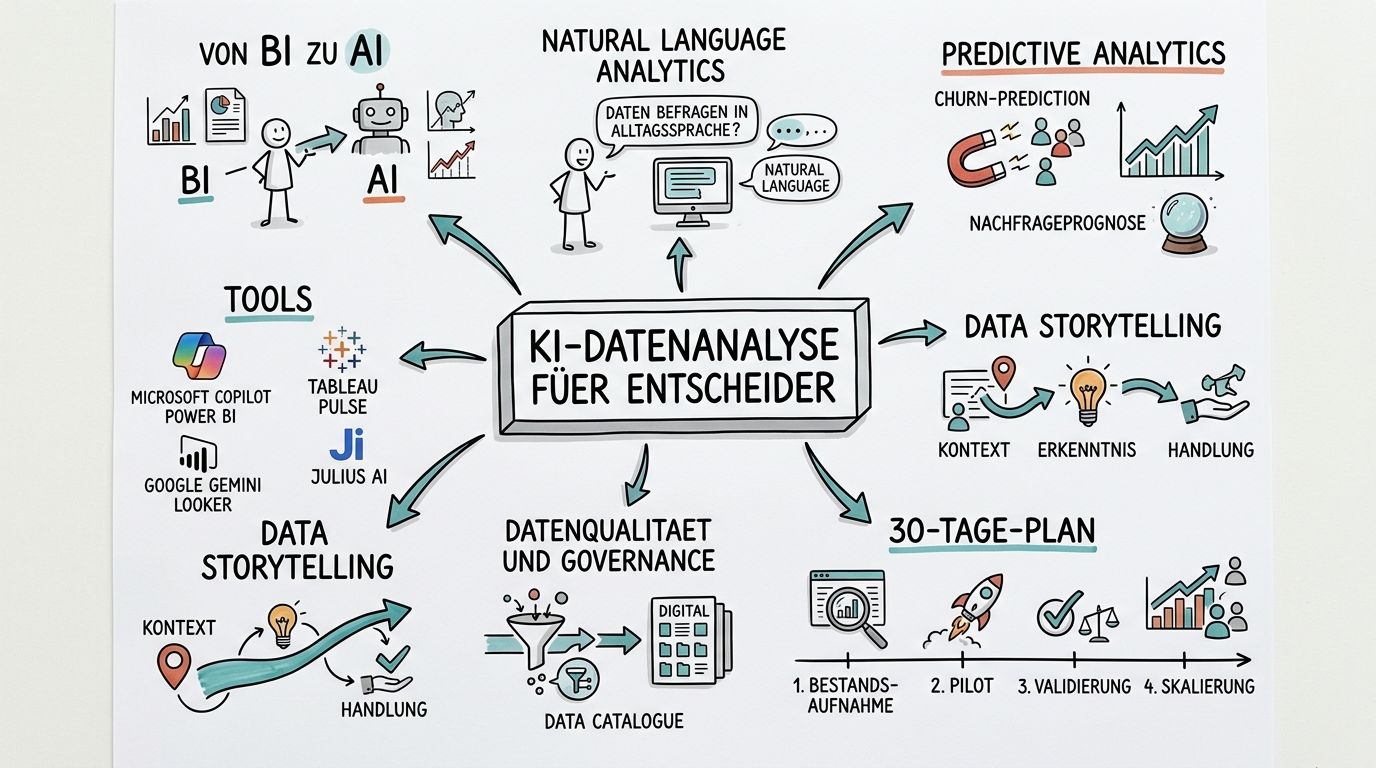

Lektion 2: Von BI zu AI — Wie sich klassische Analyse und KI-Analyse unterscheiden

Business Intelligence und KI-gestützte Analyse werden oft in einen Topf geworfen, doch sie lösen grundverschiedene Probleme. Klassische BI-Tools wie Tableau, Power BI oder Looker sind hervorragend darin, bekannte Fragen zu beantworten: Wie hoch war der Umsatz im letzten Quartal? Welches Produkt läuft am besten? Diese Werkzeuge setzen voraus, dass der Analyst weiss, wonach er suchen muss.

KI-gestützte Analyse dreht dieses Prinzip um. Statt auf vordefinierte Abfragen zu reagieren, durchsucht die KI Datenbestände eigenständig nach Auffälligkeiten, Ausreissern und versteckten Korrelationen. Ein konkretes Beispiel: Ein klassisches BI-Dashboard zeigt, dass die Kundenzufriedenheit im Februar gesunken ist. Ein KI-System würde zusätzlich erkennen, dass der Rückgang mit einer bestimmten Produktcharge zusammenhängt, die überdurchschnittlich viele Retouren verursacht hat — und das Qualitätsteam automatisch benachrichtigen.

Der zweite wesentliche Unterschied liegt in der natürlichen Sprache. Moderne KI-Analysetools wie Microsoft Copilot in Power BI, Google Gemini in Looker oder Tableau Pulse erlauben es, Fragen in Alltagssprache zu stellen: "Warum sind die Kosten im Nordosten gestiegen?" oder "Zeig mir die profitabelsten Kundensegmente der letzten sechs Monate". Die KI übersetzt diese Fragen in Datenbankabfragen, führt sie aus und präsentiert die Ergebnisse als verständliche Zusammenfassung — inklusive Visualisierung.

Das bedeutet nicht, dass BI-Tools überflüssig werden. Vielmehr entsteht eine neue Schicht: KI ergänzt bestehende BI-Infrastrukturen um intelligente Analysefähigkeiten. Unternehmen, die bereits Tableau oder Power BI nutzen, können KI-Funktionen oft per Update aktivieren, ohne ihre gesamte Infrastruktur umzubauen. Der Einstieg war noch nie so niedrigschwellig.

Lektion 3: Die wichtigsten KI-Analysetools im Überblick

Der Markt für KI-gestützte Analysetools hat sich 2026 deutlich konsolidiert. Drei grosse Plattformen dominieren den Enterprise-Bereich, daneben gibt es spezialisierte Lösungen für den Mittelstand und Einzelanwender. Ein fundierter Überblick hilft Ihnen, das richtige Werkzeug für Ihre Anforderungen zu finden.

Microsoft Copilot für Power BI ist für Unternehmen im Microsoft-Ökosystem die naheliegendste Wahl. Die Integration in Excel, Teams und SharePoint macht den Einstieg besonders reibungslos. Sie können direkt in Excel eine Frage stellen wie "Welche Faktoren beeinflussen unsere Marge am stärksten?" und erhalten eine KI-generierte Analyse mit Diagrammen. Die Stärke liegt in der tiefen Integration; die Schwäche in der Abhängigkeit vom Microsoft-Ökosystem und den laufenden Lizenzkosten von etwa 30 Euro pro Nutzer und Monat.

Google Gemini in Looker setzt auf die Stärke von Googles Sprachmodellen. Besonders überzeugend ist die Fähigkeit, komplexe Zusammenhänge in natürlicher Sprache zu erklären. Wenn Sie fragen "Warum sind die Retouren gestiegen?", liefert Gemini nicht nur Zahlen, sondern eine narrative Erklärung mit Hypothesen und Handlungsempfehlungen. Für Unternehmen, die Google Cloud nutzen, ist dies eine exzellente Wahl.

Tableau Pulse von Salesforce verfolgt einen proaktiven Ansatz: Statt auf Fragen zu warten, überwacht das System kontinuierlich alle Metriken und benachrichtigt Sie automatisch bei Auffälligkeiten. "Ihre Conversion Rate im DACH-Raum ist diese Woche um 12 Prozent gefallen — mögliche Ursache: Preisänderung vom Montag" — solche Insights kommen als Push-Nachricht direkt auf Ihr Smartphone.

Für den Mittelstand und kleinere Teams sind Tools wie Julius AI, Rows oder ChatGPT mit Advanced Data Analysis interessant. Julius AI etwa kann CSV-Dateien und Excel-Tabellen direkt verarbeiten und liefert innerhalb von Sekunden Visualisierungen und statistische Auswertungen — ohne Infrastruktur, ohne Setup, für unter 20 Euro im Monat.

Lektion 4: Natural Language Analytics — Daten befragen statt Dashboards lesen

Die vielleicht wichtigste Innovation der letzten zwei Jahre ist die Möglichkeit, mit Daten zu sprechen wie mit einem Kollegen. Natural Language Analytics (NLA) bezeichnet die Fähigkeit von KI-Systemen, Fragen in Alltagssprache zu verstehen, in Datenabfragen umzuwandeln und die Ergebnisse verständlich aufzubereiten. Das demokratisiert Datenanalyse auf eine Weise, die noch vor wenigen Jahren undenkbar war.

Stellen Sie sich vor, Sie sitzen in einem Strategie-Meeting und jemand fragt: "Wie hat sich unser Kundenstamm im Vergleich zum Vorjahr verändert — und welche Segmente wachsen am stärksten?" Früher hätte ein Analyst Stunden gebraucht, um diese Frage zu beantworten. Heute tippen Sie die Frage in Ihr Analysetool, und innerhalb von Sekunden erhalten Sie eine differenzierte Antwort mit Diagramm, Trend und Handlungsempfehlung.

Die Technologie dahinter basiert auf sogenannten Text-to-SQL-Modellen, die natürliche Sprache in Datenbankabfragen übersetzen. Aktülle Modelle erreichen eine Genauigkeit von über 85 Prozent bei Standardfragen. Bei komplexen Abfragen mit mehreren Tabellen und Bedingungen liegt die Trefferquote niedriger, weshalb eine menschliche Plausibilitätsprüfung weiterhin wichtig bleibt. Die Faustregel lautet: Vertrauen Sie den Trends, aber prüfen Sie die exakten Zahlen, bevor Sie strategische Entscheidungen darauf aufbauen.

Ein typischer Workflow sieht so aus: Die Geschäftsführung eines Handelsunternehmens stellt morgens über eine Chat-Oberfläche drei Fragen an ihr Datensystem. Die KI liefert Antworten mit Visualisierungen, markiert Unsicherheiten und schlägt Folgefragen vor. Die Führungskraft entscheidet auf Basis dieser Insights, ob das Marketingbudget für das nächste Quartal angepasst werden sollte. Der gesamte Prozess dauert zehn Minuten statt drei Tage.

Lektion 5: Predictive Analytics — Von der Rückschau zur Vorausschau

Predictive Analytics ist der Bereich, in dem KI ihren grössten Mehrwert für Entscheider entfaltet. Statt vergangene Daten zu beschreiben, sagt die KI künftige Entwicklungen voraus — von Umsatzprognosen über Kundenabwanderung bis hin zu Lieferengpässen. Die Grundidee ist einfach: Wenn ein System genug historische Daten kennt, kann es Muster erkennen und in die Zukunft projizieren.

In der Praxis funktioniert das überraschend gut. Ein mittelständischer Einzelhändler nutzt beispielsweise Predictive Analytics, um den Lagerbestand zu optimieren. Das System analysiert Verkaufsdaten der letzten drei Jahre, kombiniert sie mit Wetterdaten, Feiertagen und lokalen Events und prognostiziert den Bedarf pro Filiale und Produktkategorie für die nächsten vier Wochen. Das Ergebnis: 18 Prozent weniger Überbestände und gleichzeitig 7 Prozent weniger Fehlbestände — ein doppelter Gewinn.

Für Führungskräfte ist besonders die Churn-Prediction relevant: KI-Modelle können mit hoher Genauigkeit vorhersagen, welche Kunden in den nächsten 30 bis 90 Tagen abwandern werden. Die Indikatoren dafür sind oft subtil — nachlassende Nutzungshäufigkeit, verändertes Klickverhalten, ausbleibende Öffnung von Newslettern. Ein Mensch würde diese Signale bei Hunderten oder Tausenden von Kunden niemals rechtzeitig erkennen. Die KI schon — und kann automatisch Gegenmassnahmen vorschlagen, etwa ein personalisiertes Angebot oder einen Anruf des Account Managers.

Wichtig ist dabei die Unterscheidung zwischen Korrelation und Kausalität. Nur weil ein Modell vorhersagt, dass bestimmte Kunden abwandern werden, heisst das nicht, dass die identifizierten Faktoren auch die Ursache sind. Ein erfahrener Entscheider nutzt die KI-Prognosen als Frühwarnsystem, nicht als alleinige Entscheidungsgrundlage. Die beste Kombination ist immer noch: KI-gestützte Daten plus menschliches Urteilsvermögen.

Lektion 6: Data Storytelling — KI-Ergebnisse überzeugend präsentieren

Die beste Analyse ist wertlos, wenn sie nicht verstanden wird. Data Storytelling ist die Kunst, Datenerkenntnisse so aufzubereiten, dass sie Entscheidungen auslösen — nicht nur Verständnis. Und genau hier kann KI eine überraschend grosse Hilfe sein, denn moderne Tools generieren nicht nur Zahlen und Diagramme, sondern auch narrative Zusammenfassungen.

Ein gelungenes Daten-Narrativ folgt immer der gleichen Struktur: Kontext, Erkenntnis, Handlung. Beginnen Sie mit der Situation ("Unsere Kundenakquisekosten sind in den letzten drei Quartalen um 40 Prozent gestiegen"), führen Sie zur Erkenntnis ("Die KI-Analyse zeigt, dass der Anstieg primär durch ineffiziente Google-Ads-Kampagnen in zwei Regionen getrieben wird") und schliessen Sie mit einer konkreten Empfehlung ("Durch Umverteilung des Budgets auf die drei stärksten Kanäle können wir die Kosten um geschätzt 25 Prozent senken").

KI-Tools wie Narrative Science, Quill oder die integrierten Funktionen von Tableau und Power BI können solche Narrationen automatisch generieren. Sie analysieren die Daten, identifizieren die wichtigsten Erkenntnisse und formulieren sie in verständlicher Sprache. Das spart nicht nur Zeit, sondern sorgt auch für Konsistenz — jeder Bericht folgt der gleichen Qualität, unabhängig davon, wer ihn erstellt.

Für Führungskräfte gibt es einen praktischen Tipp: Nutzen Sie KI-generierte Zusammenfassungen als Ausgangspunkt, aber personalisieren Sie die Geschichte für Ihr Publikum. Ein Vorstandsbericht braucht andere Akzente als eine Teambesprechung. Die KI liefert die Fakten; Sie liefern den strategischen Kontext und die emotionale Einordnung, die Menschen zum Handeln bewegt.

Lektion 7: Datenqualität und Governance — Das Fundament jeder KI-Analyse

Keine noch so intelligente KI kann aus schlechten Daten gute Erkenntnisse gewinnen. Datenqualität ist das unsichtbare Fundament jeder KI-gestützten Analyse, und in der Praxis ist es häufig der grösste Stolperstein. Studien zeigen, dass Unternehmen im Durchschnitt 15 bis 25 Prozent ihrer Analysezeit mit dem Bereinigen und Aufbereiten von Daten verbringen — Zeit, die für die eigentliche Analyse fehlt.

Die häufigsten Probleme sind bekannt: doppelte Datensätze, inkonsistente Formate (ist "Deutschland" dasselbe wie "DE" oder "BRD"?), fehlende Werte und veraltete Informationen. KI kann diese Probleme inzwischen teilweise selbst lösen. Tools wie Informatica Claire, Talend Trust Score oder auch einfache Python-Skripte mit KI-Unterstützung erkennen Duplikate, schlagen Korrekturen vor und bewerten die Zuverlässigkeit einzelner Datenquellen automatisch.

Mindestens ebenso wichtig ist die Data Governance — also die Frage, wer auf welche Daten zugreifen darf, wie Daten dokumentiert werden und welche Qualitätsstandards gelten. Mit dem EU AI Act und der DSGVO ist dies nicht nur eine Best Practice, sondern eine rechtliche Pflicht. Unternehmen müssen nachweisen können, auf welcher Datenbasis ihre KI-Systeme Entscheidungen treffen. Ein Data Catalogü — ein zentrales Verzeichnis aller Datensätze mit Beschreibung, Verantwortlichem und Qualitätsbewertung — ist dafür der erste und wichtigste Schritt.

Ein pragmatischer Ansatz für den Mittelstand: Beginnen Sie nicht mit der perfekten Dateninfrastruktur, sondern mit einem konkreten Anwendungsfall. Identifizieren Sie die drei bis fünf wichtigsten Datenquellen für Ihre Analyse, prüfen Sie deren Qualität und definieren Sie klare Verantwortlichkeiten. Alles andere wächst mit der Erfahrung.

Lektion 8: Ihr 30-Tage-Plan — KI-Datenanalyse im eigenen Unternehmen einführen

Die Einführung von KI-gestützter Datenanalyse muss kein Grossprojekt sein. Mit einem fokussierten 30-Tage-Plan können Sie erste Ergebnisse erzielen, die den Weg für eine breitere Nutzung ebnen. Der Schlüssel liegt darin, klein zu starten, schnell zu lernen und dann gezielt zu skalieren.

In der ersten Woche geht es um die Bestandsaufnahme: Welche Datenquellen haben Sie bereits? Welche Analysetools sind im Einsatz? Und vor allem: Welche drei Geschäftsfragen würden Sie am liebsten sofort beantworten können? Diese Fragen bestimmen Ihren Einstiegspunkt. Ein Vertriebsleiter möchte vielleicht wissen, welche Leads am wahrscheinlichsten konvertieren. Eine Marketingchefin fragt sich, welche Kampagnen den höchsten ROI liefern. Ein Geschäftsführer will die Kosten pro Kunde pro Kanal verstehen. Wählen Sie eine dieser Fragen als Pilotprojekt.

In Woche zwei richten Sie Ihr erstes KI-Analysetool ein. Für den schnellsten Start eignen sich Microsoft Copilot in Excel oder Power BI (wenn Sie Microsoft nutzen), Julius AI (Tool-agnostisch, Browser-basiert) oder ChatGPT Advanced Data Analysis (für einmalige Ad-hoc-Analysen). Laden Sie einen relevanten Datensatz hoch und stellen Sie Ihre Pilotfrage. Die Qualität der ersten Antworten wird Sie überraschen — und gleichzeitig die Grenzen aufzeigen.

Woche drei widmen Sie der Validierung und Verfeinerung: Stimmen die KI-Ergebnisse mit dem überein, was Ihre Experten wissen? Wo gibt es Abweichungen und warum? Dieser Abgleich ist essenziell, denn er baut Vertrauen auf und deckt Datenqualitätsprobleme auf. Dokumentieren Sie Ihre Erkenntnisse und teilen Sie sie mit dem Team.

In der vierten Woche präsentieren Sie die Ergebnisse Ihres Pilotprojekts der Geschäftsleitung — mit konkreten Zahlen, einem klaren ROI-Nachweis und einem Vorschlag, welche zwei bis drei weiteren Anwendungsfälle als Nächstes angegangen werden sollten. Dieser strukturierte Ansatz minimiert das Risiko und maximiert die Akzeptanz im Unternehmen. Denn am Ende entscheidet nicht die Technologie über den Erfolg, sondern die Bereitschaft der Menschen, auf Basis von Daten besser zu entscheiden.