KI-Bildgenerierung für Business: Vom Prompt zum professionellen Visual

Lektion 1: Warum KI-Bilder das Marketing verändern

Die Bildgenerierung durch künstliche Intelligenz hat in den letzten Monaten einen Qualitätssprung erreicht, der die Spielregeln für Marketing, Branding und visülle Kommunikation grundlegend verändert. Was vor zwei Jahren noch als interessantes Experiment galt, ist heute ein vollwertiges Produktionswerkzeug. Unternehmen erstellen mit KI-Bildgeneratoren in Minuten Social-Media-Grafiken, Präsentationsbilder und Produktvisualisierungen, für die früher ein Fotoshooting oder ein Grafikdesigner nötig gewesen wäre.

Der eigentliche Durchbruch liegt nicht in der blossen Fähigkeit, Bilder zu erzeugen, sondern in der Konsistenz und Steuerbarkeit. Aktülle Modelle wie Midjourney v7 können Markenelemente, wiederkehrende Charaktere und einen bestimmten visüllen Stil über Dutzende von Bildern hinweg beibehalten. Für ein Unternehmen bedeutet das: Eine einheitliche Bildsprache für den gesamten Markenauftritt, ohne für jedes einzelne Visual einen Designer zu beauftragen. Ein Beratungsunternehmen kann so seine gesamte LinkedIn-Präsenz, Website-Grafiken und Präsentation-Templates in einem konsistenten Stil erstellen.

Gleichzeitig wächst die rechtliche Komplexität. Der EU AI Act schreibt ab August 2026 eine Kennzeichnungspflicht für KI-generierte Inhalte vor. Unternehmen müssen also nicht nur lernen, KI-Bilder effektiv zu erstellen, sondern auch, wie sie diese rechtssicher einsetzen. Wer diese Balance meistert, verschafft sich einen enormen Wettbewerbsvorteil gegenüber Konkurrenten, die entweder auf teure Stockfotos setzen oder ungekennzeichnete KI-Bilder verwenden und damit rechtliche Risiken eingehen.

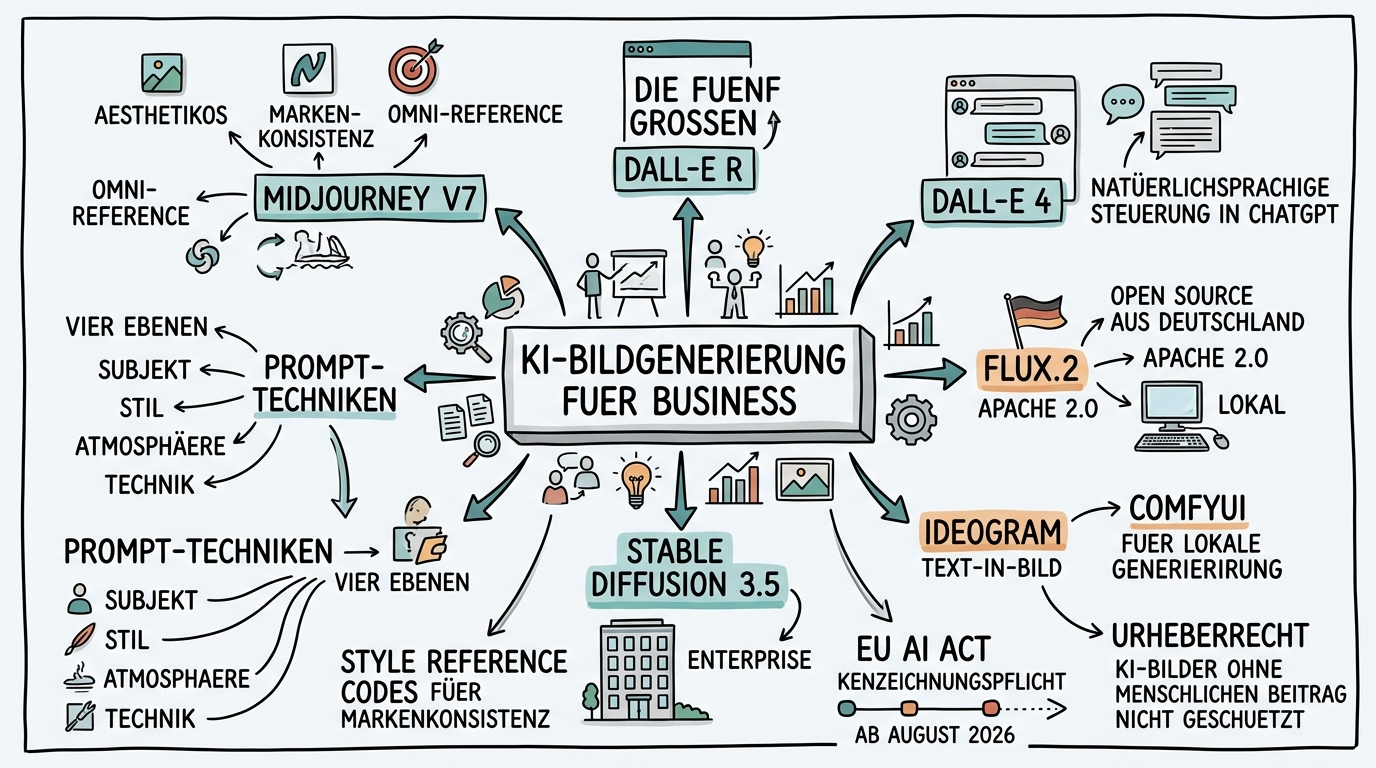

Lektion 2: Die fünf grossen KI-Bildgeneratoren im Vergleich

Midjourney v7 hat sich als der König der Ästhetik etabliert. Das im April 2025 veröffentlichte Update brachte zwei Game-Changer für den Business-Einsatz: Omni-Reference erlaubt es, bestimmte Elemente wie Logos, Charaktere oder Stile als Anker zu setzen und über verschiedene Bilder hinweg konsistent zu halten. Der Draft Mode generiert Bilder in zehnfacher Geschwindigkeit bei halben Kosten, was ihn ideal für schnelles Prototyping in Brainstorming-Phasen macht. Die Qualität bei Händen, Körpern und komplexen Texturen wurde so stark verbessert, dass KI-generierte Bilder kaum noch als solche erkennbar sind. Midjourney ist die erste Wahl für Teams, die Wert auf ästhetische Qualität und Markenkonsistenz legen.

DALL-E 4 von OpenAI, integriert in ChatGPT, punktet mit einer völlig anderen Stärke: der natürlichsprachigen Steuerung. Weil DALL-E direkt in ChatGPT eingebettet ist, können Nutzer ihre Bilder im Gespräch entwickeln und iterativ verfeinern. Man beschreibt seine Vorstellung, bekommt ein Ergebnis, sagt "mach den Hintergrund wärmer und füge links einen Laptopbildschirm hinzu", und die KI setzt das sofort um. Für Nicht-Designer ist das die zugänglichste Lösung auf dem Markt.

FLUX.2 von Black Forest Labs verdient besondere Aufmerksamkeit, weil es die Open-Source-Alternative aus Deutschland ist. Die 4-Milliarden-Parameter-Version steht unter der Apache-2.0-Lizenz, was bedeutet, dass Unternehmen das Modell völlig kosten- und lizenzfrei in eigene Produkte und Plattformen integrieren können. Die Flow-Matching-Architektur erzeugt Bilder in unter 0,5 Sekunden auf Standard-Hardware. Für Unternehmen mit strengen Datenschutzanforderungen ist FLUX.2 ideal, weil es komplett lokal betrieben werden kann.

Stable Diffusion 3.5 Large mit 8,1 Milliarden Parametern ist das Flaggschiff für Enterprise-Umgebungen. Durch eine Triple-Text-Encoder-Architektur versteht es extrem komplexe, mehrteilige Prompts. Und Ideogram hat sich als Spezialist für Text-in-Bild etabliert und rendert Schriftzüge so zuverlässig wie kein anderes Modell, was es für Werbebanner und Social-Media-Posts mit Text-Overlays zur besten Wahl macht.

Lektion 3: Prompt-Techniken für professionelle Ergebnisse

Der Unterschied zwischen einem mittelmässigen und einem herausragenden KI-Bild liegt fast immer im Prompt. Ein Anfänger schreibt "ein Büro mit Computern", ein Profi schreibt "ein helles, modernes Grossraumbüro im skandinavischen Stil, weiches natürliches Licht von links durch grosse Fenster, zwei Mitarbeiter im Gespräch im Vordergrund, leichte Unschärfe im Hintergrund, fotografiert mit einer 35mm Linse, Editorial Style". Das Ergebnis ist eine völlig andere Liga.

Die wichtigste Technik ist die Schichtung des Prompts in vier Ebenen. Die erste Ebene beschreibt das Subjekt: Was ist im Bild zu sehen? Die zweite Ebene definiert den Stil: Fotografie, Illustration, Flat Design, Isometrisch? Die dritte Ebene legt die Atmosphäre fest: Beleuchtung, Farbpalette, Stimmung. Die vierte Ebene bestimmt die technischen Parameter: Kamerawinkel, Brennweite, Renderqualität. Wer alle vier Ebenen beherrscht, kann seine visülle Vision präzise umsetzen, ohne auf den Zufall angewiesen zu sein.

Für den Business-Einsatz ist die Konsistenz wichtiger als die einzelne Bildqualität. Style Reference Codes in Midjourney und ähnliche Funktionen in anderen Tools erlauben es, einen einmal gefundenen Stil als Referenz zu speichern und auf alle zukünftigen Bilder anzuwenden. In der Praxis erstellt ein Marketing-Team zürst drei bis fünf Referenzbilder, die den gewünschten Markenstil perfekt treffen, und verwendet diese dann als Vorlage für alle weiteren Grafiken. Das Ergebnis ist eine visülle Konsistenz, die früher nur mit einem dedizierten Brand-Designer erreichbar war.

Lektion 4: Workflows für Marketing-Teams

Ein effektiver KI-Bildgenerierungs-Workflow beginnt nicht am Prompt-Fenster, sondern am Briefing. Bevor ein einziges Bild generiert wird, muss klar sein, was das Bild kommunizieren soll, in welchem Kontext es eingesetzt wird und welche technischen Anforderungen es erfüllen muss. Ein LinkedIn-Post braucht ein anderes Format als ein Blog-Header, und eine Präsentation hat andere Qualitätsanforderungen als ein schneller Social-Media-Post.

Der typische Workflow für ein Marketing-Team sieht so aus: Im ersten Schritt wird das Briefing erstellt, das Thema, Format, Stimmung und Markenvorgaben definiert. Im zweiten Schritt werden drei bis fünf Varianten generiert, idealerweise im Draft-Modus für schnelle Iteration. Im dritten Schritt wählt das Team die beste Variante und verfeinert sie in einem oder zwei weiteren Durchläufen. Im vierten Schritt erfolgt die Nachbearbeitung: Zuschnitt auf das richtige Format, eventülle Retuschen in Photoshop oder Canva, und das Hinzufügen von Text-Overlays oder Logos.

Ein wichtiger Praxistipp: Generieren Sie nie nur ein Bild. Die besten Ergebnisse entstehen durch Variation und Auswahl. Erfahrene Teams generieren für jeden Anwendungsfall mindestens zehn Varianten, wählen die besten drei aus und verfeinern dann die Gewinnervariante. Diese Methode ist nicht nur qualitativ überlegen, sondern auch wirtschaftlich sinnvoll, denn die Generierungskosten sind vernachlässigbar gering im Vergleich zur Zeit, die ein Designer für eine einzelne Grafik benötigen würde.

Lektion 5: Lokale Bildgenerierung mit FLUX und ComfyUI

Für Unternehmen mit strengen Datenschutzanforderungen oder hohem Bildvolumen ist die lokale Bildgenerierung eine attraktive Option. Anstatt Prompts an einen Cloud-Dienst zu senden, läuft das KI-Modell direkt auf dem eigenen Rechner oder Server. Die Vorteile liegen auf der Hand: keine monatlichen Abokosten bei hohem Volumen, volle Datensouveränität und keine Abhängigkeit von der Verfügbarkeit externer Dienste.

FLUX.2 von Black Forest Labs ist derzeit das leistungsfähigste Open-Source-Modell für diesen Zweck. Die kleinste Version läuft auf einer Grafikkarte mit 8 GB VRAM, was in vielen aktüllen Laptops und Desktop-PCs vorhanden ist. Für professionelle Qualität empfiehlt sich jedoch eine Grafikkarte mit mindestens 16 GB VRAM, wie sie in Gaming-PCs oder Workstations üblich ist. Die Installation erfolgt über ComfyUI, eine node-basierte Oberfläche, die es erlaubt, komplexe Generierungs-Workflows visüll zusammenzubauen.

ComfyUI wirkt auf den ersten Blick einschüchternd, weil es wie ein Programmiertool aussieht. In der Praxis ist es jedoch nach einer kurzen Einarbeitungszeit von etwa zwei Stunden gut bedienbar und bietet deutlich mehr Kontrolle als die Cloud-Dienste. Man kann ControlNet einsetzen, um die Komposition zu steuern, IP-Adapter für Stil-Transfer verwenden und mehrere Modelle in einer Pipeline kombinieren. Ein Marketingteam, das täglich zwanzig oder mehr Bilder benötigt, amortisiert die Einarbeitungszeit innerhalb weniger Wochen durch wegfallende Abo-Kosten und schnellere Durchlaufzeiten.

Lektion 6: Rechtliche Rahmenbedingungen und EU AI Act

Der EU AI Act bringt ab August 2026 konkrete Pflichten für den Einsatz von KI-generierten Bildern. Artikel 50 schreibt vor, dass KI-generierte Inhalte als solche gekennzeichnet werden müssen. Das betrifft nicht nur offensichtlich künstliche Bilder, sondern auch fotorealistische Darstellungen, die leicht für echte Fotografien gehalten werden könnten. Unternehmen müssen daher ihre Prozesse anpassen und sicherstellen, dass KI-Bilder entweder im Bild selbst oder in den Metadaten als KI-generiert markiert sind.

Die praktische Umsetzung wirft dabei viele Fragen auf, die noch nicht abschliessend geklärt sind. Muss ein bearbeitetes Stockfoto, bei dem der Hintergrund per KI erweitert wurde, als KI-generiert gelten? Wie verhält es sich mit Composings, in denen ein KI-generiertes Element in eine echte Fotografie eingefügt wird? Die aktülle Empfehlung lautet: Im Zweifelsfall kennzeichnen. Die Bussgelder für Verstösse können bis zu 3 Prozent des weltweiten Jahresumsatzes betragen, was die Frage der Kennzeichnung zu einer unternehmerisch relevanten Entscheidung macht.

Beim Urheberrecht ist die Lage in der EU noch komplexer. Grundsätzlich gilt: KI-generierte Bilder ohne signifikanten menschlichen kreativen Beitrag geniessen keinen Urheberrechtsschutz. Das bedeutet, dass ein Wettbewerber das gleiche Bild theoretisch nachgenerieren dürfte. Für Unternehmen, die ihre Bildsprache schützen möchten, empfiehlt es sich daher, KI-generierte Bilder als Ausgangsmaterial zu nutzen und durch menschliche Bearbeitung einen schutzfähigen kreativen Beitrag hinzuzufügen. Markenlogos und Schriftzüge sollten ohnehin nie per KI generiert, sondern immer von einem Designer erstellt und dann in die KI-Bilder integriert werden.

Lektion 7: Praxisprojekt -- Eine komplette Kampagne mit KI-Bildern

Um das Gelernte in die Praxis umzusetzen, durchlaufen wir jetzt eine komplette Kampagne für ein fiktives Beratungsunternehmen, das seine LinkedIn-Präsenz mit KI-generierten Visuals aufbauen möchte. Das Unternehmen hat zehn Mitarbeiter, einen klaren visüllen Stil (modern, warm, menschenzentriert) und benötigt wöchentlich fünf bis sieben LinkedIn-Posts mit passenden Grafiken.

Im ersten Schritt definieren wir die Marken-Richtlinien für die KI-Generierung: warme Farbtöene mit Akzenten in Petrol, fotografischer Stil mit leichter Weichzeichnung, Menschen in natürlichen Arbeitsumgebungen, keine Stock-Foto-Ästhetik mit übertriebenen Lächeln. Diese Vorgaben übersetzten wir in einen Style-Prompt, der als Basis für alle Bilder dient. In Midjourney speichern wir drei Referenzbilder, die diesen Stil perfekt treffen.

Im zweiten Schritt erstellen wir die Bilder für eine Themenwoche zum Thema "KI im Mittelstand". Montag: ein Geschäftsführer, der nachdenklich vor einem Dashboard sitzt. Dienstag: ein Team in einem Workshop mit Post-its und Laptops. Mittwoch: eine Infografik-artige Darstellung der fünf KI-Einstiegspunkte. Donnerstag: ein Vorher-Nachher-Vergleich eines Arbeitsprozesses. Freitag: ein Zitat-Bild mit inspirierender Aussage auf stimmungsvollem Hintergrund. Für jedes Bild generieren wir fünf Varianten, wählen die beste und passen sie im Canva-Editor auf das LinkedIn-Format an. Die gesamte Produktion dauert etwa zwei Stunden für die komplette Woche, ein Bruchteil dessen, was ein Fotoshooting oder die Beauftragung eines Designers kosten würde.