Green AI: Nachhaltige künstliche Intelligenz für Unternehmen

Lektion 1: Der Elefant im Serverraum — wie viel Energie KI wirklich verbraucht

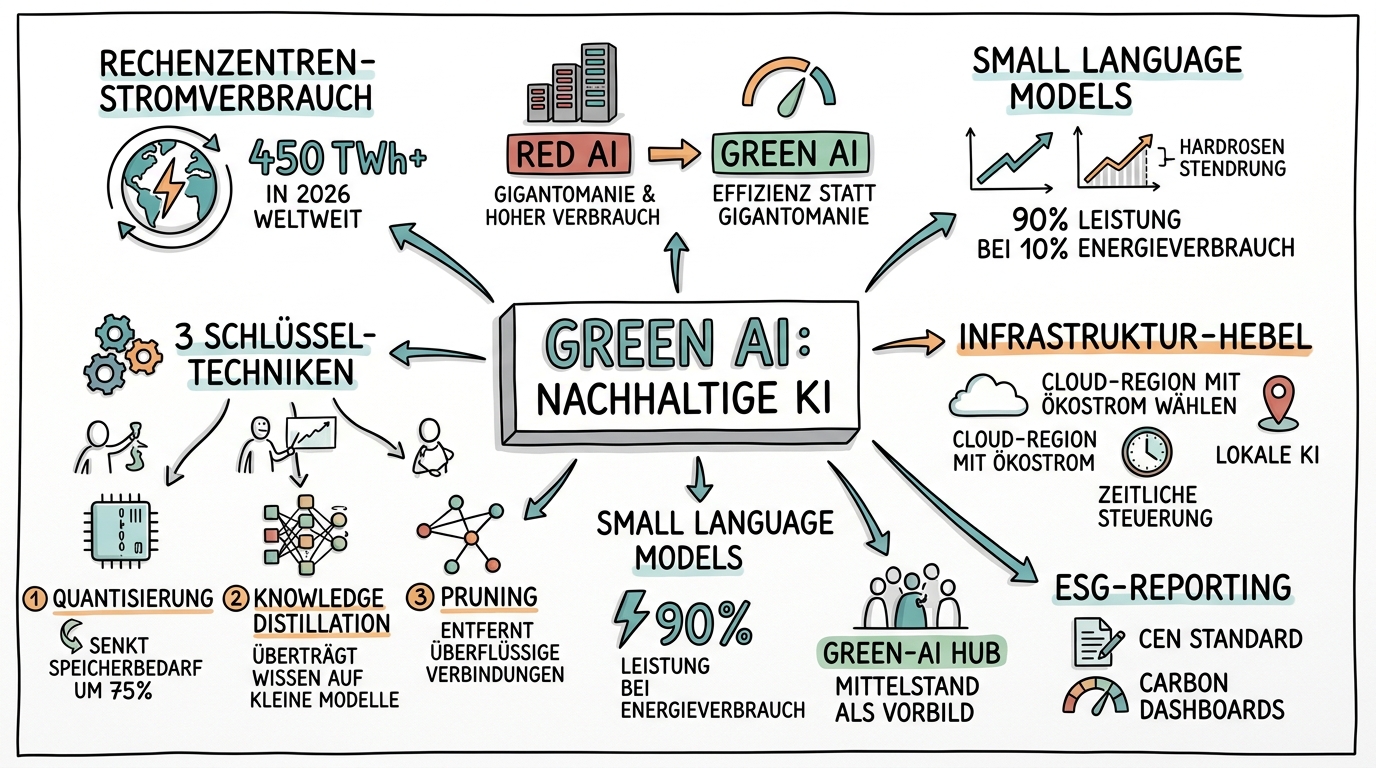

Künstliche Intelligenz hat ein Energieproblem, über das erstaunlich wenig gesprochen wird. Während die Welt begeistert über die Fähigkeiten von GPT-5, Claude und Gemini staunt, wächst der Stromverbrauch der dahinterliegenden Rechenzentren mit atemberaubender Geschwindigkeit. Die Internationale Energieagentur schätzt den globalen Stromverbrauch von Rechenzentren im Jahr 2026 auf über 450 Terawattstunden — das entspricht etwa dem gesamten Stromverbrauch Frankreichs. Und ein erheblicher Anteil dieses Wachstums geht direkt auf das Konto von KI-Workloads.

Um diese Zahlen greifbar zu machen: Eine einzelne Anfrage an ein grosses Sprachmodell wie GPT-5 verbraucht etwa zehnmal so viel Energie wie eine klassische Google-Suche. Das Training eines neuen Foundation-Modells verschlingt so viel Strom wie ein kleines Dorf in einem ganzen Jahr verbraucht. Und mit jeder neuen Modellgeneration steigen die Anforderungen: Mehr Parameter, mehr Trainingsdaten, mehr Rechenleistung. Dieser Trend ist auf Dauer nicht nachhaltig — weder ökologisch noch ökonomisch.

Für Unternehmen ist das nicht nur ein abstraktes Umweltthema, sondern ein handfestes Geschäftsrisiko. Steigende Energiepreise machen KI-Workloads teurer. Die ESG-Berichtspflicht der EU zwingt immer mehr Unternehmen, ihren digitalen Carbon Footprint offenzulegen. Und Kunden sowie Investoren fragen zunehmend nach der Nachhaltigkeit der eingesetzten Technologien. Green AI — also der bewusste, effiziente und nachhaltige Umgang mit künstlicher Intelligenz — ist daher nicht mehr nur ein Thema für Umweltaktivisten, sondern eine strategische Notwendigkeit für jedes Unternehmen, das KI produktiv einsetzt.

Die gute Nachricht: Es gibt heute wirksame Strategien und Technologien, um den Energieverbrauch von KI drastisch zu senken, ohne auf Leistung verzichten zu müssen. Dieser Kurs zeigt, wie Unternehmen das Beste aus beiden Welten erreichen können: maximale KI-Performance bei minimalem ökologischen Fussabdruck.

Lektion 2: Von Red AI zu Green AI — ein Paradigmenwechsel

Die KI-Forschung war lange Zeit von einem Ansatz geprägt, den Forscher als "Red AI" bezeichnen: grössere Modelle, mehr Daten, mehr Rechenleistung — koste es, was es wolle. Der Erfolg wurde primär an der Modellleistung gemessen, während die Kosten für Training und Betrieb kaum eine Rolle spielten. Diese Haltung war verständlich, solange KI ein Forschungsthema war. Seit KI jedoch in der breiten industriellen Anwendung angekommen ist, wird sie zunehmend unhaltbar.

Green AI stellt diesem Ansatz ein neues Paradigma entgegen. Es geht nicht darum, weniger KI zu nutzen, sondern KI intelligenter einzusetzen. Die zentrale Frage lautet: Wie erzeugen wir aus jedem eingesetzten Watt maximalen KI-Wert? Die Antwort liegt in einer Kombination aus effizienteren Modellen, klugerer Infrastruktur und bewussterem Nutzungsverhalten.

Ein besonders eindrucksvolles Beispiel für diesen Paradigmenwechsel sind die Small Language Models, kurz SLMs. Während die grossen Foundation-Modelle mit hunderten Milliarden Parametern arbeiten, zeigen spezialisierte Modelle mit nur wenigen Milliarden Parametern in vielen Anwendungsfällen eine vergleichbare oder sogar bessere Leistung. Microsofts Phi-4, Googles Gemma 3 oder Metas Llama 3.2 beweisen, dass ein gut trainiertes kleines Modell für spezifische Aufgaben einem Generalisten-Giganten ebenbürtig sein kann — bei einem Bruchteil des Energieverbrauchs. Ein mittelständisches Unternehmen, das seine Kundenkommunikation mit einem SLM statt einem grossen Cloud-Modell abwickelt, kann seinen KI-Energieverbrauch um 80 bis 90 Prozent senken.

Der europäische Standard CEN/CLC/TR 18145:2025 bietet erstmals ein einheitliches Framework zur Messung und Bewertung des ökologischen Fussabdrucks von KI-Systemen. Dieser Standard unterscheidet vier Emissions-Scopes — von den direkten Emissionen des Rechenzentrums bis hin zu den indirekten Emissionen durch die Herstellung der Hardware. Für Unternehmen, die ESG-Berichte erstellen müssen, ist dieser Standard ein wertvolles Werkzeug zur systematischen Erfassung ihres KI-bezogenen Carbon Footprints.

Lektion 3: Effiziente Modelle — mehr Leistung mit weniger Ressourcen

Die Effizienz eines KI-Modells lässt sich durch verschiedene Techniken dramatisch steigern, ohne dass die Qualität der Ergebnisse merklich leidet. Drei Verfahren haben sich in der Praxis als besonders wirkungsvoll erwiesen: Quantisierung, Knowledge Distillation und Pruning. Wer diese Techniken versteht, kann fundierte Entscheidungen darüber treffen, welches Modell für welchen Einsatzzweck angemessen ist.

Quantisierung reduziert die Präzision der Zahlenwerte, mit denen ein neuronales Netz intern rechnet. Statt mit 32-Bit-Gleitkommazahlen zu arbeiten, genügen für viele Anwendungen 8-Bit- oder sogar 4-Bit-Darstellungen. Der Effekt ist beeindruckend: Ein quantisiertes Modell benötigt nur einen Bruchteil des Arbeitsspeichers und der Rechenleistung, während die Qualitätseinbussen in den meisten Fällen unter fünf Prozent liegen. Tools wie GPTQ, AWQ oder die in llama.cpp integrierten Quantisierungsmethoden machen diese Technik auch für Nicht-Spezialisten zugänglich.

Knowledge Distillation ist das Verfahren, bei dem ein grosses "Lehrer-Modell" sein Wissen an ein kleineres "Schüler-Modell" weitergibt. Das Schüler-Modell lernt nicht aus den ursprünglichen Trainingsdaten, sondern aus den Ausgaben des Lehrers. Dadurch kann es einen Grossteil der Fähigkeiten des grossen Modells in einem wesentlich kompakteren Format reproduzieren. Dieses Verfahren ist der Grund, warum moderne Small Language Models trotz ihrer geringen Grösse so leistungsfähig sind.

Pruning entfernt überflüsssige Verbindungen aus einem neuronalen Netz — ähnlich wie ein Gärtner tote Äste eines Baumes zurückschneidet, damit die verbleibenden Äste kräftiger wachsen. Untersuchungen zeigen, dass in grossen Sprachmodellen bis zu 90 Prozent der Parameter für die meisten Aufgaben überflüssig sind. Durch gezieltes Pruning lassen sich Modelle drastisch verkleinern, ohne ihre Kernfähigkeiten zu verlieren. In Kombination mit Quantisierung und Distillation können Unternehmen Modelle betreiben, die um den Faktor 10 bis 50 effizienter sind als die ursprünglichen Vollversionen.

Lektion 4: Infrastruktur-Entscheidungen mit Nachhaltigkeitswirkung

Die Wahl der richtigen Infrastruktur hat einen enormen Einfluss auf den ökologischen Fussabdruck von KI-Workloads. Nicht jede GPU-Stunde ist gleich: Je nachdem, wo und wie die Berechnung stattfindet, kann der CO2-Ausstoss um den Faktor zehn oder mehr variieren. Unternehmen, die ihren KI-Energieverbrauch optimieren wollen, müssen daher über die reine Modelleffizienz hinausdenken.

Der offensichtlichste Hebel ist die Wahl des Cloud-Anbieters beziehungsweise des Rechenzentrums. Die grossen Hyperscaler unterscheiden sich erheblich in ihrem Energiemix: Während einige Rechenzentren fast vollständig mit erneuerbaren Energien betrieben werden, setzen andere noch stark auf fossile Brennstoffe. Google Cloud, Microsoft Azure und AWS veröfflichen mittlerweile detaillierte Informationen über den Carbon Footprint ihrer einzelnen Regionen. Ein Unternehmen, das seine KI-Workloads von einer kohlebetriebenen Region in eine Region mit erneuerbarer Energie verlagert, kann seinen CO2-Ausstoss um über 80 Prozent reduzieren — ohne eine einzige Zeile Code zu ändern.

Ein zweiter wichtiger Hebel ist die zeitliche Steuerung von KI-Workloads. Nicht alle Berechnungen müssen in Echtzeit erfolgen. Batch-Verarbeitungen wie das Training von Modellen, die Generierung von Reports oder die Analyse grosser Dokumentenbestände können in Zeiten verschoben werden, in denen der Anteil erneuerbarer Energien im Stromnetz besonders hoch ist — typischerweise tagsüber bei Sonnenschein oder in windreichen Nächten. Tools wie Google Carbon-Intelligent Computing oder Microsofts Carbon-Aware SDK machen diese zeitliche Optimierung inzwischen automatisierbar.

Der dritte und oft unterschätzte Hebel ist die lokale KI-Verarbeitung. Wenn ein Unternehmen Small Language Models lokal auf eigener Hardware betreibt, entfallen nicht nur die Datentransferkosten, sondern auch der Overhead der Cloud-Infrastruktur. Ein gut konfigurierter lokaler Server mit einer modernen GPU kann für viele Standardaufgaben — Textzusammenfassungen, Übersetzungen, Klassifizierungen — die gleiche Arbeit mit einem Bruchteil der Energie erledigen, die ein grosser Cloud-Dienst dafür benötigt. Gleichzeitig bleiben die Daten im Unternehmen, was zusätzlich Datenschutzvorteile bietet.

Lektion 5: Green AI im deutschen Mittelstand — der Green-AI Hub

Deutschland hat erkannt, dass nachhaltiger KI-Einsatz kein Luxusthema, sondern ein Wettbewerbsfaktor ist. Der vom Bundesumweltministerium geförderte "Green-AI Hub Mittelstand" unterstützt kleine und mittlere Unternehmen dabei, KI ressourceneffizient einzusetzen und gleichzeitig ihren ökologischen Fussabdruck zu reduzieren. Die Initiative zeigt exemplarisch, wie Green AI in der Praxis funktioniert.

Der Green-AI Hub verfolgt einen Doppelansatz: Einerseits hilft er Unternehmen, KI für Nachhaltigkeitszwecke einzusetzen — etwa zur Optimierung von Lieferketten, zur Reduzierung von Materialverschwendung oder zur Vorhersage von Wartungsbedarf. Andererseits achtet er darauf, dass die KI-Lösungen selbst möglichst ressourcenschonend gestaltet sind. Dieser doppelte Nachhaltigkeitsfokus ist ein Alleinstellungsmerkmal der deutschen Initiative und dient international als Vorbild.

Konkrete Erfolgsbeispiele aus dem Hub illustrieren das Potenzial. Ein Lebensmittelhersteller nutzt KI, um die Haltbarkeit seiner Produkte präziser vorherzusagen und konnte dadurch die Lebensmittelverschwendung um 30 Prozent reduzieren. Ein Logistikunternehmen optimiert seine Tourenplanung mit KI und spart 15 Prozent Treibstoff ein. Ein Maschinenbauer setzt Predictive Maintenance ein und vermeidet ungeplante Stillstände, was nicht nur Kosten spart, sondern auch den Energieverbrauch der Produktionsanlagen senkt.

Für Unternehmen, die am Green-AI Hub teilnehmen oder ähnliche Initiativen nutzen möchten, ist der Einstieg niedrigschwellig. Die ersten Schritte umfassen typischerweise eine Bestandsaufnahme des aktüllen KI-Energieverbrauchs, die Identifikation von Optimierungspotenzialen und die Umsetzung erster Massnahmen — etwa die Migration von Cloud-Modellen auf lokale, quantisierte Alternativen. Die Förderprogramme des Bundes und der Länder übernehmen häufig einen erheblichen Teil der Beratungskosten.

Lektion 6: ESG-Reporting und der digitale Carbon Footprint

Mit der Corporate Sustainability Reporting Directive (CSRD) der EU müssen immer mehr Unternehmen ihren ökologischen Fussabdruck offenlegen — und dazu gehört zunehmend auch der digitale Carbon Footprint. Für Unternehmen, die KI intensiv nutzen, wird die Frage "Wie viel CO2 verursacht unsere KI?" von einem Nice-to-know zu einem Muss-ich-wissen.

Die Herausforderung bei der Messung des KI-Carbon-Footprints liegt in der Komplexität der Lieferkette. Wenn ein Unternehmen eine KI-API wie die von OpenAI oder Anthropic nutzt, verursacht es nicht nur direkte Emissionen durch den Stromverbrauch der Anfrage, sondern auch indirekte Emissionen durch die Herstellung und den Betrieb der GPU-Server, die Kühlung der Rechenzentren und den Datentransfer über das Internet. All diese Faktoren müssen im ESG-Bericht berücksichtigt werden.

Der europäische Standard CEN/CLC/TR 18145:2025 bietet erstmals eine einheitliche Methodik für diese Berechnung. Er definiert vier Scopes: Scope 1 umfasst die direkten Emissionen des eigenen Rechenzentrums, Scope 2 die indirekten Emissionen durch zugekauften Strom, Scope 3 die Emissionen der gesamten Wertschöpfungskette (einschliesslich Cloud-Anbietern) und der neu eingeführte Scope 4 die vermiedenen Emissionen durch den KI-Einsatz. Letzterer ist besonders interessant: Wenn eine KI-gestützte Routenoptimierung den Treibstoffverbrauch einer Fahrzeugflotte um 15 Prozent senkt, können die dadurch vermiedenen Emissionen im ESG-Bericht positiv angerechnet werden.

Praktische Tools erleichtern die Umsetzung erheblich. Die Cloud-Anbieter stellen Carbon-Dashboards zur Verfügung, die den CO2-Ausstoss einzelner Workloads aufschlüsseln. Für lokale KI-Installationen gibt es Open-Source-Tools wie CodeCarbon oder ML CO2 Impact, die den Energieverbrauch von Trainingslaufen und Inferenz-Operationen in CO2-Äquivalente umrechnen. Ein mittelständisches Unternehmen kann mit diesen Werkzeugen innerhalb weniger Tage ein aussagekräftiges KI-Nachhaltigkeitsreporting aufsetzen, das den Anforderungen der CSRD genügt.

Lektion 7: Nachhaltige KI-Strategie entwickeln

Eine nachhaltige KI-Strategie verbindet Leistungsziele mit Effizienzzielen. Es geht nicht darum, auf KI zu verzichten, sondern darum, KI so einzusetzen, dass der Nutzen den ökologischen Aufwand bei Weitem überwiegt. Diese Balance zu finden, erfordert ein systematisches Vorgehen, das über technische Einzelmassnahmen hinausgeht.

Der Ausgangspunkt ist eine ehrliche Kosten-Nutzen-Analyse jedes KI-Einsatzes. Nicht jede Aufgabe rechtfertigt den Einsatz eines grossen Cloud-Modells. Wenn ein einfacher regelbasierter Algorithmus 95 Prozent der Fälle abdeckt, ist es weder ökonomisch noch ökologisch sinnvoll, stattdessen ein 400-Milliarden-Parameter-Modell einzusetzen. Die Devise lautet: So gross wie nötig, so klein wie möglich. In der Praxis bedeutet das eine Kaskade von Modellen: Einfache Anfragen werden von einem kleinen, schnellen Modell bearbeitet, und nur komplexe Fälle werden an ein leistungsfähigeres Modell weitergeleitet.

Ein zweiter strategischer Hebel ist die Wiederverwendung von Berechnungsergebnissen. Viele KI-Anfragen in einem Unternehmen sind repetitiv: Die gleichen Dokumenttypen werden analysiert, die gleichen Fragestellungen beantwortet, die gleichen Übersetzungen angefordert. Durch intelligentes Caching — also das Zwischenspeichern und Wiederverwenden von KI-Ergebnissen — lassen sich redundante Berechnungen vermeiden. Unternehmen berichten von Einsparungen von 40 bis 60 Prozent der API-Aufrufe durch konsequentes Caching.

Die Verankerung von Nachhaltigkeitszielen in der KI-Governance rundet die Strategie ab. Das bedeutet konkret: Bei der Beschaffung neuer KI-Systeme wird der Energieverbrauch als Bewertungskriterium einbezogen. Bei der Entwicklung eigener Modelle werden Effizienz-Metriken wie "Leistung pro Watt" neben der reinen Genauigkeit getrackt. Und im KI-Governance-Board gibt es eine Stimme, die die Nachhaltigkeitsperspektive einbringt. So wird Green AI nicht zu einem einmaligen Projekt, sondern zu einem dauerhaften Bestandteil der Unternehmenskultur.

Lektion 8: Praxisprojekt — den eigenen KI-Carbon-Footprint messen und optimieren

Dieses Praxisprojekt führt in drei Phasen zu einem messbaren Ergebnis. Am Ende steht nicht nur ein Bericht, sondern ein konkreter Massnahmenplan, der den KI-Energieverbrauch des eigenen Unternehmens spürbar reduziert.

Phase eins ist die Bestandsaufnahme, die etwa eine Woche in Anspruch nimmt. Zunächst werden alle KI-Systeme und -Dienste identifiziert, die im Unternehmen im Einsatz sind. Für jedes System wird erfasst, wie häufig es genutzt wird, welche Datenmengen es verarbeitet und ob es in der Cloud oder lokal betrieben wird. Bei Cloud-Diensten werden die CO2-Dashboards der Anbieter ausgelesen, bei lokalen Installationen wird ein Tool wie CodeCarbon installiert. Am Ende der Woche liegt ein erster CO2-Basiswert vor — die Benchmark, gegen die künftige Optimierungen gemessen werden.

Phase zwei ist die Optimierung, die typischerweise zwei bis vier Wochen dauert. Basierend auf der Bestandsaufnahme werden die grössten Stellschrauben identifiziert. Häufige Quick Wins sind: der Wechsel zu einer Cloud-Region mit besserem Energiemix, die Migration von einem grossen auf ein kleineres, spezialisiertes Modell für wiederkehrende Standardaufgaben, die Einführung von Caching für repetitive Anfragen und die zeitliche Verlagerung von Batch-Jobs in Stunden mit hohem Anteil erneuerbarer Energien. Jede Massnahme wird einzeln implementiert und ihr Effekt auf den CO2-Fussabdruck gemessen.

Phase drei ist die Dokumentation und Verankerung. Die Ergebnisse werden in einem KI-Nachhaltigkeitsbericht zusammengefasst, der sowohl für das interne Management als auch für das ESG-Reporting verwendbar ist. Der Bericht enthält den Ausgangswert, die durchgeführten Massnahmen, die erzielte Reduktion und einen Ausblick auf weitere Optimierungspotenziale. Typische Ergebnisse aus der Praxis zeigen Reduktionen von 30 bis 60 Prozent des KI-bezogenen CO2-Ausstosses — bei gleichbleibender oder sogar verbesserter KI-Leistung. Diese Ergebnisse sind nicht nur ökologisch wertvoll, sondern auch ein starkes Argument für Investoren, Kunden und Mitarbeiter.