Future-Proof Skills für die KI-Ära

Die fünf Frontier-Operations-Skills, die deine Karriere in der KI-Ära definieren -- und warum klassische KI-Kenntnisse allein nicht mehr reichen

Die fünf Frontier-Operations-Skills, die deine Karriere in der KI-Ära definieren -- und warum klassische KI-Kenntnisse allein nicht mehr reichen

Klicken zum Vergrößern

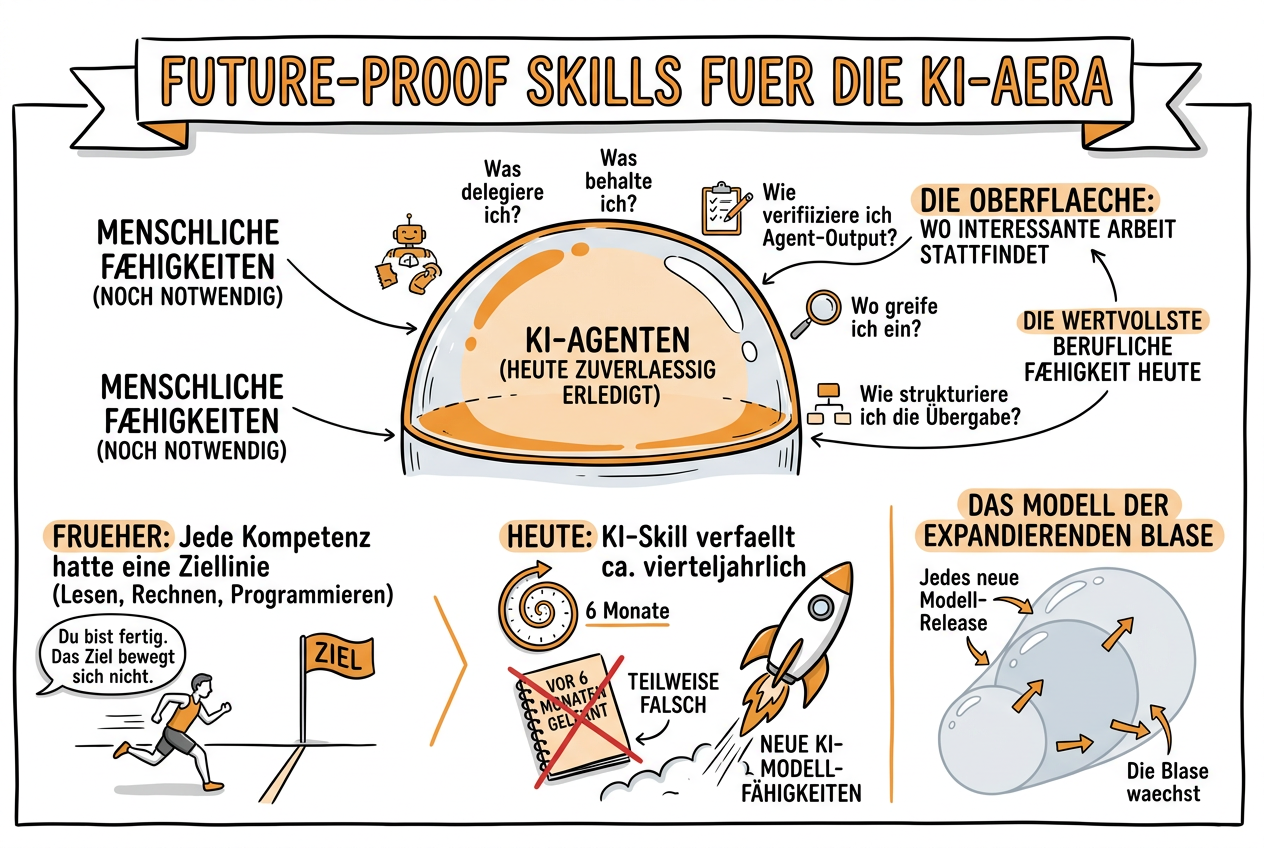

Jede Kompetenz in der Geschichte der Arbeit hatte eine Ziellinie -- einen Punkt, an dem man sie erreicht hatte und fertig war. Lesen, Rechnen, Computerkenntnisse, Programmieren: Man lernt es, man kann es, man ist fertig. Das Ziel bewegt sich nicht.

Bei KI ist das anders. Fundamental anders. KI ist die erste Kompetenz in der Geschichte der Arbeit, die auf einem ungefähr vierteljährlichen Zyklus verfällt. Was du vor sechs Monaten gelernt hast, ist heute teilweise falsch. Nicht weil du schlecht gelernt hast, sondern weil sich die Fähigkeiten der KI-Modelle seitdem grundlegend verändert haben.

Dieser Kurs gibt dir ein Framework für die fünf Skills, die an der Grenze zwischen Mensch und KI bestehen bleiben -- egal wie schnell sich die Modelle verbessern.

Stell dir eine Blase vor. Die Luft darin ist alles, was KI-Agenten heute zuverlässig erledigen können. Die Luft ausserhalb ist alles, was noch einen Menschen braucht. Die Oberfläche dieser Blase -- diese dünne, gekrümmte Membran -- das ist der Ort, an dem die interessante Arbeit gerade stattfindet.

Hier entscheidest du:

An dieser Oberfläche gut zu arbeiten, ist die wertvollste berufliche Fähigkeit in der Wirtschaft heute.

Aber die Blase bläst sich auf. Jedes neue Modell-Release, jeder Fähigkeitssprung, jeder Zuwachs in Reasoning oder Kontext oder Tool-Nutzung: Die Blase wird grösser. Aufgaben, die auf der Oberfläche sassen, wandern ins Innere, wo Agenten sie besser erledigen als Menschen.

Und hier passiert etwas Entscheidendes, das die meisten übersehen: Wenn die Blase expandiert, wächst die Oberfläche mit. Die Grenze schrumpft nicht, wenn KI leistungsfähiger wird -- sie wächst. Es gibt mehr Stellen für menschliches Urteilsvermögen, nicht weniger. Mehr Nähtezwischen menschlicher und Agent-Arbeit. Mehr Entscheidungen darüber, was die KI-Membran passiert und was nicht.

Bevor wir zu den Skills kommen, ein entscheidender Kontext: Es gibt zwei Kurven, die die aktülle KI-Landschaft definieren.

Kurve 1: KI-Fähigkeit. Sie steigt extrem schnell. Modell-Intelligenz, Reasoning-Tiefe, agentische Ausdauer -- alles beschleunigt sich. Gemini hat sein Reasoning in nur drei Monaten verdoppelt.

Kurve 2: Gesellschaftliche Verbreitung. Die Rate, mit der diese Fähigkeiten tatsächlich die Wirtschaft durchdringen und verändern, wie gearbeitet wird. Diese Kurve ist viel, viel flacher. Sie wird von vier Trägheitskräften gebremst:

Die Lücke zwischen diesen beiden Kurven -- das ist der Ort, an dem wir alle heute leben. Und es ist genau diese Lücke, die eine enorme wirtschaftliche Chance darstellt. Wer an der Fähigkeitsgrenze operiert, während der Rest der Wirtschaft sich mit der Verbreitungsrate bewegt, der sammelt überproportionale Vorteile.

Der Name für die Kompetenz, die an der Oberfläche der Blase arbeitet, ist Frontier Operations. Es ist nicht KI-Literacy -- das ist nur zu wissen, was ein Sprachmodell ist und wie man einen Prompt schreibt. Es ist auch nicht Prompt Engineering -- das ist eine Technik innerhalb einer Komponente. Und es ist nicht der vage Verweis auf "menschliches Urteilsvermögen", der viele Keynotes füllt.

Frontier Operations hat fünf Komponenten. Sie laufen gleichzeitig, integriert und kontinuierlich.

Die Fähigkeit, eine aktülle, präzise operationale Intuition darüber zu pflegen, wo die Mensch-Agent-Grenze für eine bestimmte Domäne liegt.

Das ist kein statisches Wissen. Es aktualisiert sich mit jedem Modell-Release, jedem Fähigkeitssprung. Opus 4.5 konnte nicht zuverlässig Informationen aus der Tiefe eines langen Dokuments abrufen. Drei Monate später erreicht Opus 4.6 eine Trefferquote von 93% bei 256.000 Tokens. Wer seine Grenz-Intuition gegen das November-Modell kalibriert hat und nicht aktualisiert hat, übervertraut oder unternutzt jetzt das Februar-Modell.

Beispiel Produktmanager: Einen Agenten eine Wettbewerbsanalyse entwerfen lassen -- aber wissen, dass derselbe Agent die politische Dynamik zwischen zwei Führungskräften übersehen wird, die er nie beobachtet hat. Also: Marktsizing und Feature-Vergleich an den Agenten, Stakeholder-Dynamik selbst bearbeiten.

Beispiel Marketing-Direktor: Agent produziert solide Kampagnen-Kopien und A/B-Test-Headlines. Aber Brand Voice driftet nach der dritten Version ab. Lösung: Agent für Ideation und erste Entwürfe, Brand Voice selbst editieren, nicht über Version zwei hinaus iterieren lassen.

Die Kompetenz liegt nicht darin, die Kalibrierung einmal zu haben -- sondern sie zu pflegen.

Die Fähigkeit, Arbeit so zu strukturieren, dass Übergänge zwischen menschlichen und Agent-Phasen sauber, verifizierbar und wiederherstellbar sind.

Das ist eine architektonische Kompetenz. Sie fragt: Wenn ich dieses Projekt in sieben Phasen zerlege -- welche drei sind voll Agent-ausführbar? Welche zwei brauchen Human-in-the-Loop? Welche zwei sind irreduzibel menschlich? Welche Artefakte werden zwischen den Phasen übergeben? Was muss ich an jeder Übergabe sehen, um zu wissen, dass alles auf Kurs ist?

Der Grund, warum das eine eigene Kompetenz ist: Die Antwort ändert sich mit jeder Capability-Verschiebung. Die Naht, die letztes Quartal richtig platziert war, ist dieses Quartal falsch.

Beispiel Software-Team: Ticket-Triage und Work-Routing gehen an den Agenten. Architektur-Entscheidungen bleiben beim Menschen. Die Grenze ist definiert durch spezifische Artefakte und Verifikations-Checks an der Naht.

Beispiel Beratungsprojekt: Research ist Agent-geführt mit menschlich definiertem Scope. Synthese ist menschlich geführt mit Agent-generierten Frameworks. Präsentation ist menschlich geführt mit Agent-generierten Slide-Entwürfen. Die Naht zwischen Research und Synthese ist ein strukturiertes Deliverable -- eine Fakten-Basis mit Quellenangaben, die der Mensch in wenigen Minuten prüfen kann.

Die Fähigkeit, ein akkurates, aktülles mentales Modell davon zu pflegen, wie Agenten versagen. Nicht dass sie versagen -- sondern die spezifische Textur und Form des Versagens auf dem aktüllen Fähigkeitsniveau.

Frühe Sprachmodelle versagten offensichtlich: zerstückelter Text, falsche Fakten, inkohärentes Reasoning. Aktülle Frontier-Modelle versagen subtil: korrekt klingende Analyse auf einer missverstandenen Prämisse. Plausibler Code, der den Happy Path handhabt und an Edge Cases bricht. Research-Zusammenfassungen, die zu 98% akkurat sind, während die restlichen 2% selbstbewusst fabriziert sind.

Die Kompetenz ist nicht "sei skeptisch gegenüber KI-Output". Das ist wie zu sagen, die Kompetenz eines Chirurgen sei "sei vorsichtig". Die Kompetenz ist ein differenziertes Failure Model: Für Aufgabentyp A ist der Fehlermodus X, und hier prüft man darauf. Für Aufgabentyp B ist der Fehlermodus Y, mit einer anderen Prüfung.

Beispiel Unternehmensjurist: Agent beim Vertragsprüfung fängt Boilerplate-Probleme, übersieht aber nicht-standardmässige Kündigungsklauseln oder die Wechselwirkung zwischen einer Haftungsbegrenzung und einem Nachtrag. Failure Model: Boilerplate-Scan vertrauen, Querverweise zwischen Haftungsbestimmungen manüll prüfen.

Beispiel Data Scientist: Agent generiert zuverlässig Pandas-Transformationen und Standard-Statistik-Tests, produziert aber Unsinn bei Daten mit gemischten Formaten oder impliziten Nullwerten. Failure Model: Datenbereinigungsschritte verifizieren, nachgelagerter Analyse vertrauen, wenn die Bereinigung korrekt ist.

Die Fähigkeit, vernünftige kurzfristige Vorhersagen darüber zu treffen, wohin sich die Blasen-Grenze als nächstes bewegt, und Lern- und Workflow-Investitionen entsprechend zu tätigen.

Das ist keine Zukunftsvorhersage über KI. Es ist das Lesen der Trajektorie, gut genug für sechs bis zwölf Monate.

Denk daran wie ein Surfer, der die Wellen liest. Er sagt nicht voraus, wie die nächste Welle genau aussieht. Aber er liest das Meer, versteht, wie der Boden die Wellen an dieser Stelle formt, und positioniert sich dort, wo die nächste reitbare Welle am wahrscheinlichsten entsteht.

Beispiel Anfang 2025: Wer die Trajektorie von Coding-Agenten beobachtet hat -- 30 Minuten autonome Ausdauer, dann rasante Skalierung -- und daraufhin in Code-Review und Spezifikations-Skills investiert hat statt in reines Coding, lag richtig.

Beispiel UX-Researcher: Agenten werden besser in Survey-Design und qualitativer Kodierung. Die kluge Investition: Interpretive Synthesis -- die Fähigkeit, kodierte Daten in Produkt-Insights zu verwandeln. Die Kodierung wandert in die Blase. Das "So What" der Kodierung ist, wo die neue Oberfläche liegt.

Die Fähigkeit, hochwertige Entscheidungen darüber zu treffen, wohin menschliche Aufmerksamkeit fliesst -- die knappste Ressource in einer agenten-reichen Umgebung.

McKinsey beschreibt bereits Szenarien mit zwei bis fünf Menschen, die 50 bis 100 Agenten supervisen. Bei diesem Verhältnis wird die Mathematik der Aufmerksamkeit sehr klar: Bei 100 Streams von Agent-Output und acht Stunden am Tag kannst du nicht alles in derselben Tiefe prüfen.

Beispiel Engineering Manager:

Was schlecht aussieht: Alles in derselben Tiefe prüfen (Bottleneck und Burnout) oder gar nichts prüfen (nur möglich in sehr speziellen Dark-Factory-Szenarien).

Die Top 1% nutzen KI rückwärts. Sie prompten nicht, um Antworten zu bekommen. Sie nutzen KI, um ihr Denken zu trainieren und ihren Verstand zu schärfen.

Vier Kategorien von Arbeit, die du sofort an KI delegieren kannst:

Die Regel: DRAG nur für Zone 1 anwenden -- Aufgaben mit begrenztem Payoff. Für Zone 2 -- Aufgaben mit unbegrenztem Payoff wie Kundeninteraktionen, Produktdesign, Preisstrategie -- bringst du dein volles menschliches Urteil ein.

Der entscheidende Perspektivwechsel: Für Informations-Aufgaben nutze KI, um Reibung zu entfernen. Für Transformations-Aufgaben nutze KI, um Reibung hinzuzufügen.

Wie Progressive Overload im Fitnessstudio -- aber für den Geist:

KI als Spotting-Partner, nicht als Rollstuhl für den Geist. Wenn du in einem Rollstuhl sitzt, obwohl du laufen kannst, hören deine Beine irgendwann auf zu funktionieren. Atrophie.

Die Organisationsstruktur der Vor-KI-Ära nimmt an, dass Output mit Kopfzahl skaliert. Mit Frontier Operations invertierst du das: Output skaliert mit Leverage, und Leverage skaliert damit, wie gut eine kleine Anzahl Menschen an der Grenze operiert.

Eine einzelne Person mit starken Frontier-Operations-Skills, die mehrere Agent-Workflows über eine Domäne betreibt. Ihr Output sieht aus wie das, was ein fünf- bis zehnköpfiges Team vor ein paar Jahren produziert hat. Nicht weil sie härter arbeitet, sondern weil sie kontinuierlich delegiert und intelligent verifiziert.

Ein kleines Team: Eine Person mit tiefen Frontier-Operations-Skills, einige mit sich entwickelnden Skills, einige Spezialisten, deren Domänen-Expertise unersetzlich ist. Der Frontier Operator setzt die Nähte für das Team, pflegt die Failure Models, kalibriert die Aufmerksamkeitsverteilung. Sie shippen im Tempo eines 20-köpfigen Teams.

Tracke, wo dein Boundary Sense falsch lag. Tracke, wo Agenten dich überraschen. Die Überraschung ist das Signal. Wenn dein Agent dich in letzter Zeit nicht überrascht hat, operierst du definitiv nicht an der Grenze. Gib deinem Agent eine Aufgabe, die dich überraschen kann.

Schau dir an, wie dein Team Aufmerksamkeit über Agent-gestützte Arbeit verteilt. Prüft jeder alles in derselben Tiefe? Gibt es einen Bottleneck, der sich als Dü Diligence tarnt? Wenn dein Team dir nicht seine Philosophie der menschlichen Aufmerksamkeit artikulieren kann, hast du ein Problem.

Die Frage ist nicht "Nutzen wir KI?" Die Frage ist: "Haben wir jemanden, dessen Job es ist zu wissen, wo die sich entwickelnde KI-Agent-Mensch-Grenze liegt und wie wir unsere Workflows redesignen, wenn sie sich verschiebt?" Wenn du niemanden benennen kannst, überlässt du eine der folgenreichsten organisatorischen Fähigkeitsentscheidungen des Jahrzehnts dem Zufall.

Die Karrierebewegung von 2026 ist es, die Person in deiner Organisation zu werden, die in einen Raum voller panischer Führungskräfte gehen kann und mit genuiner Autorität sagt: "Ich habe das getestet. Hier ist, was KI in unserem tatsächlichen Workflow kann. Hier ist, was sie nicht kann. Hier ist der Implementierungsplan. Hier ist das Budget. Hier ist die Timeline."

Diese Person existiert in den meisten Organisationen nicht. Die Techniker verstehen die Modelle. Die Business-Leute verstehen die Workflows. Die Berater verstehen die Frameworks. Aber niemand bringt alle drei zusammen.

Die Lücke zwischen KI-Fähigkeit und gesellschaftlicher Verbreitung ist die grösste generationelle Chance, die irgendjemand in der Arbeitswelt sehen wird. Nicht weil KI irrelevant wäre -- sondern weil die Tools mächtiger sind, als die meisten verstehen, und weniger integriert, als die meisten glauben. Genau in dieser Lücke liegt dein Vorteil. Nutze ihn.