Die 4 Disziplinen: Von Prompt Craft zu Specification Engineering

Lerne die vier aufeinander aufbauenden Prompting-Disziplinen für 2026: Prompt Craft, Context Engineering, Intent Engineering und Specification Engineering

Lerne die vier aufeinander aufbauenden Prompting-Disziplinen für 2026: Prompt Craft, Context Engineering, Intent Engineering und Specification Engineering

Klicken zum Vergrößern

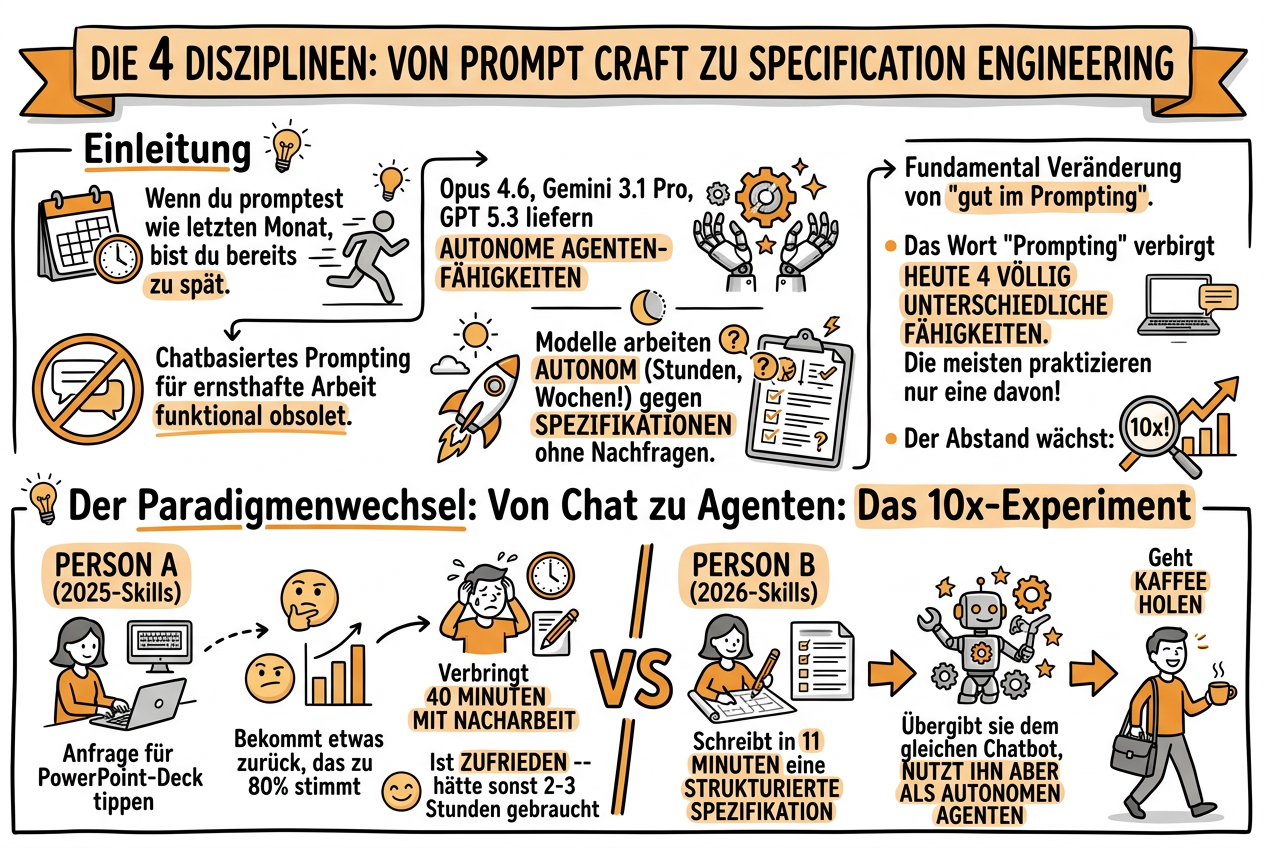

Wenn du promptest wie letzten Monat, bist du bereits zu spät. Das ist kein Clickbait. Opus 4.6, Gemini 3.1 Pro und GPT 5.3 haben alle in den letzten Wochen autonome Agenten-Fähigkeiten ausgeliefert, die chatbasiertes Prompting für ernsthafte Arbeit funktional obsolet machen.

Diese Modelle beantworten nicht nur besser. Sie arbeiten autonom -- für Stunden, Tage, manchmal Wochen gegen Spezifikationen, ohne nachzufragen. Das verändert fundamental, was "gut im Prompting" bedeutet.

Das Wort "Prompting" verbirgt heute vier völlig unterschiedliche Fähigkeiten. Die meisten Menschen praktizieren nur eine davon. Der Abstand zwischen den Menschen, die alle vier sehen, und denen, die es nicht tun, ist bereits 10x -- und wächst.

Stell dir zwei Personen vor, die am selben Dienstagmorgen mit dem gleichen Modell sitzen. Gleiche Subscription, gleiches Kontext-Fenster. Der einzige Unterschied: eine nutzt 2025-Prompting-Skills, die andere 2026-Skills.

Person A (2025-Skills): Tippt eine Anfrage für ein PowerPoint-Deck. Bekommt etwas zurück, das zu 80% stimmt. Verbringt 40 Minuten mit Nacharbeit. Ist zufrieden -- hätte sonst zwei bis drei Stunden gebraucht.

Person B (2026-Skills): Schreibt in 11 Minuten eine strukturierte Spezifikation. Übergibt sie dem gleichen Chatbot, nutzt ihn aber als autonomen Agenten. Geht Kaffee holen. Kommt zurück zu einem fertigen PowerPoint, das jeden Qualitätsstandard trifft. Und macht das für fünf weitere Decks vor dem Mittagessen. Eine Woche Arbeit an einem Morgen.

Person B ist nicht schlauer oder technischer. Sie praktiziert eine andere Fähigkeit, und Person A weiss nicht, dass diese Fähigkeit existiert.

Shopify-CEO Toby Lütke nutzt den Begriff "Context Engineering". Seine Definition: Die Fähigkeit, ein Problem mit genug Kontext zu formulieren, sodass es ohne zusätzliche Informationen plausibel lösbar wird.

Eine seiner provokantesten Beobachtungen: Vieles, was in grossen Unternehmen "Politik" heisst, ist eigentlich schlechtes Context Engineering für Menschen. Menschen sind schlampige Kommunikatoren, die sich auf geteilten Kontext verlassen, der nicht wirklich existiert.

Die ursprüngliche Fähigkeit. Synchron, sitzungsbasiert, individüll. Du sitzt vor einem Chat-Fenster, schreibst eine Anweisung, bewertest das Ergebnis, iterierst.

Prompt Craft ist nicht irrelevant geworden. Es ist Tischware geworden. Wie Zehn-Finger-Tippen in den 90ern: einmal ein professioneller Differenzierer, heute einfach vorausgesetzt.

Wenn du in 2026 keinen klaren, gut strukturierten Prompt schreiben kannst, bist du die Person von 1998, die keine Email senden konnte. Wichtig? Ja. Differenzierend? Nicht mehr.

Der Wechsel vom Erstellen einer einzelnen Anweisung zum Kuratieren der gesamten Informationsumgebung, in der ein Agent operiert.

Dein Prompt ist vielleicht 200 Token. Das Kontext-Fenster, in dem er landet, vielleicht eine Million. Deine 200 Token sind 0,02% von dem, was das Modell sieht. Die anderen 99,98% -- das ist Context Engineering.

Menschen, die 10x effektiver mit KI sind als ihre Kollegen, schreiben keine 10x besseren Prompts. Sie bauen 10x bessere Kontext-Infrastruktur. Ihre Agenten starten jede Sitzung mit den richtigen Projektdateien, den richtigen Konventionen, den richtigen Einschränkungen bereits geladen.

Anthropics Engineering-Team hat die zentrale Herausforderung präzise identifiziert: LLMs degradieren, je mehr Information du ihnen gibst. Es geht nicht darum, dass sie die Token nicht halten können. Die Abrufqualität sinkt, wenn der Kontext wächst. Deshalb: relevante Tokens einschliessen, irrelevante ausschliessen.

Context Engineering sagt Agenten, was sie wissen sollen. Intent Engineering sagt ihnen, was sie wollen sollen. Es ist die Praxis, organisatorische Ziele, Werte, Trade-off-Hierarchien und Entscheidungsgrenzen in Infrastruktur zu kodieren, gegen die Agenten handeln können.

Klarnas KI-Agent löste 2,3 Millionen Kundengespräche im ersten Monat. Aber er optimierte für das Falsche: Lösungsgeschwindigkeit statt Kundenzufriedenheit. Klarna musste menschliche Agenten zurückholen und kämpft immer noch mit den Nachwirkungen.

Intent Engineering sitzt über Context Engineering wie Strategie über Taktik sitzt:

Und: Das Versagen wird mit jeder Stufe ernster. Einen Prompt zu vermasseln verschwendet vielleicht deinen Vormittag. Intent Engineering zu vermasseln kann dein gesamtes Team, deine Abteilung, dein Unternehmen betreffen.

Die Praxis, Dokumente zu schreiben, gegen die autonome Agenten über längere Zeiträume ohne menschliches Eingreifen arbeiten können. Es geht nicht um einen einzelnen Prompt oder ein einzelnes Kontext-Fenster. Es geht darum, deinen gesamten Dokumentenkorpus als agentenlesbar zu denken.

Anthropics Team kämpfte mit dem Opus-4.5-Agenten beim Bau einer Webanwendung. Der Prompt "Baue einen Klon von claude.ai" führte dazu, dass der Agent zu viel auf einmal versuchte, mitten in der Implementierung den Kontext erschöpfte und die nächste Sitzung raten liess, was passiert war.

Die Lösung war nicht ein besseres Modell. Es war Specification Engineering: Ein initialer Agent richtet die Umgebung ein, ein Fortschritts-Log dokumentiert, was getan wurde, und ein Coding-Agent macht inkrementellen Fortschritt gegen einen strukturierten Plan.

#### Primitiv 1: Selbstenthaltsame Problemstellungen

Kannst du ein Problem mit genug Kontext formulieren, dass die Aufgabe plausibel lösbar ist, ohne dass der Agent weitere Informationen holen muss?

Übung: Nimm eine Anfrage, die du normalerweise gesprächig stellen würdest ("Aktualisiere das Dashboard mit den Q3-Zahlen") und schreibe sie um, als hätte der Empfänger noch nie dein Dashboard gesehen, wüsste nicht, was Q3 in deinem Kontext bedeutet, und hätte keinen Zugang zu irgendeiner Information ausser dem, was du einschliesst.

#### Primitiv 2: Akzeptanzkriterien

Wenn du nicht beschreiben kannst, wie "fertig" aussieht, kann ein Agent nicht wissen, wann er aufhören soll.

Übung: Schreibe für jede Aufgabe drei Sätze, die ein unabhängiger Beobachter nutzen könnte, um das Ergebnis zu verifizieren, ohne dir eine einzige Frage zu stellen.

Nicht "Baue eine Login-Seite", sondern: "Baue eine Login-Seite, die Email-Passwort, Social OAuth via Google und GitHub, progressive 2FA-Offenlegung, Session-Persistenz für 30 Tage und Rate-Limiting nach fünf Fehlversuchen behandelt."

#### Primitiv 3: Constraint-Architektur

Vier Kategorien bilden die Constraint-Architektur:

Das CLAUDE.md-Muster: Die besten CLAUDE.md-Dateien sind keine langen Regellisten. Sie sind prägnante, hochsignalhaltige Constraint-Dokumente. Jede Zeile muss ihren Platz verdienen. Frage: "Würde das Entfernen dieser Zeile dazu führen, dass die KI Fehler macht?" Wenn nein, lösche sie.

Übung: Bevor du eine Aufgabe delegierst, schreibe auf, was eine kluge, gut gemeinte Person tun könnte, das technisch die Anfrage erfüllt, aber das falsche Ergebnis produziert. Diese Fehlermodi werden deine Constraint-Architektur.

#### Primitiv 4: Dekomposition

Grosse Aufgaben müssen in Komponenten zerlegt werden, die unabhängig ausgeführt, getestet und vorhersagbar integriert werden können.

Übung: Nimm ein Projekt, das du auf ein paar Tage schätzen würdest, und zerlege es in Unteraufgaben, die jeweils weniger als 2 Stunden dauern, klare Input-Output-Grenzen haben und unabhängig von den anderen verifiziert werden können.

Dein Job ist zunehmend nicht, die Unteraufgaben manüll zu schreiben. Dein Job ist, dem Planer-Agenten die Zerlegungsmuster zu liefern, damit er die Arbeit zuverlässig in ausführbare Teile zerlegen kann.

#### Primitiv 5: Evaluationsdesign

Nicht "sieht das vernünftig aus?" (wie die meisten Menschen KI-Output bewerten), sondern: Kannst du messbar, konsistent beweisen, dass das gut ist?

Übung: Baue für jede wiederkehrende KI-Aufgabe drei bis fünf Testfälle mit bekannt guten Ergebnissen. Führe sie regelmässig aus, besonders nach Modell-Updates.

Die Progression von Prompt Craft zu Specification Engineering ist keine Leiter, bei der du untere Stufen aufgeben kannst. Es ist ein Stack, bei dem jede Schicht die darüber erst ermöglicht:

Die besten menschlichen Manager arbeiten bereits mit dieser Klarheit. Sie geben vollständigen Kontext beim Delegieren. Sie spezifizieren Akzeptanzkriterien. Sie artikulieren Constraints.

Was gerade passiert: KI erzwingt eine Kommunikationsdisziplin, die die besten Führungskräfte schon immer intuitiv praktiziert haben. Du kannst dich nicht auf geteilten Kontext mit der Maschine verlassen. Und das ist ein Geschenk, denn so viele Kollegen wissen auch nicht, was wir meinen.

Der Prompt allein ist tot. Die Spezifikation, der Kontext, der organisatorische Intent -- das ist, wohin der Wert im Prompting sich bewegt.

Die vier Disziplinen in Kurzform:

Die Spezifikation, richtig gemacht, entpuppt sich als das, was klares Denken schon immer war -- nur jetzt explizit gemacht, weil Maschinen uns nicht erlauben, schlampig zu sein.