Chief AI Officer und KI-Governance: Führung in der KI-Ära

Lektion 1: Warum jedes Unternehmen eine KI-Führungsrolle braucht

In den meisten Unternehmen passiert KI-Nutzung heute unkontrolliert. Fachabteilungen experimentieren mit ChatGPT, das Marketing nutzt Bildgeneratoren, die IT-Abteilung testet Copilot — und niemand hat den Überblick, welche KI-Systeme im Einsatz sind, welche Daten sie verarbeiten und welche Risiken damit verbunden sind. Diese "Schatten-KI" ist das KI-Äquivalent der Schatten-IT, die Unternehmen schon vor einem Jahrzehnt vor grosse Herausforderungen stellte. Nur sind die Risiken diesmal deutlich höher.

Der regulatorische Druck verstärkt die Dringlichkeit massiv. Am 2. August 2026 treten die vollständigen Anforderungen des EU AI Act in Kraft. Ab diesem Stichtag müssen Unternehmen nachweisen können, welche KI-Systeme sie einsetzen, wie diese klassifiziert sind und welche Risikominimierungsmassnahmen ergriffen wurden. Bei Verstössen drohen Bussgelder von bis zu 35 Millionen Euro oder 7 Prozent des weltweiten Jahresumsatzes — je nachdem, welcher Betrag höher ist. Diese Zahlen übertreffen sogar die DSGVO-Sanktionen und zeigen, wie ernst die EU das Thema nimmt.

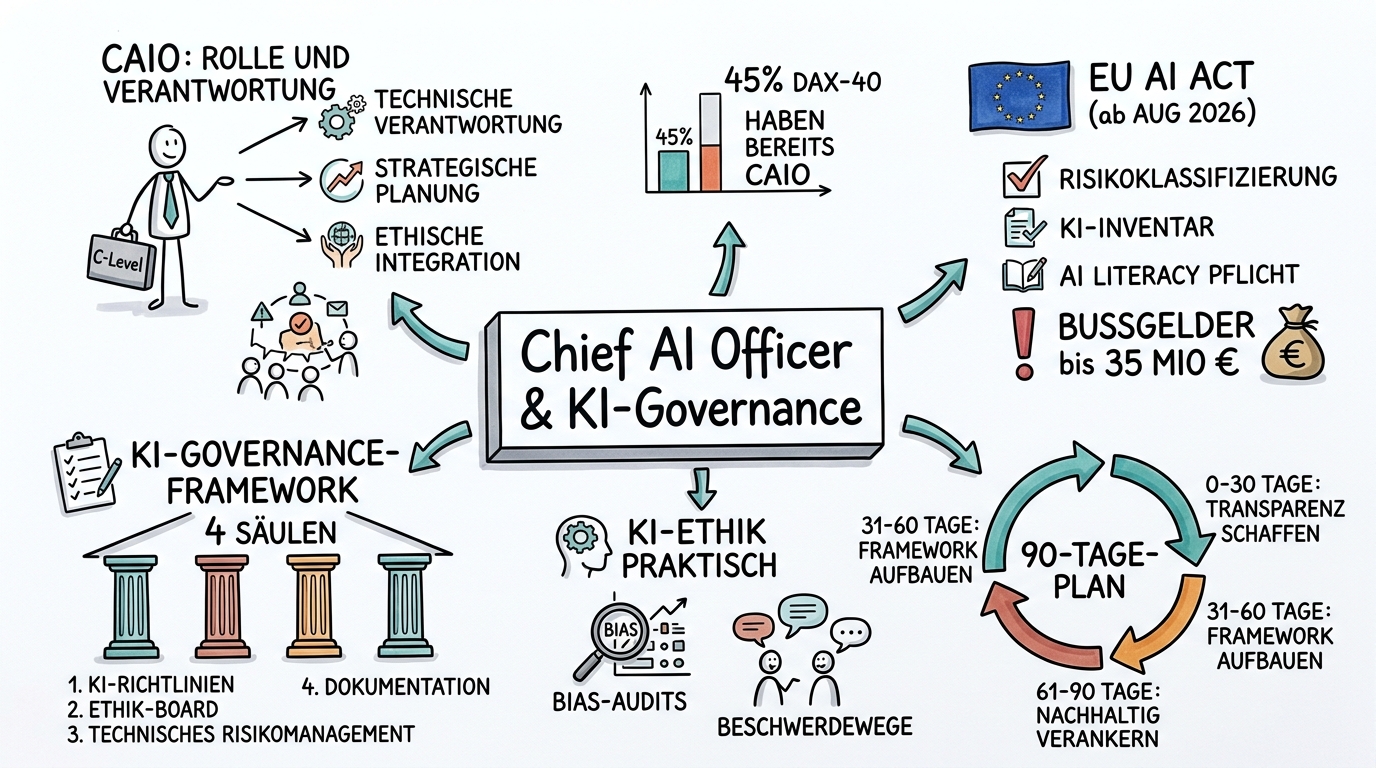

Die Antwort vieler fortschrittlicher Organisationen auf diese Herausforderung ist die Schaffung einer dezidierten Führungsrolle: des Chief AI Officer, kurz CAIO. Diese Position bündelt die Verantwortung für KI-Strategie, KI-Governance und KI-Ethik auf C-Level-Ebene. Der CAIO ist nicht einfach ein umbenannter CTO oder CDO, sondern eine eigenständige Rolle, die an der Schnittstelle von Technologie, Geschäftsstrategie und Regulierung arbeitet.

Laut aktüllen Erhebungen haben bislang nur 7 bis 15 Prozent der DAX-40-Unternehmen eine formelle CAIO-Rolle auf C-Level etabliert — SAP ist mit Dr. Philipp Herzig als Chief AI Officer, der direkt an den CEO berichtet, ein Vorreiter. Global liegt die Quote bei 38,5 Prozent, und 73 Prozent der Fortune-500-Unternehmen planen, bis Ende 2026 einen CAIO zu ernennen. Unternehmen mit CAIO erzielen nachweislich 45 Prozent mehr ROI bei KI-Projekten. Im Mittelstand liegt die Quote noch deutlich niedriger, doch die EU-AI-Act-Anforderungen werden auch hier einen Schub auslösen. Denn die Schulungspflicht nach Artikel 4 (AI Literacy) gilt bereits seit dem 2. Februar 2025 und betrifft jedes Unternehmen, das KI einsetzt — unabhängig von der Grösse.

Lektion 2: Das Rollenprofil des Chief AI Officer

Der Chief AI Officer vereint drei Kompetenzfelder, die traditionell auf verschiedene Abteilungen verteilt sind. Erstens die technische Kompetenz: Der CAIO muss nicht selbst Modelle trainieren können, aber er muss verstehen, wie verschiedene KI-Architekturen funktionieren, welche Daten sie benötigen und wo ihre Grenzen liegen. Nur so kann er fundierte Entscheidungen über den Einsatz bestimmter Systeme treffen und Risiken realistisch einschätzen.

Zweitens die strategische Geschäftskompetenz: Der CAIO identifiziert Use Cases, die echten geschäftlichen Mehrwert schaffen, priorisiert KI-Initiativen nach ROI und strategischer Bedeutung und stellt sicher, dass KI-Investitionen mit den Unternehmenszielen aligniert sind. Er verhindert sowohl die "KI um der KI willen"-Falle als auch die lahmende Überanalyse, die viele Unternehmen in der Pilothölle gefangen hält.

Drittens die Governance- und Ethikkompetenz: Der CAIO verantwortet die Einhaltung regulatorischer Anforderungen, etabliert ethische Leitplanken für den KI-Einsatz und baut ein Risikomanagement auf, das der Dynamik der Technologie gerecht wird. Er stellt sicher, dass das Unternehmen nicht nur die Mindestanforderungen des EU AI Act erfüllt, sondern verantwortungsvolle KI als Wettbewerbsvorteil nutzt.

Die Reporting-Linie des CAIO ist ein wichtiger Indikator für den Stellenwert, den ein Unternehmen dem Thema einräumt. In fortschrittlichen Organisationen berichtet der CAIO direkt an den CEO oder den Vorstand. Eine Einordnung unter den CTO oder CIO — obwohl in der Praxis noch häufig — signalisiert dagegen, dass KI primär als IT-Thema betrachtet wird. Die erfolgreichsten Unternehmen positionieren den CAIO als Brückenbauer zwischen allen Geschäftsbereichen, der sowohl in der Technologie als auch im Business zuhause ist.

Lektion 3: KI-Governance-Framework aufbauen

Ein KI-Governance-Framework ist das Regelwerk, das festlegt, wie ein Unternehmen KI verantwortungsvoll entwickelt, einsetzt und überwacht. Es ist vergleichbar mit dem Datenschutz-Management-System, das die meisten Unternehmen im Zuge der DSGVO aufgebaut haben — nur dass es spezifisch auf die Besonderheiten künstlicher Intelligenz zugeschnitten ist.

Das Framework besteht aus vier Säulen. Die erste Säule sind die KI-Richtlinien und Policies. Diese definieren, wer im Unternehmen KI-Systeme beschaffen und einsetzen darf, welche Genehmigungsprozesse durchlaufen werden müssen und welche Mindeststandards für Datenschutz, Sicherheit und Transparenz gelten. Eine gute KI-Policy ist konkret genug, um als Handlungsanleitung zu dienen, aber flexibel genug, um mit der rasanten technologischen Entwicklung Schritt zu halten.

Die zweite Säule ist das KI-Ethik-Board. Dieses Gremium bewertet geplante KI-Einsätze aus ethischer Perspektive und stellt sicher, dass Fairness, Transparenz und Nicht-Diskriminierung gewahrt werden. Es besteht idealerweise aus einer diversen Gruppe, die neben Technikern auch Juristen, Ethiker, Betriebsräte und Fachbereichsvertreter einschliesst. Das Board trifft keine Technologieentscheidungen, sondern stellt die richtigen Fragen: Welche Personengruppen sind von diesem KI-System betroffen? Welche Verzerrungen könnten in den Trainingsdaten stecken? Wie können Betroffene eine Entscheidung der KI anfechten?

Die dritte Säule ist das technische Risikomanagement. Hier werden Prozesse für die kontinuierliche Überwachung von KI-Systemen definiert: Monitoring der Modellperformance, Erkennung von Drift, regelmässige Audits und Penetrationstests. Unternehmen mit einer etablierten KI-Governance weisen nachweislich 60 Prozent weniger Compliance-Verstösse auf als solche ohne strukturiertes Framework.

Die vierte Säule ist die Dokumentation und Nachweisführung. Der EU AI Act verlangt eine lückenlose Dokumentation des gesamten Lebenszyklus eines KI-Systems — von der Entwicklung über den Einsatz bis zur Ausserbetriebnahme. Ein gut aufgesetztes Governance-Framework automatisiert diese Dokumentation so weit wie möglich und macht Compliance zu einem natürlichen Nebenprodukt des regulären Betriebs.

Lektion 4: EU AI Act Compliance — was bis August 2026 passieren muss

Der EU AI Act ist die weltweit erste umfassende KI-Regulierung und wird häufig als "DSGVO für KI" bezeichnet. Diese Analogie ist hilfreich, weil viele Unternehmen den Aufwand der DSGVO-Umsetzung noch in Erinnerung haben — und sich diesmal frühzeitiger vorbereiten sollten. Die Anforderungen treten gestaffelt in Kraft, wobei die wichtigsten Fristen für die meisten Unternehmen im August 2026 liegen.

Der Kern des EU AI Act ist ein risikobasierter Ansatz. KI-Systeme werden in vier Risikoklassen eingeteilt: unannehmbares Risiko (verboten), hohes Risiko (strenge Auflagen), begrenztes Risiko (Transparenzpflichten) und minimales Risiko (keine spezifischen Anforderungen). Für Unternehmen ist es entscheidend, jedes eingesetzte KI-System korrekt zu klassifizieren, denn die Pflichten unterscheiden sich erheblich.

Besonders relevant für die meisten Unternehmen ist Artikel 4 des EU AI Act, der eine allgemeine KI-Kompetenzpflicht ("AI Literacy") definiert. Jedes Unternehmen, das KI-Systeme einsetzt oder bereitstellt, muss sicherstellen, dass seine Mitarbeiter über ausreichende KI-Kompetenz verfügen. Das betrifft nicht nur die IT-Abteilung, sondern alle Beschäftigten, die mit KI-Systemen arbeiten — vom Marketing-Manager, der ChatGPT nutzt, bis zur Personalleiterin, die KI-gestütztes Bewerber-Screening einsetzt.

Die praktische Umsetzung erfordert ein systematisches Vorgehen. Im ersten Schritt erstellt das Unternehmen ein vollständiges KI-Inventar: Welche KI-Systeme sind im Einsatz? Wer nutzt sie? Welche Daten verarbeiten sie? Im zweiten Schritt erfolgt die Risikoklassifizierung jedes Systems. Im dritten Schritt werden die erforderlichen Massnahmen abgeleitet — von der einfachen Dokumentation bei minimalem Risiko bis zum vollständigen Konformitätsbewertungsverfahren bei Hochrisiko-KI. Im vierten Schritt wird ein fortlaufendes Monitoring etabliert, das sicherstellt, dass neue KI-Systeme den Governance-Prozess durchlaufen, bevor sie in Betrieb genommen werden.

Lektion 5: Das KI-Inventar — Transparenz als Grundlage

Bevor ein Unternehmen KI regulieren kann, muss es wissen, welche KI es überhaupt nutzt. Das klingt trivial, ist in der Praxis aber eine der grössten Herausforderungen. Denn KI steckt heute in unzähligen Produkten und Diensten, ohne dass die Nutzer sich dessen bewusst sind. Die Autokorrektur im E-Mail-Programm, die Spam-Filter, die Produktempfehlungen im Einkaufsportal, die Spracherkennung im Konferenzsystem — all das sind KI-Systeme, die im Sinne des EU AI Act erfasst und bewertet werden müssen.

Ein systematisches KI-Inventar beginnt mit einer unternehmensweiten Bestandsaufnahme. Dabei werden alle Abteilungen befragt, welche Software-Tools sie einsetzen, und diese Tools werden daraufhin geprüft, ob sie KI-Komponenten enthalten. Die Erfahrung zeigt, dass Unternehmen bei dieser Bestandsaufnahme regelmassig überrascht werden: Die tatsächliche Zahl der eingesetzten KI-Systeme liegt typischerweise drei- bis fünfmal höher als die geschätzte Zahl.

Für jedes identifizierte KI-System werden dann strukturierte Informationen erfasst: Name und Version des Systems, Anbieter, Einsatzzweck, verarbeitete Datenarten, betroffene Personengruppen, Risikoklassifizierung nach EU AI Act, verantwortliche Abteilung und Ansprechpartner. Diese Informationen bilden die Grundlage für alle weiteren Governance-Massnahmen.

Die grösste Gefahr liegt in der Einmalpflege. Ein KI-Inventar, das nach der Ersterfassung nicht mehr aktualisiert wird, verliert schnell seinen Wert. Neue Tools werden täglich eingeführt, bestehende Systeme erhalten Updates mit neuen KI-Features, Mitarbeiter experimentieren mit neuen Anbietern. Ein lebendiges KI-Inventar erfordert daher einen Prozess, der neue KI-Einsätze automatisch erfasst — sei es durch Integration in den IT-Beschaffungsprozess, durch regelmässige Abteilungsumfragen oder durch technische Monitoring-Lösungen, die KI-API-Aufrufe im Netzwerk erkennen.

Lektion 6: KI-Ethik in der Praxis umsetzen

KI-Ethik ist kein abstraktes Philosophieseminar, sondern hat ganz konkrete geschäftliche Konsequenzen. Wenn ein KI-System bei der Kreditvergabe bestimmte Bevölkerungsgruppen systematisch benachteiligt, drohen nicht nur Bussgelder, sondern auch massive Reputationsschäden. Wenn ein Chatbot halluziniert und falsche medizinische Ratschläge gibt, kann das im schlimmsten Fall Menschenleben gefährden. KI-Ethik ist daher kein "Nice to have", sondern ein integraler Bestandteil des Risikomanagements.

Der erste Schritt zur praktischen Umsetzung ist die Definition klarer ethischer Grundsätze für den KI-Einsatz im eigenen Unternehmen. Diese Grundsätze orientieren sich typischerweise an international anerkannten Frameworks wie den OECD AI Principles oder den EU-Ethikleitlinien für vertrauenswürdige KI. Wichtig ist, dass die Grundsätze nicht als abstrakte Werterklärung formuliert werden, sondern als konkrete, überprüfbare Kriterien. Statt "Wir setzen KI fair ein" besser: "Jedes KI-System, das Entscheidungen über Personen trifft, wird vor der Inbetriebnahme einem Bias-Audit unterzogen."

Bias-Audits sind eines der wirkungsvollsten Instrumente der praktischen KI-Ethik. Dabei werden KI-Systeme systematisch daraufhin getestet, ob sie bestimmte Gruppen benachteiligen — sei es aufgrund von Geschlecht, Alter, Herkunft oder anderen geschützten Merkmalen. Die Testergebnisse werden dokumentiert und führen bei Auffälligkeiten zu konkreten Korrekturmassnahmen: Anpassung der Trainingsdaten, Modifikation des Algorithmus oder im Extremfall Verzicht auf den Einsatz.

Ein weiterer praktischer Aspekt ist die Gestaltung von Beschwerdewegen. Der EU AI Act verlangt, dass Personen, die von KI-Entscheidungen betroffen sind, das Recht haben, eine menschliche Überprüfung zu verlangen. Unternehmen müssen daher klare Prozesse etablieren, wie Betroffene eine Beschwerde einreichen können, wer diese prüft und innerhalb welcher Frist eine Antwort erfolgt. Diese Transparenz stärkt das Vertrauen in den verantwortungsvollen KI-Einsatz und kann sogar zum Differenzierungsmerkmal im Wettbewerb werden.

Lektion 7: KI-Strategie entwickeln und umsetzen

Eine KI-Strategie ist mehr als eine Liste von Use Cases. Sie definiert, wie KI das Unternehmen in den nächsten drei bis fünf Jahren transformieren soll, welche Investitionen dafür nötig sind und wie der Erfolg gemessen wird. Ohne eine solche Strategie bleibt KI ein Sammelsurium isolierter Experimente, die selten über das Pilotstadium hinauskommen.

Die Entwicklung einer wirksamen KI-Strategie beginnt mit einer ehrlichen Bestandsaufnahme des KI-Reifegrads. Wo steht das Unternehmen heute? Sind die Datengrundlagen vorhanden? Verfügen die Mitarbeiter über die notwendigen Kompetenzen? Ist die IT-Infrastruktur bereit? Ein bewährtes Instrument dafür ist das KI-Reifegrad-Modell, das fünf Stufen unterscheidet: von "explorativ" (einzelne Experimente) über "opportunistisch" (punktülle Use Cases) und "systematisch" (koordinierte KI-Initiativen) bis "transformativ" (KI als Kernbestandteil des Geschäftsmodells) und schliesslich "intelligent" (selbstoptimierende, KI-native Organisation).

Die meisten mittelständischen Unternehmen befinden sich 2026 auf Stufe zwei oder drei. Das ist kein Grund zur Scham, sondern ein realistischer Ausgangspunkt für die strategische Planung. Der Schlüssel liegt darin, nicht auf Stufe fünf springen zu wollen, sondern die nächste Stufe gezielt anzustreben. Für ein Unternehmen auf Stufe zwei bedeutet das: eine zentrale KI-Verantwortung schaffen, drei bis fünf priorisierte Use Cases identifizieren und ein Kompetenzaufbauprogramm starten.

Die Priorisierung der Use Cases folgt idealerweise einer Matrix, die Geschäftswert (Umsatzsteigerung, Kostensenkung, Risikominimierung) gegen Umsetzbarkeit (Datenverfügbarkeit, technische Komplexität, regulatorische Hürden) abträgt. Die besten Kandidaten für den Start sind Use Cases mit hohem Geschäftswert und niedriger Komplexität — die berühmten "Quick Wins", die frühe Erfolge liefern und die Organisation für ambitioesere Projekte motivieren.

Lektion 8: Der 90-Tage-Plan für KI-Governance im Unternehmen

Theorie ist wichtig, aber ohne einen konkreten Umsetzungsplan bleibt KI-Governance ein Papiertiger. Der folgende 90-Tage-Plan gibt Führungskräften eine Schritt-für-Schritt-Anleitung, um KI-Governance im eigenen Unternehmen zu etablieren — unabhängig davon, ob das Unternehmen 50 oder 5.000 Mitarbeiter hat.

In den ersten 30 Tagen liegt der Fokus auf Transparenz und Bestandsaufnahme. Das Team führt das KI-Inventar durch, identifiziert alle eingesetzten KI-Systeme und nimmt eine erste Risikoklassifizierung vor. Parallel wird ein Kernteam aus drei bis fünf Personen gebildet, das die KI-Governance-Initiative verantwortet. Dieses Team muss nicht aus KI-Experten bestehen — wichtiger sind Repräsentanten aus verschiedenen Geschäftsbereichen, die den praktischen Einsatz von KI im Unternehmen kennen. Am Ende des ersten Monats liegt ein vollständiges KI-Inventar vor und die grössten Risiken sind identifiziert.

Die Tage 31 bis 60 widmen sich dem Aufbau des Frameworks. Jetzt werden die KI-Richtlinien formuliert, der Genehmigungsprozess für neue KI-Systeme definiert und das AI-Literacy-Schulungsprogramm gestartet. Letzteres ist besonders wichtig, da der EU AI Act eine allgemeine KI-Kompetenz aller Mitarbeiter verlangt, die mit KI arbeiten. Die Schulungen sollten praxisnah sein und konkret auf die im Unternehmen eingesetzten Systeme eingehen — abstrakte KI-Theorie hilft im Tagesgeschäft wenig.

In der dritten Phase, den Tagen 61 bis 90, geht es um Verankerung und Nachhaltigkeit. Das KI-Governance-Framework wird offiziell in Kraft gesetzt, die Verantwortlichkeiten sind klar zugewiesen und die ersten KI-Systeme haben den neuen Genehmigungsprozess durchlaufen. Ein monatlicher KI-Governance-Report an die Geschäftsführung stellt sicher, dass das Thema auf der Agenda bleibt. Und schliesslich wird ein Feedback-Mechanismus etabliert, der es Mitarbeitern ermöglicht, Bedenken oder Verbesserungsvorschläge rund um den KI-Einsatz einzubringen.

Der häufigste Fehler bei der Umsetzung ist Perfektionismus. Ein KI-Governance-Framework muss nicht von Anfang an perfekt sein — es muss existieren und kontinuierlich verbessert werden. Unternehmen, die auf das perfekte Framework warten, werden vom EU-AI-Act-Stichtag überrascht. Unternehmen, die mit einem pragmatischen Minimum starten und iterativ verbessern, sind rechtzeitig compliant und bauen gleichzeitig eine Kultur der verantwortungsvollen KI-Nutzung auf.