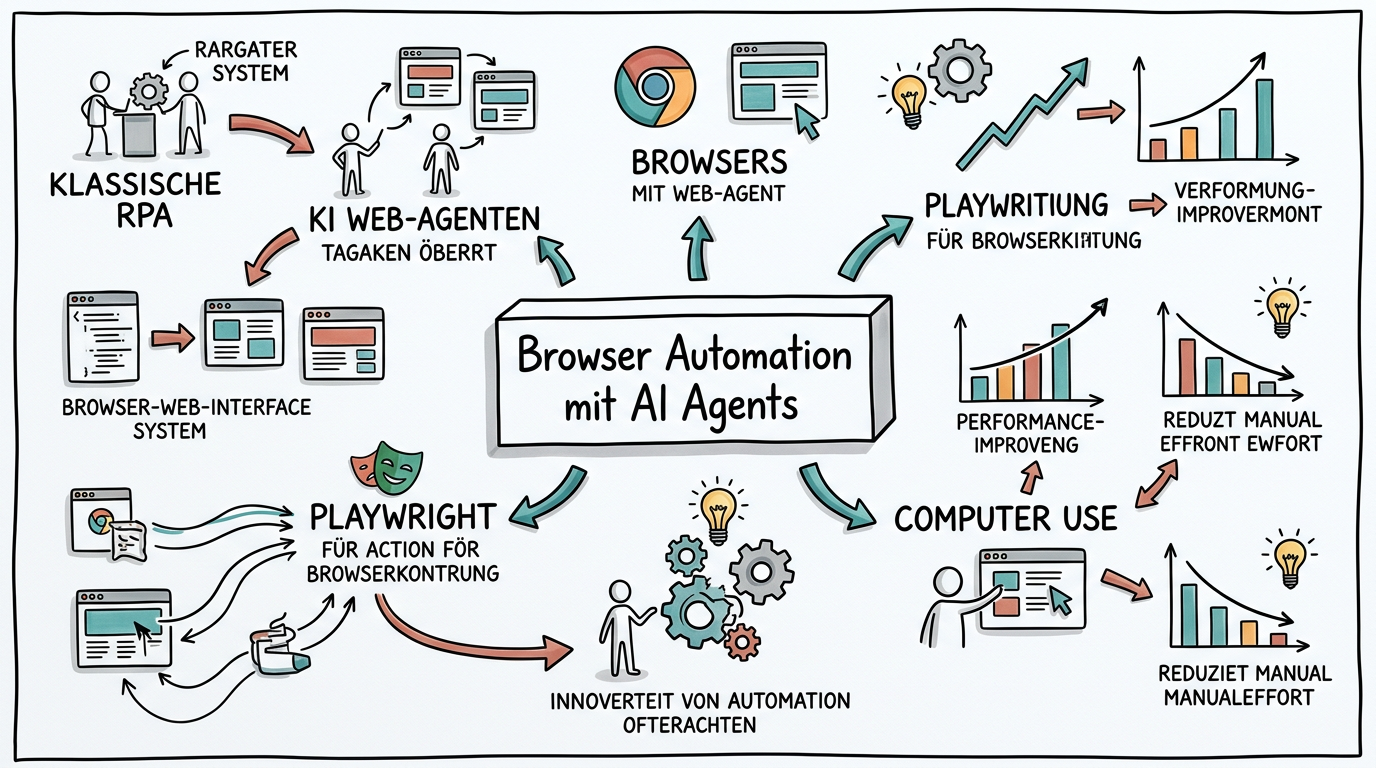

Browser Automation mit AI Agents: Von RPA zu intelligenten Web-Agenten

Klassische Browser-Automatisierung ist starr und fehleranfällig. KI-gestützte Web-Agenten verändern das fundamental: Sie verstehen Webseiten wie ein Mensch, passen sich an Änderungen an und treffen eigene Entscheidungen. In diesem Kurs lernst du, wie du AI-Browser-Agenten für deinen Berufsalltag einsetzt.

Lektion 1: Warum klassische Automatisierung an ihre Grenzen stösst

Das Problem mit RPA und Makros

Robotic Process Automation (RPA) war jahrelang der Standard für Browser-Automatisierung. Tools wie UiPath, Automation Anywhere oder einfache Selenium-Scripts haben wiederkehrende Aufgaben automatisiert. Aber sie haben ein fundamentales Problem:

Sie sind dumm. Sie klicken auf Koordinaten, suchen nach exakten CSS-Selektoren und brechen zusammen, sobald sich ein Button um 5 Pixel verschiebt.

Typische Probleme klassischer RPA:

- Fragile Selektoren: Eine kleine Änderung im Website-Code bricht den gesamten Workflow

- Keine Fehlerbehandlung: Unerwartete Popups oder Cookie-Banner stoppen alles

- Kein Verständnis: Das Tool weiss nicht, WAS es tut — es führt nur Befehle aus

- Hohe Wartungskosten: 30-40% der Arbeitszeit gehen in die Pflege bestehender Automationen

Die KI-Revolution: Agenten, die sehen und verstehen

AI Browser Agents lösen diese Probleme, weil sie:

- Webseiten visüll verstehen (wie ein Mensch, der auf den Bildschirm schaut)

- Sich selbst korrigieren (wenn ein Element nicht gefunden wird, suchen sie Alternativen)

- Kontext verstehen ("Melde mich an" vs. "Registriere ein neues Konto" — der Agent versteht den Unterschied)

- Natürliche Sprache als Anweisung akzeptieren (kein Code nötig)

Lektion 2: Die wichtigsten AI Browser Automation Tools

Anthropic Computer Use

Anthropics "Computer Use" ist die erste Funktion, die KI direkt den Computer bedienen lässt — inklusive Browser. Claude sieht den Bildschirm, bewegt die Maus und tippt auf der Tastatur.

Stärken:

- Natürliche Sprachsteuerung

- Versteht komplexe mehrstufige Aufgaben

- Funktioniert mit jeder Webseite (keine Integration nötig)

Einschränkungen:

- Langsamer als spezialisierte Tools

- Benötigt Claude Max oder API-Zugang

Playwright + AI (Open Source)

Playwright ist Microsofts Browser-Automatisierungsbibliothek. In Kombination mit KI entsteht ein mäcthtiges Werkzeug:

- MCP-Server für Playwright: Claude steuert den Browser über MCP

- Screenshot-Analyse: Die KI sieht, was auf der Seite passiert

- Selbstheilende Selektoren: Wenn ein Element sich ändert, findet die KI es trotzdem

Browser Use (Open Source)

Ein spezialisiertes Open-Source-Framework für AI Browser Agents:

- Unterstützt Claude, GPT-4 und lokale Modelle

- Vision-basierte Navigation (die KI "sieht" die Webseite)

- Automatische Cookie-Banner-Behandlung

- Session-Management für lange Aufgaben

Weitere Tools im Überblick

| Tool | Typ | Stärke | Zielgruppe |

|---|

| Claude Computer Use | KI-nativ | Universell, natürliche Sprache | Fortgeschrittene |

| Playwright + MCP | Open Source | Schnell, präzise, anpassbar | Entwickler |

| Browser Use | Open Source | Vision-basiert, selbstheilend | Techniker |

| Browserbase | Cloud-Service | Skalierbar, API-first | Unternehmen |

| MultiOn | SaaS | Einfach, keine Einrichtung | Einsteiger |

Lektion 3: Praktische Anwendungsfälle

Use Case 1: Wettbewerber-Monitoring

Aufgabe: Täglich die Preise von 10 Wettbewerbern prüfen und Änderungen melden.

Klassisch (RPA): 10 separate Scripts, die bei jeder Website-Änderung gewartet werden müssen.

Mit AI Agent: Ein einziger Prompt: "Besuche diese 10 Websites, finde die aktüllen Preise für Produkt X, vergleiche mit gestern und melde Änderungen."

Der Agent:

- Navigiert zu jeder Website

- Findet die Preisinformation (auch wenn sie anders dargestellt wird)

- Erkennt Sonderangebote, Rabattcodes, Staffelpreise

- Erstellt einen strukturierten Vergleichsbericht

Use Case 2: Lead-Recherche

Aufgabe: 50 Unternehmen aus einer Branche finden und Kontaktdaten sammeln.

Der AI Agent:

- Sucht auf LinkedIn, Handelsregister, Firmenwebsites

- Sammelt: Name, Position, E-Mail, Telefon, Firmengrösse

- Bewertet die Lead-Qualität (passt zum Ideal Customer Profile?)

- Trägt alles in dein CRM ein (via MCP)

Use Case 3: Formulare automatisch ausfüllen

Aufgabe: Bewerber-Daten aus CVs in ein Online-Formular übertragen.

Der AI Agent:

- Liest den CV (PDF oder Bild)

- Extrahiert relevante Informationen

- Öffnet das Bewerbungsformular

- Füllt alle Felder korrekt aus

- Prüft die Eingaben visüll

- Klickt auf "Absenden"

Use Case 4: Social Media Monitoring

Aufgabe: Relevante Beiträge auf LinkedIn, Twitter und Fachforen finden.

Der AI Agent durchsucht täglich definierte Quellen, filtert nach Relevanz und erstellt eine Zusammenfassung: "3 neue Diskussionen zum Thema KI im Mittelstand, 1 potenzielle Partnerschaft, 2 negative Erwahnungen deiner Marke."

Lektion 4: Anti-Detection und ethische Grenzen

Das Problem: Websites wehren sich

Viele Websites erkennen und blockieren automatisierte Zugriffe:

- CAPTCHAs (Bilderrätsel, Textverzerrungen)

- Rate Limiting (zu viele Anfragen in kurzer Zeit)

- Bot-Detection (Mausbewegungen, Browser-Fingerprint)

- IP-Sperren (nach verdächtigen Mustern)

Technische Lösungsansätze

- Menschenähnliches Verhalten: Zufällige Pausen, natürliche Mausbewegungen

- Browser-Profile: Verschiedene Browser-Fingerprints verwenden

- Proxy-Rotation: IP-Adressen regelmässig wechseln

- Headless vs. Headed: Manche Sites erkennen headless Browser

Ethische Leitlinien

Erlaubt und sinnvoll:

- Eigene Daten automatisiert verarbeiten

- Öffentlich zugängliche Informationen sammeln (im Rahmen der Nutzungsbedingungen)

- Eigene Konten automatisiert bedienen

- Testen der eigenen Webseiten

Grauzone:

- Wettbewerber-Preise scrapen (oft in AGB untersagt)

- Automatisiertes Posten auf Social Media (plattformabhängig)

Nicht akzeptabel:

- Persönliche Daten ohne Einwilligung sammeln

- Accounts anderer Personen automatisiert bedienen

- DDoS-ähnliche Massen-Anfragen

- CAPTCHA-Umgehung auf fremden Systemen

Die goldene Regel

Automatisiere nichts, was du als Mensch nicht auch tun dürftest. Der Agent ist ein Werkzeug — die Verantwortung bleibt bei dir.

Lektion 5: Long-Running Tasks und Session Management

Warum lange Aufgaben besonders sind

Die meisten Browser-Aufgaben dauern Sekunden. Aber manche brauchen Stunden:

- Grosse Datenmengen durchsuchen (1000+ Seiten)

- Multi-Step-Workflows mit Wartezeiten

- Aufgaben, die menschliche Bestätigung erfordern

Herausforderungen bei langen Sessions

- Browser-Speicher: Nach Stunden wird der Browser langsam

- Session-Timeouts: Websites loggen dich nach 30 Minuten aus

- Fehlerbehandlung: Was passiert bei einem Absturz nach 2 Stunden?

- Kosten: Lange KI-Sessions verbrauchen viele Tokens

Lösungsstrategien

Checkpointing: Der Agent speichert regelmässig seinen Fortschritt. Bei einem Absturz kann er an der letzten Stelle weitermachen, statt von vorne zu beginnen.

Batch-Verarbeitung: Statt 1000 Seiten am Stück: 10 Batches mit je 100 Seiten, dazwischen Pausen.

Retry-Logik: Automatische Wiederholung bei temporären Fehlern (Netzwerk-Timeouts, 503-Fehler).

Ergebnis-Streaming: Teilergebnisse werden sofort gespeichert, nicht erst am Ende der gesamten Aufgabe.

Lektion 6: Dein erster AI Browser Agent — Hands-on

Projekt: Nachrichten-Aggregator

Baue einen AI Agent, der täglich deine 5 wichtigsten Nachrichtenquellen durchsucht und dir eine personalisierte Zusammenfassung erstellt.

Schritt 1: MCP-Server einrichten

Verbinde Claude mit dem Playwright-MCP-Server: ```json { "mcpServers": { "playwright": { "command": "npx", "args": ["-y", "@anthropic/mcp-playwright"] } } } ```

Schritt 2: Aufgabe definieren

Prompt an Claude: "Öffne nacheinander diese 5 Websites: [URLs]. Finde auf jeder die 3 wichtigsten Artikel zum Thema KI. Erstelle eine Zusammenfassung mit Titel, Quelle, 2-3 Sätzen und einem Relevanz-Score von 1-10."

Schritt 3: Ergebnisse strukturieren

Claude erstellt automatisch:

- Eine Markdown-Tabelle mit allen Artikeln

- Eine Prioritätsliste ("Diese 3 Artikel solltest du heute lesen")

- Optional: Einen vorgefertigten LinkedIn-Post zum spannendsten Thema

Schritt 4: Automatisierung (Optional)

Mit Claude Scheduled Tasks oder einem Cron-Job:

- Täglich um 7:00 Uhr läuft der Agent

- Ergebnis landet als E-Mail in deinem Posteingang

- Dauert ca. 5 Minuten, spart dir 45 Minuten Nachrichtenlesen

Zusammenfassung und nächste Schritte

Was du gelernt hast

- Warum AI Browser Agents klassische RPA ersetzen

- Die wichtigsten Tools im Überblick

- Praktische Use Cases für den Berufsalltag

- Ethische Grenzen und Best Practices

- Umgang mit langen Automatisierungsaufgaben

- Deinen ersten eigenen Agent gebaut

Dein Aktionsplan

- Heute: Installiere den Playwright-MCP-Server

- Diese Woche: Automatisiere eine wiederkehrende Browser-Aufgabe

- Diesen Monat: Baue einen Agent, der dir täglich 30 Minuten spart

- Langfristig: Kombiniere Browser-Agenten mit MCP, Skills und Agent Teams

Browser Automation mit KI ist kein Zukunftsthema — es ist die Gegenwart. Der Unterschied zwischen dir und jemandem, der diese Tools nicht nutzt, wächst jeden Monat.