AI for Science: Wie KI die Forschung revolutioniert

Von AlphaFold über Materialforschung bis Klimamodelle: Wie künstliche Intelligenz wissenschaftliche Entdeckungen beschleunigt und ganze Forschungsfelder transformiert.

Von AlphaFold über Materialforschung bis Klimamodelle: Wie künstliche Intelligenz wissenschaftliche Entdeckungen beschleunigt und ganze Forschungsfelder transformiert.

Klicken zum Vergrößern

Die Wissenschaft erlebt gerade einen Paradigmenwechsel, der in seiner Tragweite mit der Einführung des Computers in die Forschung vergleichbar ist. Künstliche Intelligenz hat sich innerhalb weniger Jahre von einem Nischenthema der Informatik zu einem unverzichtbaren Werkzeug in nahezu allen Naturwissenschaften entwickelt. Der Wendepunkt lässt sich auf das Jahr 2020 datieren, als DeepMinds AlphaFold das Proteinfaltungsproblem löste, eine Frage, an der Biologen über fünf Jahrzehnte gearbeitet hatten.

Was AlphaFold so bedeutsam macht, ist nicht nur das Ergebnis selbst, sondern das Prinzip dahinter: Ein KI-System hat ein fundamentales wissenschaftliches Problem schneller und präziser gelöst als die gesamte internationale Forschungsgemeinschaft. Seitdem hat sich AlphaFold weiterentwickelt. Die aktülle Version AlphaFold 3 sagt nicht nur die Struktur einzelner Proteine vorher, sondern modelliert auch deren Wechselwirkungen mit DNA, RNA und kleinen Molekülen. Damit wird sie zu einem zentralen Werkzeug der Arzneimittelentwicklung: Was früher Jahre im Labor dauerte, die Identifikation vielversprechender Wirkstoffkandidaten, kann heute in Tagen am Computer erfolgen.

Doch AI for Science geht weit über die Biologie hinaus. In der Klimaforschung erzeugen KI-Modelle wie GraphCast von Google DeepMind Wettervorhersagen, die genauer sind als die der besten physikbasierten Modelle und dabei nur einen Bruchteil der Rechenzeit benötigen. In der Materialwissenschaft durchsuchen KI-Systeme den riesigen Raum möglicher chemischer Verbindungen und identifizieren neue Materialien für Batterien, Solarzellen oder Katalysatoren. Und in der Teilchenphysik helfen neuronale Netze, in den gewaltigen Datenmengen des CERN Muster zu finden, die auf neue Teilchen hindeuten könnten.

Die Arzneimittelentwicklung gilt als einer der langsamsten und teuersten Innovationsprozesse überhaupt. Von der ersten Idee bis zum zugelassenen Medikament vergehen durchschnittlich zehn bis fünfzehn Jahre, und die Kosten übersteigen regelmässig eine Milliarde Euro. KI hat das Potenzial, diesen Prozess grundlegend zu beschleunigen, und die ersten Ergebnisse sind bereits sichtbar.

Der klassische Ansatz der Arzneimittelentwicklung besteht darin, Tausende chemischer Verbindungen im Labor zu testen, um eine zu finden, die an ein bestimmtes Zielprotein bindet. Dieser Prozess heisst Hochdurchsatz-Screening und ist sowohl zeitaufwendig als auch teuer. KI-basiertes virtülles Screening dreht diesen Ansatz um: Anstatt Substanzen physisch zu testen, simuliert ein KI-Modell deren Wechselwirkung mit dem Zielprotein und filtert die vielversprechendsten Kandidaten heraus. Unternehmen wie Insilico Medicine haben auf diese Weise Wirkstoffkandidaten identifiziert, die innerhalb von nur 18 Monaten in klinische Studien eingingen, ein Bruchteil der üblichen Zeitspanne.

AlphaFold hat einen weiteren Engpass beseitigt: die Strukturaufklärung. Um einen Wirkstoff gezielt zu entwickeln, muss man die dreidimensionale Struktur des Zielproteins kennen. Früher war dafür aufwendige Röntgenkristallographie nötig, ein Prozess, der Monate dauern konnte. AlphaFold sagt die Struktur in Minuten vorher, und die Datenbank umfasst mittlerweile über 200 Millionen Proteinstrukturen. Das hat die Forschung demokratisiert: Auch kleine Labore und Universitäten in Entwicklungsländern haben nun Zugang zu Strukturdaten, die früher nur grossen Pharmakonzernen zur Verfügung standen.

Generative KI-Modelle gehen noch einen Schritt weiter. Systeme wie RFdiffusion können völlig neue Proteine entwerfen, die in der Natur nicht vorkommen. Diese Designer-Proteine haben Anwendungen in der Medizin, etwa als hochspezifische Antikörper, aber auch in der Industrie, etwa als Enzyme, die Plastik abbauen oder CO2 binden. Die Grenze zwischen Entdeckung und Erfindung verschwimmt zunehmend.

Die Suche nach neuen Materialien ist eines der ältesten Probleme der Menschheit, und KI verändert die Spielregeln grundlegend. Der Raum möglicher chemischer Verbindungen ist unvorstellbar gross: Schätzungen zufolge gibt es mehr potenzielle organische Moleküle als Atome im beobachtbaren Universum. Kein Mensch und kein Labor kann diesen Raum systematisch durchsuchen. Aber KI kann es.

Google DeepMind hat mit dem Projekt GNoME (Graph Networks for Materials Exploration) einen Meilenstein gesetzt. Das System identifizierte über 380.000 neue stabile Materialien, darunter viele mit Eigenschaften, die für die Energiewende entscheidend sind. Einige dieser Materialien versprechen bessere Batterien für Elektroautos, effizientere Solarzellen oder leistungsfähigere Supraleiters. Was früher Jahrzehnte systematischer Laborarbeit erfordert hätte, wurde in wenigen Monaten am Computer erreicht.

Die Methodik hinter diesen Entdeckungen basiert auf sogenannten Graph Neural Networks, die die Struktur von Kristallen und Molekülen als mathematische Graphen darstellen. Jedes Atom wird zum Knoten, jede chemische Bindung zur Kante. Das Modell lernt aus Hunderttausenden bekannter Materialien, welche Kombinationen stabil sind und welche gewünschten Eigenschaften aufweisen. Anschliessend generiert es Vorschläge für neue Verbindungen, die dann im Labor verifiziert werden. Die Erfolgsquote dieser KI-gesteuerten Vorhersagen liegt mittlerweile bei über 80 Prozent, verglichen mit weniger als zehn Prozent bei traditionellen Trial-and-Error-Ansätzen.

Besonders vielversprechend ist die Anwendung in der Katalyseforschung. Katalysatoren beschleunigen chemische Reaktionen und sind für die Industrie unverzichtbar, von der Düngemittelproduktion bis zur Wasserstofferzeugung. KI-Systeme können heute vorhersagen, welche Materialien als Katalysatoren für eine bestimmte Reaktion geeignet sind, und reduzieren damit die Entwicklungszeit von Jahren auf Wochen.

Klimamodelle gehören zu den komplexesten wissenschaftlichen Simulationen überhaupt. Sie müssen die Wechselwirkungen zwischen Atmosphäre, Ozeanen, Landmassen, Eisschichten und Biosphäre abbilden, und das über Zeiträume von Jahrzehnten bis Jahrhunderten. Traditionelle Klimamodelle benötigen dafür riesige Supercomputer und laufen trotzdem oft tagelang für eine einzige Simulation. KI-basierte Ansätze versprechen eine dramatische Beschleunigung.

Das bekannteste Beispiel ist GraphCast von Google DeepMind. Dieses KI-Modell wurde auf 40 Jahren Wetterdaten trainiert und liefert Zehn-Tage-Vorhersagen, die genauer sind als die des Europäischen Zentrums für mittelfristige Wettervorhersage (ECMWF), des bisherigen Goldstandards. Der entscheidende Vorteil: Während das ECMWF-Modell Stunden auf einem Supercomputer benötigt, liefert GraphCast seine Vorhersage in unter einer Minute auf einem einzelnen Rechner. Das ermöglicht nicht nur schnellere Vorhersagen, sondern auch sogenannte Ensemble-Berechnungen, bei denen viele leicht unterschiedliche Szenarien simuliert werden, um die Unsicherheit der Prognose abzuschätzen.

Für die langfristige Klimaforschung entwickeln Teams weltweit sogenannte Foundation Models für das Erdsystem. Diese Modelle werden auf riesigen Datensätzen aus Satellitenbeobachtungen, Ozeanmessungen und atmosphärischen Daten trainiert und können anschliessend für verschiedene Aufgaben eingesetzt werden: von der Vorhersage von Extremwetterereignissen über die Simulation von Klimaszenarien bis hin zur Optimierung von Frühwarnsystemen.

Ein besonders wichtiges Anwendungsfeld ist die Vorhersage von Extremwetterereignissen. KI-Modelle können Hitzewellen, Stürme und Überschwemmungen früher und präziser vorhersagen als konventionelle Methoden. Das rettet Leben, denn jede zusätzliche Stunde Vorwarnzeit gibt Behörden und Bevölkerung mehr Zeit zur Vorbereitung. In Südostasien, wo Tropenstürme regelmässig verheerende Schäden anrichten, haben KI-gestützte Frühwarnsysteme die Reaktionszeit der Katastrophenschutzbehörden bereits messbar verbessert.

KI verändert nicht nur die experimentellen Wissenschaften, sondern auch die theoretische Forschung. In der Mathematik hat Googles AlphaProof im Jahr 2024 erstmals Aufgaben der Internationalen Mathematik-Olympiade auf Silbermedaillen-Niveau gelöst. Das klingt zunächst wie eine akademische Spielerei, hat aber tiefgreifende Implikationen: Wenn KI mathematische Beweise finden kann, kann sie auch bei der Lösung offener Forschungsfragen helfen, die bisher am menschlichen Vorstellungsvermögen scheiterten.

In der Physik beschleunigen KI-Modelle die Simulation komplexer Systeme um Grössenordnungen. Molekulardynamik-Simulationen, die das Verhalten von Millionen Atomen berechnen, dauern auf konventionellen Supercomputern Wochen. KI-basierte Potenziale, die die quantenmechanischen Wechselwirkungen zwischen Atomen approximieren, reduzieren diese Zeit auf Stunden bei vergleichbarer Genauigkeit. Das ermöglicht völlig neue Forschungsansätze, etwa die Simulation ganzer Viren auf atomarer Ebene oder die Vorhersage von Phasenübergängen in exotischen Materialien.

Auch in der Astronomie spielt KI eine wachsende Rolle. Teleskope der nächsten Generation wie das Vera C. Rubin Observatory werden jede Nacht Terabytes an Bilddaten erzeugen. Ohne KI wäre es unmöglich, in dieser Datenflut neue Objekte zu identifizieren, Gravitationslinsen zu erkennen oder transiente Ereignisse wie Supernovä in Echtzeit zu klassifizieren. Machine-Learning-Modelle werden zu den Augen der Astronomen.

Die philosophische Dimension dieser Entwicklung ist nicht zu unterschätzen. Wenn KI-Systeme wissenschaftliche Hypothesen generieren, Experimente vorschlagen und Ergebnisse interpretieren, stellt sich die Frage, wie sich die Rolle des menschlichen Forschers verändert. Die wahrscheinlichste Antwort: Der Mensch bleibt als kreativer Impulsgeber, als Fragensteller und als ethischer Wächter unverzichtbar, aber die Werkzeuge, mit denen er arbeitet, werden mächter denn je.

Mit der wachsenden Bedeutung von KI in der Forschung wachsen auch die Herausforderungen. Eine der dringendsten betrifft die Reproduzierbarkeit. Wissenschaft lebt davon, dass Ergebnisse unabhängig überprüft werden können. Bei KI-basierten Studien ist das oft schwierig, weil die Modelle komplex sind, die Trainingsdaten nicht immer zugänglich und die Ergebnisse von kleinen Änderungen in den Hyperparametern abhängen können.

Die wissenschaftliche Gemeinschaft hat auf dieses Problem reagiert. Führende Fachzeitschriften wie Nature und Science verlangen zunehmend, dass Autoren ihren Code, ihre Trainingsdaten und die genauen Modellkonfigurationen veröffentlichen. Das Konzept der Open Science, also der offenen und transparenten Wissenschaft, gewinnt durch KI eine neue Dringlichkeit. AlphaFold hat hier mit gutem Beispiel vorangegangen: Die gesamte Datenbank mit über 200 Millionen Proteinstrukturen ist frei zugänglich, und der Code ist Open Source.

Ein weiteres Problem ist der sogenannte Bias in wissenschaftlichen Daten. KI-Modelle lernen aus historischen Daten, und wenn diese Daten Verzerrungen enthalten, reproduziert das Modell diese Verzerrungen. In der medizinischen Forschung etwa wurden viele Studien überwiegend an männlichen Probanden europäischer Herkunft durchgeführt. Ein KI-Modell, das auf diesen Daten trainiert wird, könnte bei Frauen oder Menschen anderer Ethnien schlechtere Ergebnisse liefern. Forscherinnen und Forscher müssen sich dieser Problematik bewusst sein und aktiv gegensteuern.

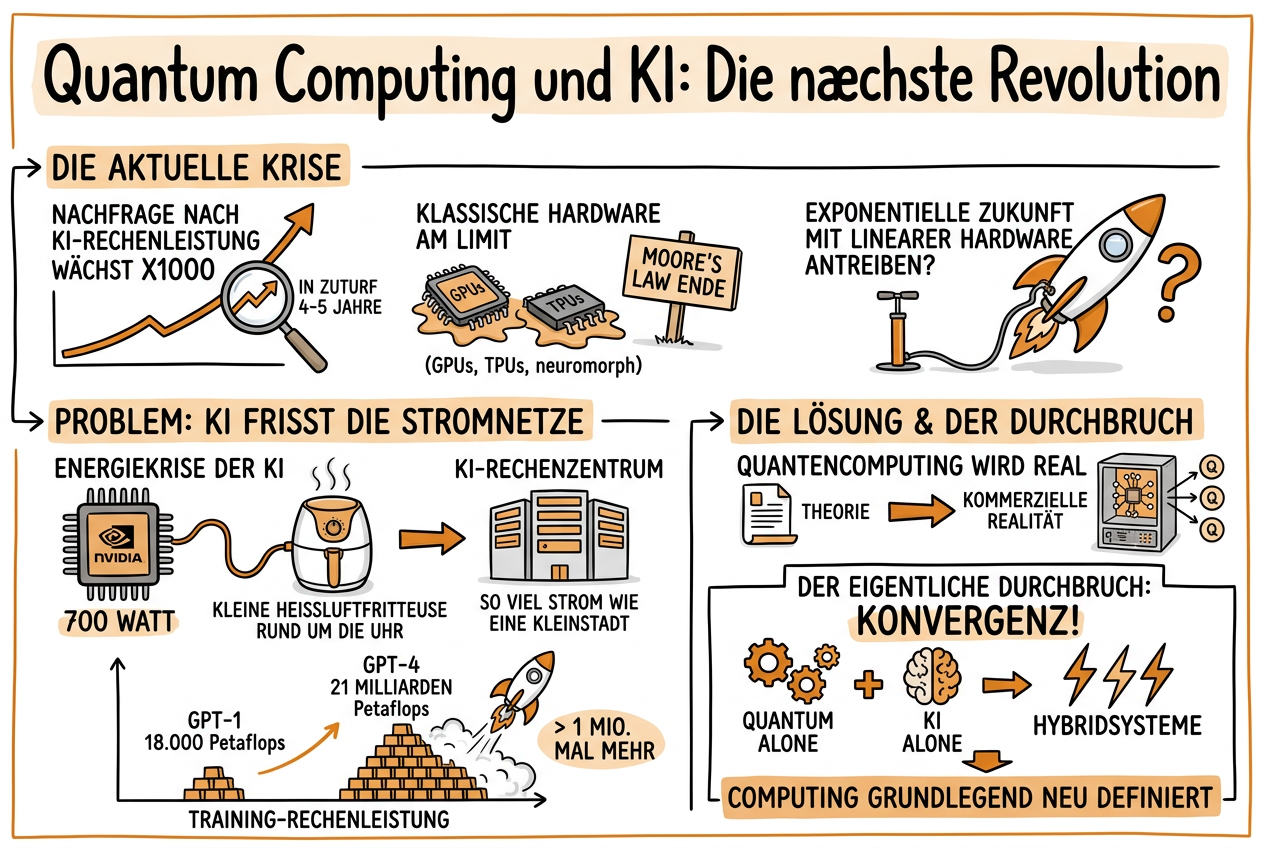

Schliesslich stellt sich die Frage nach dem Energieverbrauch. Das Training grosser KI-Modelle verbraucht enorme Mengen an Strom und Wasser. GPT-4 hat Schätzungen zufolge während seines Trainings so viel Strom verbraucht wie eine Kleinstadt in einem Monat. Für die Wissenschaft, die sich zunehmend der Nachhaltigkeit verpflichtet fühlt, ist das ein Dilemma. Ansätze wie effizientere Modellarchitekturen, Transfer Learning und die Nutzung erneuerbarer Energien für Rechenzentren bieten Lösungswege.

Für Forscherinnen und Forscher, die KI in ihrer Arbeit einsetzen möchten, beginnt der Weg nicht mit der Programmierung neuronaler Netze, sondern mit einer ehrlichen Bestandsaufnahme. Die erste Frage lautet: Welches Problem will ich lösen, und ist KI dafür das richtige Werkzeug? Nicht jede Forschungsfrage profitiert von Machine Learning. KI entfaltet ihre Stärke dort, wo grosse Datenmengen vorliegen, komplexe Muster erkannt werden müssen und die bisherigen Methoden an ihre Grenzen stossen.

Der Einstieg ist heute deutlich einfacher als noch vor wenigen Jahren. Plattformen wie Google Colab, Kaggle und Hugging Face bieten kostenlose Rechenressourcen und vortrainierte Modelle, die ohne tiefes KI-Wissen genutzt werden können. Ein Biologe kann AlphaFold nutzen, ohne die Details der Transformer-Architektur zu verstehen. Ein Klimaforscher kann vortrainierte Wettermodelle feintunen, ohne sie von Grund auf trainieren zu müssen. Transfer Learning, also die Anpassung vortrainierter Modelle an neue Aufgaben, hat die Einstiegshürde dramatisch gesenkt.

Für anspruchsvollere Projekte empfiehlt es sich, interdisziplinäre Teams zu bilden. Die besten Ergebnisse entstehen an der Schnittstelle zwischen Domänenwissen und KI-Kompetenz. Ein Materialwissenschaftler, der seine Daten und Fragestellungen kennt, und ein Data Scientist, der die passenden Algorithmen auswählt und implementiert, ergänzen sich ideal. Viele Universitäten haben inzwischen KI-Servicezentren eingerichtet, die Forschende aus allen Disziplinen bei der Integration von KI in ihre Projekte unterstützen.

Der wichtigste Rat zum Schluss: Beginnen Sie klein, aber beginnen Sie jetzt. Die KI-gestützte Wissenschaft entwickelt sich rasant, und wer heute die Grundlagen lernt, wird morgen die Früchte ernten. Ob es darum geht, Daten schneller auszuwerten, neue Hypothesen zu generieren oder Simulationen zu beschleunigen, KI wird in wenigen Jahren in praktisch jeder wissenschaftlichen Disziplin so selbstverständlich sein wie heute das Tabellenkalkulationsprogramm.